标签:

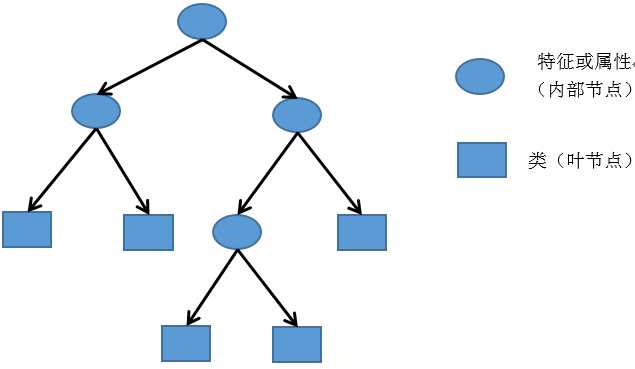

if-then规则的集合,优点是模型具有可读性,分类速度快。

决策树常用的算法:ID3算法、C4.5算法、CART算法

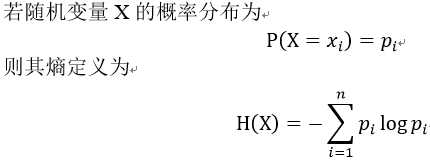

1、熵(entropy,又称信息熵)

因此,熵只依赖于X的分布,与X的取值无关。

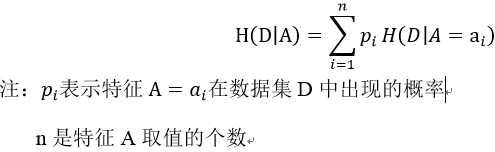

2、条件熵——表示在已知特征A的条件下,数据集D的不确定性

条件概率公式: ![]()

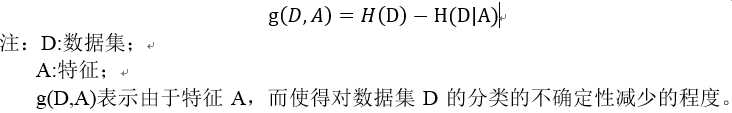

3、信息增益(偏向于选择取值较多的特征)

4、信息增益比

CART算法 Classification and regression tree,分类回归树

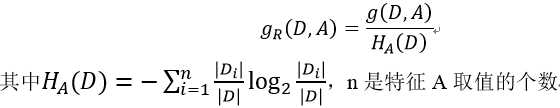

1、(最小二乘)回归树 —— 平方误差最小准则 ![]()

步骤如下:

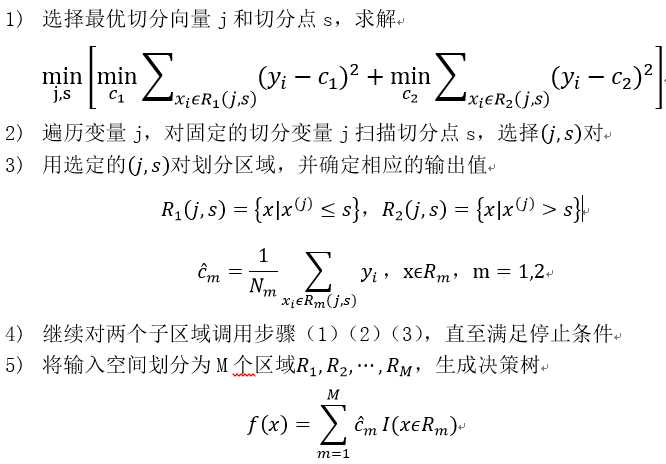

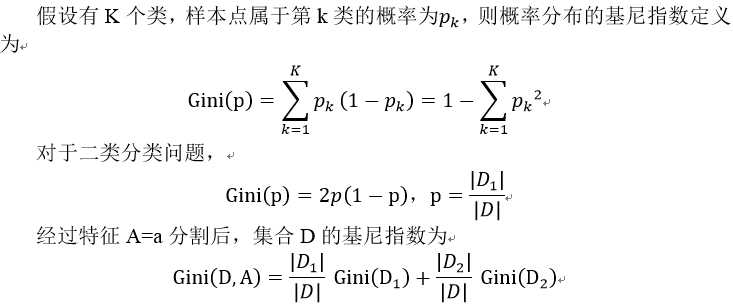

2、分类树 —— 基尼指数(Gini Index)最小准则

基尼指数(表示集合D的不确定性)

步骤如下:

1) 针对于数据集D的每一个特征,对其所有可能的取值a,计算在时的基尼指数

2) 选择基尼指数最小的特征及其对应的切分点,作为最优特征和最优切分点。

3) 将训练集依该特征及其切分点,分配到两个子结点中,对这两个子结点递归调用(1)(2),直至满足停止条件

4) 生成CART决策树

算法停止条件:

标签:

原文地址:http://www.cnblogs.com/sweetyu/p/5085242.html