标签:

P.S. SVM比较复杂,代码没有研究清楚,进一步学习其他知识后再来补充。以下仅罗列了最核心的知识,来自《机器学习实战》的学习摘要。

优点:泛化错误率低,计算开销不大,结果易解释。

缺点:对参数调节和核函数的选择敏感,原始分类器不加修改仅适用于处理二类问题。

适用数据类型:数值型和标称型数据。

线性可分数据:画出一条直线将两组数据点分开。

超平面(将数据集分隔开来的直线,为N-1维):分类的决策边界。如果数据点离决策边界越远,那么其最后的预测结果也就越可信。

间隔:点到分隔面的距离。(离分隔超平面最近的点,确保它们离分隔面的距离尽可能远。)

支持向量(support vector)就是离分隔超平面最近的那些点。接下来要试着最大化支持向量到分隔面的距离,需要找到此问题的优化求解方法。

应用支持向量机算法就是在特征空间建立分类超平面。

类别标签是0或1:类别标签为什么采用-1和+1呢?这是由于-1和+1仅仅相差一个符号,方便数学上的处理。(如果数据点处于正方向(即+1类)并且离分隔超平面很远的位置时,wTx+b(即分隔超平面)会是一个很大的正数,同时label * (wTx+b)(即间隔)也会是一个很大的正数。而如果数据点处于负方向(-1类)并且离分隔超平面很远的位置时,此时由于类别标签为-1,则label * (wTx+b)仍然是一个很大的正数。)

目标:

- 最终是找出分类器定义中的w和b;

- 为此必须找到具有最小间隔的数据点;

- 找到对该最小间隔最大化的w和b;

- 离分隔超平面最近的点的label * (wTx+b)的值为1;

- 该问题转换为带约束条件的优化问题:这里的约束条件就是label * (wTx+b)≥ 1.0;

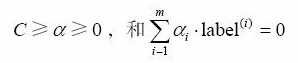

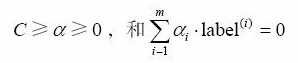

- 用拉格朗日乘子法求解,(有个假设:数据必须100%线性可分,因为这不可能,所以引入所谓松弛变量,来允许有些数据点可以处于分隔面的错误一侧)约束条件为:

这里的常数C用于控制“最大化间隔”和“保证大部分点的函数间隔小于1.0”这两个目标的权重。在优化算法的实现代码中,常数C是一个参数,因此我们就可以通过调节该参数得到不同的结果。一旦求出了所有的alpha,那么分隔超平面就可以通过这些alpha来表达。这一结论十分直接,SVM中的主要工作就是求解这些alpha。(大部分alpha值为0。而非零alpha所对应的也就是支持向量。)

SVM的一般流程

收集数据:可以使用任意方法。

准备数据:需要数值型数据。

分析数据:有助于可视化分隔超平面。

训练算法:SVM的大部分时间都源自训练,该过程主要实现两个参数的调优。

测试算法:十分简单的计算过程就可以实现。

使用算法:几乎所有分类问题都可以使用SVM,值得一提的是,SVM本身是一个二类分类器,对多类问题应用SVM需要对代码做一些修改。

序列最小优化算法(SMO):将大优化问题分解为多个小优化问题来顺序求解。

SMO算法的目标:求出一系列alpha和b,用这些alpha就很容易计算出权重向量w并得到分隔超平面。

SMO算法的工作原理:每次循环中选择两个alpha进行优化处理。一旦找到一对合适的alpha,那么就增大其中一个同时减小另一个。这里所谓的“合适”就是指两个alpha必须要符合一定的条件,条件之一就是这两个alpha必须要在间隔边界之外,而其第二个条件则是这两个alpha还没有进行过区间化处理或者不在边界上。

SMO算法的第一个版本伪代码:

创建一个alpha向量并将其初始化为0向量

当迭代次数小于最大迭代次数时(外循环)

对数据集中的每个数据向量(内循环):

如果该数据向量可以被优化:

随机选择另外一个数据向量

同时优化这两个向量

如果两个向量都不能被优化,退出内循环

如果所有向量都没被优化,增加迭代数目,继续下一次循环

数组过滤:只对NumPy类型有用,array(list)>0,会得到一个布尔数组。array(list)[array(list)>0]得到原列表中大于0的所有值组成的数组。

利用完整Platt SMO算法加速优化:

1. 通过一个外循环来选择第一个alpha值:一种方式是在所有数据集上进行单遍扫描;另一种方式则是在非边界alpha中实现单遍扫描(不等于边界0或C的alpha值,跳过已知的不会改变的alpha值)。

2. 通过一个内循环来选择第二个alpha值:通过最大化步长的方式来获得第二个alpha值。简化版SMO算法中,我们会在选择j之后计算错误率Ej。但在这里,我们会建立一个全局的缓存用于保存误差值,并从中选择使得步长或者说Ei-Ej最大的alpha值。

核函数:实现从一个特征空间到另一个特征空间的映射。能把数据从某个很难处理的形式转换成为另一个较容易处理的形式。(将数据(有时是非线性数据)从一个低维空间映射到一个高维空间,可以将一个在低维空间中的非线性问题转换成高维空间下的线性问题来求解。)

向量的内积:指的是两个向量相乘,之后得到单个标量或者数值。SVM优化中所有的运算都可以写成内积的形式。我们可以把内积运算替换成核函数(该过程为核技巧或者核”变电“),而不必做简化处理。

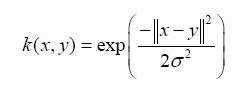

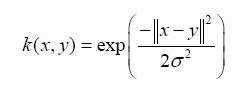

径向基核函数(一个流行的核函数):

- 采用向量作为自变量,能够基于向量距离运算输出一个标量

- 径向基函数的高斯版本:

(σ是用户定义的用于确定到达率(reach) 或者说函数值跌落到0的速度参数)

(σ是用户定义的用于确定到达率(reach) 或者说函数值跌落到0的速度参数)

支持向量的数目存在一个最优值。SVM的优点在于它能对数据进行高效分类。如果支持向量太少,就可能会得到一个很差的决策边界;如果支持向量太多,也就相当于每次都利用整个数据集进行分类,这种分类方法称为k近邻。

支持向量机-Machine Learning In Action学习笔记

标签:

原文地址:http://www.cnblogs.com/woaielf/p/5480717.html

(σ是用户定义的用于确定到达率(reach) 或者说函数值跌落到0的速度参数)

(σ是用户定义的用于确定到达率(reach) 或者说函数值跌落到0的速度参数)