标签:

Fully Convolutional Attention Localization Networks:

Efficient Attention Localization for Fine-Grained Recognition

细粒度的识别(Fine-grained recognition)的挑战性主要来自于 类内差异(inter-class differences)在细粒度类别中通常是局部的,细微的;类间差异(intra-class differences)由于姿态的变换而导致很大。为了从类间变化区分他们,放大到具有高度判别性的局部区域是非常重要的。本文提出了一种基于强化学习的全卷积注意力局部网络来自适应的选择多任务驱动的视觉注意力区域 (In this work, we introduce a reinforcement learning-based fully convolutional attention localization network to adaptively select multiple task-driven visual attention regions.) 作者的实验表明将相关区域放大处理,可以得到更好的结果,这一点就相当于我们人类看东西的时候,当全局看的不是很仔细的时候,就需要放大镜来看,从局部得到所需要的信息,从而做出进一步的判断。本文在三个数据集上做了实验,分别是:斯坦福dog, cars, CUB-200-2011。

前人的工作大多是使用手工设计的 part 来进行 fine-grained recognition。依赖于手工定义的part有几个缺点:

1. 精确的part 标注需要非常昂贵的代价;

2. 强监督的基于part的模型可能在part被遮挡时,失效;

3. 最后但也是最重要的,即:没有线索表明,手工设计的part对于所有的 fine-grained recognition tasks来说是最优的。例如:对于食物的识别来别,是非常难以设计part的。

针对以上问题,本文提出了一种框架,即:Fully Convolutional Attention Localization Network 来定位物体的part,而没有任何人工的标注。本文利用基于强化学习的视觉 attenation model 来模拟学习定位物体的part,并且在场景内进行物体分类。这个框架模拟人类视觉系统的识别过程,通过学习一个任务驱动的策略,经过一系列的 glimpse 来定位物体的part。那么,这里的 glimpse 是什么呢?每一个 glimpse 对应一个物体的part。将原始的图像以及之前glimpse 的位置作为输入,下一次 glimpse位置作为输出,作为下一次物体part。每一个 glimpse的位置作为一个 action,图像和之前glimpse的位置作为 state,奖励衡量分类的准确性。本文方法可以同时定位多个part,之前的方法只能一次定位一个part,但是仔细想想,也奇怪,既然是 attenation model,那么像人类一样,一次只能将目光注意到一个地方,只定位一个part也是正常且合理的,这里搞一个多个part的同时定位,有点不太合理。

Fully Convolutional Attention Localization Networks

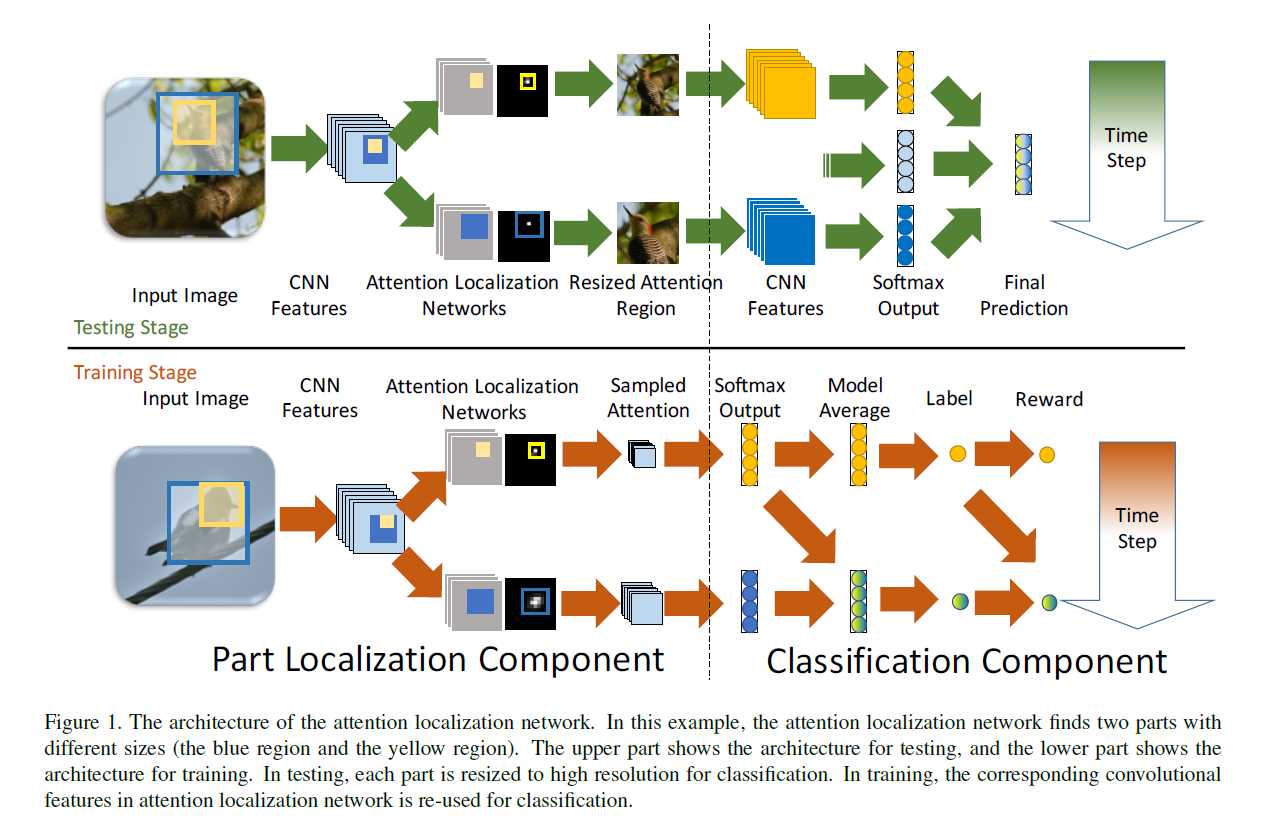

该网络结构可以借助 attention mechanism 来同时定位多个物体的part。不同的part可以拥有不同的预先定义的尺寸,主要包含两个成分:Part localization component and classification component.

从上图可以看到,

标签:

原文地址:http://www.cnblogs.com/wangxiaocvpr/p/5532592.html