标签:log 预处理 ssi 技术分享 错误 class .com 笔记 image

阅读对象:了解指示函数,了解训练集、测试集的概念。

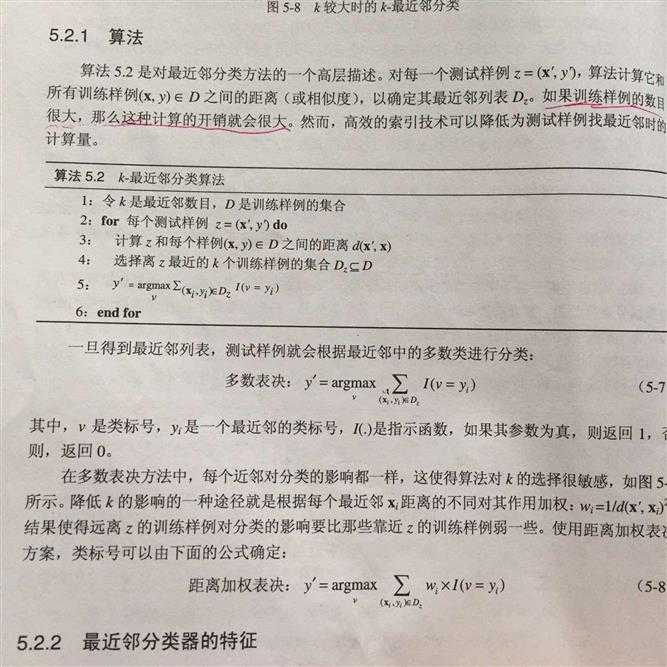

knn算法是监督学习中分类方法的一种。所谓监督学习与非监督学习,是指训练数据是否有标注类别,若有则为监督学习,若否则为非监督学习。所谓K近邻算法,即是给定一个训练数据集,对新的输入实例,在训练数据集中找到与该实例最邻近的K个实例,这K个实例的多数属于某个类(加权),就把该输入实例分类到这个类中。

最初的近邻法是由Cover和Hart于1968年提出的,随后得到理论上深入的分析与研究,是非参数法中最重要的方法之一,它在论文Nearest Neighbor Pattern Classification中给出了算法准确率的详细描述,最近邻法的错误率是高于贝叶斯错误率。[没来得及看,标注,方便以后翻阅]

knn计算输入实例与每一个训练实例的距离,当训练集很大时,计算非常耗时,为了提高knn搜索的效率,可以考虑使用特殊结构存储训练数据,以减少计算距离的次数。[见参考资料1,本篇数据不大,暂时没有看]

图1来自参考文献2

计算量大、对噪声敏感、样本各个属性的量纲差异很大时要进行数据预处理。

图2来自参考文献2

参考资料:

[1]《统计学习方法》, 李航,P41-44

[2]数据挖掘导论(完整版),Pang-Ning Tan、Michael Steinbach、Vipin Kumar著(范明、范宏建等译),P137-139

end!!

标签:log 预处理 ssi 技术分享 错误 class .com 笔记 image

原文地址:http://www.cnblogs.com/llfisher/p/6560460.html