标签:blog machine windows import 项目 1.5 编辑 ons 变量

安装好之后,本地python环境就采用anaconda自带的python2.7的环境。

在本地ctrl+r打开控制台后,直接使用pip安装py4j,因为anaconda默认是安装了pip的,当然也可以使用conda安装。

安装命令:pip install py4j

如果不安装py4j可能出现的问题?

答:因为Spark的Python版本的API依赖于py4j,如果不安装运行程序会抛出如下错误。

(1).先打开Run Configurations

(2).编辑Environment variables

菜单:File-->Settings (图来源于互联网~这里我用的是python2)

(3).在Environment variables下增加spark和python的环境

增加SPARK_HOME目录与PYTHONPATH目录。

- SPARK_HOME:Spark安装目录

- PYTHONPATH:Spark安装目录下的Python目录

编写Spark程序,复制pyspark的包,增加代码显示功能

为了让我们在PyCharm编写Spark程序时有代码提示和补全功能,需要将Spark的pyspark导入到Python中。在Spark的程序中有Python的包,叫做pyspark

pyspark包

Python导入第三方的包也很容易,只需要把相应的模块导入到指定的文件夹就可以了。

windows中将pyspark拷贝到Python的site-packages目录下(这里使用的是anaconda)

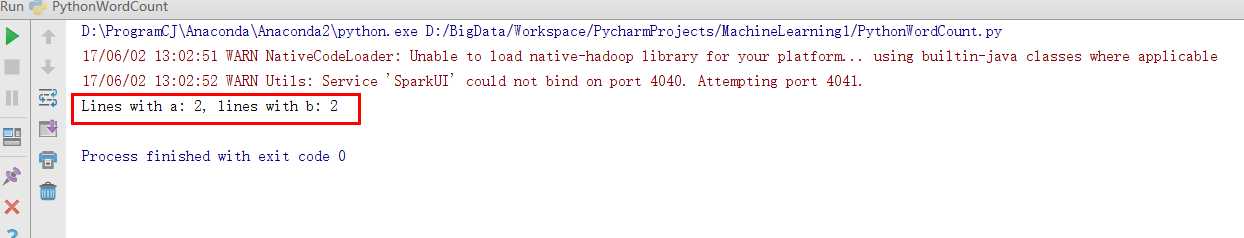

import sys

from operator import add

from pyspark import SparkContext

logFile = "D:\\BigData\\Workspace\\PycharmProjects\\MachineLearning1\\word.txt"

sc = SparkContext("local", "PythonWordCount")

logData = sc.textFile(logFile).cache()

numAs = logData.filter(lambda s: ‘a‘ in s).count()

numBs = logData.filter(lambda s: ‘b‘ in s).count()

print("Lines with a: %i, lines with b: %i" % (numAs, numBs))

PyCharm+Eclipse共用Anaconda的数据科学环境

标签:blog machine windows import 项目 1.5 编辑 ons 变量

原文地址:http://www.cnblogs.com/jackchen-Net/p/6932754.html