梯度下降算法: 线性回归模型:

![]() 线性假设:

线性假设:![]()

平方差成本函数:![]()

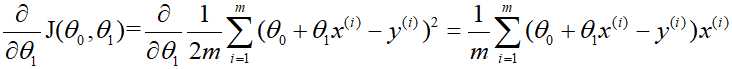

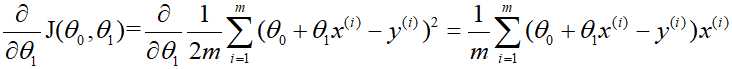

将各个公式代入,对θ0、θ1分别求偏导得:

![]()

再将偏导数代入梯度下降算法,就可以实现寻找局部最优解的过程了。

线性回归的成本函数总是一个凸函数,故梯度下降算法执行后只有一个最小值。

“批”梯度下降:每一个步骤都使用所有的训练样本

标签:梯度下降算法 梯度 梯度下降 模型 nbsp 分享 img 导数 height

梯度下降算法: 线性回归模型:

![]() 线性假设:

线性假设:![]()

平方差成本函数:![]()

将各个公式代入,对θ0、θ1分别求偏导得:

![]()

再将偏导数代入梯度下降算法,就可以实现寻找局部最优解的过程了。

线性回归的成本函数总是一个凸函数,故梯度下降算法执行后只有一个最小值。

“批”梯度下降:每一个步骤都使用所有的训练样本

【吴恩达机器学习】学习笔记——2.7第一个学习算法=线性回归+梯度下降

标签:梯度下降算法 梯度 梯度下降 模型 nbsp 分享 img 导数 height

原文地址:https://www.cnblogs.com/JJJanepp/p/8454834.html