标签:样本 com 隐藏 ima 才有 drop 技术 参数 lex

一、介绍

AlexNet最后2个全连接层中使用了Dropout,因为全连接层容易过拟合,而卷积层不容易过拟合。

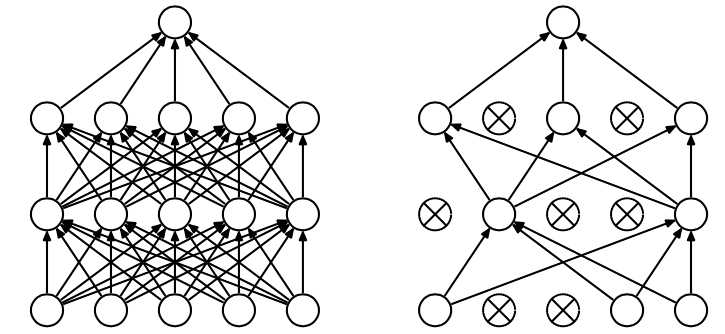

1.随机删除网络中的一些隐藏神经元,保持输入输出神经元不变;

2.将输入通过修改后的网络进行前向传播,然后将误差通过修改后的网络进行反向传播;

3.对于另外一批的训练样本,重复上述操作1

二、作用、原理

1.相对于训练大量模型耗费大量时间,dropout在AlexNet中只需花费2倍的训练时间。

2.引入稀疏性。因为部分神经元被删除,原来有些特征可能会依赖于固定关系的隐含节点的共同作用,通过Dropout的话,就有效地阻止了某些特征在其他特征存在下才有效果的情况。

3.类似模型集成。在Dropout训练过程中,网络因为随机删除节点,导致实际上存在多种网络结构,却共用一组参数。

标签:样本 com 隐藏 ima 才有 drop 技术 参数 lex

原文地址:https://www.cnblogs.com/mimandehuanxue/p/8994427.html