标签:个数 reg events 链接 记录 数据类型 版本 localhost 负载均衡

week9

1 RabbitMQ(消息队列)使用erlang语言

py:

MQ全称为Message Queue, 消息队列(MQ)是一种应用程序对应用程序的通信方法。应用程序通过读写出入队列的消息(针对应用程序的数据)来通信,而无需专用连接来链接它们。消息传递指的是程序之间通过在消息中发送数据进行通信,而不是通过直接调用彼此来通信,直接调用通常是用于诸如远程过程调用的技术。排队指的是应用程序通过队列来通信。队列的使用除去了接收和发送应用程序同时执行的要求。

安装python rabbitMQ module:

pip install pika

客户端连接的时候需要配置认证参数:

credentials = pika.PlainCredentials(‘user‘, ‘pwd‘) connection = pika.BlockingConnection(pika.ConnectionParameters( ‘10.211.55.5‘,5672,‘/‘,credentials))

生产者:

import pika connection = pika.BlockingConnection(pika.ConnectionParameters(‘localhost‘)) channel = connection.channel() #声明一个管道 # 声明queue channel.queue_declare(queue=‘hello‘) # n RabbitMQ a message can never be sent directly to the queue, it always needs to go through an exchange. channel.basic_publish(exchange=‘‘, routing_key=‘hello‘, #queue名字 body=‘Hello World!‘) print(" [x] Sent ‘Hello World!‘") connection.close()

消费者:

import pika connection = pika.BlockingConnection(pika.ConnectionParameters(‘localhost‘)) channel = connection.channel() # You may ask why we declare the queue again ? we have already declared it in our previous code. # We could avoid that if we were sure that the queue already exists. For example if send.py program # was run before. But we‘re not yet sure which program to run first. In such cases it‘s a good # practice to repeat declaring the queue in both programs. channel.queue_declare(queue=‘hello‘) def callback(ch, method, properties, body): print(" [x] Received %r" % body) channel.basic_consume(#开始消费消息 callback, #如果收到消息,则调用CALLBACK函数来处理消息 queue=‘hello‘, no_ack=True) print(‘ [*] Waiting for messages. To exit press CTRL+C‘) channel.start_consuming()

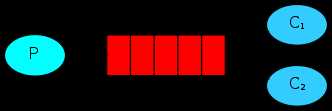

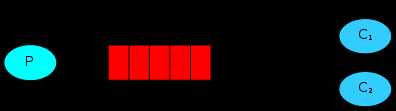

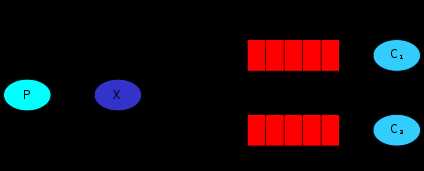

1.1 Work Queues(消息分发轮询)

在这种模式下,RabbitMQ会默认把p发的消息依次分发给各个消费者(c),跟负载均衡差不多。

acknowledgment:消息不丢失

no_ack = False,如果消费者遇到情况(its channel is closed, connection is closed, or TCP connection is lost)挂掉了,那么,RabbitMQ会重新将该任务添加到队列中。

#no_ack=True 自动轮询至下一个customer

1.2 消息持久化

durable:消息不丢失

channel.queue_declare(queue=‘task_queue‘, durable=True)

channel.basic_publish(exchange=‘‘, routing_key="task_queue", body=message, properties=pika.BasicProperties( delivery_mode = 2, # make message persistent ))

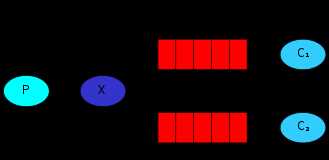

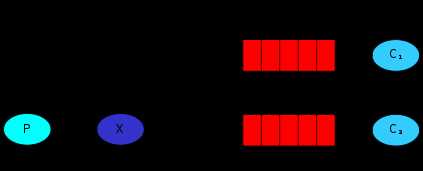

1.3 消息公平转发

如果Rabbit只管按顺序把消息发到各个消费者身上,不考虑消费者负载的话,很可能出现,一个机器配置不高的消费者那里堆积了很多消息处理不完,同时配置高的消费者却一直很轻松。为解决此问题,可以在各个消费者端,配置perfetch=1,意思就是告诉RabbitMQ在我这个消费者当前消息还没处理完的时候就不要再给我发新消息了。

channel.basic_qos(prefetch_count=1)

生产者:

import pika import sys connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.queue_declare(queue=‘task_queue‘, durable=True) message = ‘ ‘.join(sys.argv[1:]) or "Hello World!" channel.basic_publish(exchange=‘‘, routing_key=‘task_queue‘, body=message, properties=pika.BasicProperties( delivery_mode = 2, # make message persistent )) print(" [x] Sent %r" % message) connection.close()

消费者:

import pika import time connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.queue_declare(queue=‘task_queue‘, durable=True) print(‘ [*] Waiting for messages. To exit press CTRL+C‘) def callback(ch, method, properties, body): print(" [x] Received %r" % body) time.sleep(body.count(b‘.‘)) print(" [x] Done") ch.basic_ack(delivery_tag = method.delivery_tag) channel.basic_qos(prefetch_count=1) channel.basic_consume(callback, queue=‘task_queue‘) channel.start_consuming()

1.3 Publish\Subscribe(消息发布\订阅)

之前的例子都基本都是1对1的消息发送和接收,即消息只能发送到指定的queue里,但有些时候你想让你的消息被所有的Queue收到,类似广播的效果,这时候就要用到exchange。

Exchange在定义的时候是有类型的,以决定到底是哪些Queue符合条件,可以接收消息

表达式符号说明:#代表一个或多个字符,*代表任何字符

例:#.a会匹配a.a,aa.a,aaa.a等

*.a会匹配a.a,b.a,c.a等

注:使用RoutingKey为#,Exchange Type为topic的时候相当于使用fanout

消息publisher:

import pika import sys connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.exchange_declare(exchange=‘logs‘, type=‘fanout‘) message = ‘ ‘.join(sys.argv[1:]) or "info: Hello World!" channel.basic_publish(exchange=‘logs‘, routing_key=‘‘, body=message) print(" [x] Sent %r" % message) connection.close()

消息subscriber:

import pika connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.exchange_declare(exchange=‘logs‘, type=‘fanout‘) result = channel.queue_declare(exclusive=True) #不指定queue名字,rabbit会随机分配一个名字,exclusive=True会在使用此queue的消费者断开后,自动将queue删除 queue_name = result.method.queue channel.queue_bind(exchange=‘logs‘, queue=queue_name) print(‘ [*] Waiting for logs. To exit press CTRL+C‘) def callback(ch, method, properties, body): print(" [x] %r" % body) channel.basic_consume(callback, queue=queue_name, no_ack=True) channel.start_consuming()

1.4 有选择的接收消息(exchange type=direct)

RabbitMQ还支持根据关键字发送,即:队列绑定关键字,发送者将数据根据关键字发送到消息exchange,exchange根据关键字判定应该将数据发送至指定队列。

publisher:需要传参数

import pika import sys connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.exchange_declare(exchange=‘direct_logs‘, type=‘direct‘) severity = sys.argv[1] if len(sys.argv) > 1 else ‘info‘ message = ‘ ‘.join(sys.argv[2:]) or ‘Hello World!‘ channel.basic_publish(exchange=‘direct_logs‘, routing_key=severity, body=message) print(" [x] Sent %r:%r" % (severity, message)) connection.close()

subsciber:

import pika import sys connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.exchange_declare(exchange=‘direct_logs‘, type=‘direct‘) result = channel.queue_declare(exclusive=True) queue_name = result.method.queue severities = sys.argv[1:] if not severities: sys.stderr.write("Usage: %s [info] [warning] [error]\n" % sys.argv[0]) sys.exit(1) for severity in severities: channel.queue_bind(exchange=‘direct_logs‘, queue=queue_name, routing_key=severity) print(‘ [*] Waiting for logs. To exit press CTRL+C‘) def callback(ch, method, properties, body): print(" [x] %r:%r" % (method.routing_key, body)) channel.basic_consume(callback, queue=queue_name, no_ack=True) channel.start_consuming()

1.5 更细致的消息过滤

pulisher:

import pika import sys connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.exchange_declare(exchange=‘topic_logs‘, type=‘topic‘) routing_key = sys.argv[1] if len(sys.argv) > 1 else ‘anonymous.info‘ message = ‘ ‘.join(sys.argv[2:]) or ‘Hello World!‘ channel.basic_publish(exchange=‘topic_logs‘, routing_key=routing_key, body=message) print(" [x] Sent %r:%r" % (routing_key, message)) connection.close()

subscriber:

import pika import sys connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.exchange_declare(exchange=‘topic_logs‘, type=‘topic‘) result = channel.queue_declare(exclusive=True) queue_name = result.method.queue binding_keys = sys.argv[1:] if not binding_keys: sys.stderr.write("Usage: %s [binding_key]...\n" % sys.argv[0]) sys.exit(1) for binding_key in binding_keys: channel.queue_bind(exchange=‘topic_logs‘, queue=queue_name, routing_key=binding_key) print(‘ [*] Waiting for logs. To exit press CTRL+C‘) def callback(ch, method, properties, body): print(" [x] %r:%r" % (method.routing_key, body)) channel.basic_consume(callback, queue=queue_name, no_ack=True) channel.start_consuming()

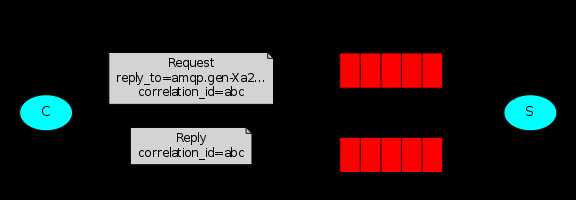

1.6 Remote procedure call (RPC)/RabbitMQ rpc实现

fibonacci_rpc = FibonacciRpcClient() result = fibonacci_rpc.call(4) print("fib(4) is %r" % result)

RPC server:

import pika import time connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) channel = connection.channel() channel.queue_declare(queue=‘rpc_queue‘) def fib(n): if n == 0: return 0 elif n == 1: return 1 else: return fib(n-1) + fib(n-2) def on_request(ch, method, props, body): n = int(body) print(" [.] fib(%s)" % n) response = fib(n) ch.basic_publish(exchange=‘‘, routing_key=props.reply_to, properties=pika.BasicProperties(correlation_id = props.correlation_id), body=str(response)) ch.basic_ack(delivery_tag = method.delivery_tag) channel.basic_qos(prefetch_count=1) channel.basic_consume(on_request, queue=‘rpc_queue‘) print(" [x] Awaiting RPC requests") channel.start_consuming()

RPC client:

import pika import uuid class FibonacciRpcClient(object): def __init__(self): self.connection = pika.BlockingConnection(pika.ConnectionParameters( host=‘localhost‘)) self.channel = self.connection.channel() result = self.channel.queue_declare(exclusive=True) self.callback_queue = result.method.queue self.channel.basic_consume(self.on_response, #只要一收到消息就调用on_response

no_ack=True, queue=self.callback_queue) def on_response(self, ch, method, props, body): if self.corr_id == props.correlation_id: self.response = body def call(self, n): self.response = None self.corr_id = str(uuid.uuid4()) self.channel.basic_publish(exchange=‘‘, routing_key=‘rpc_queue‘, properties=pika.BasicProperties( reply_to = self.callback_queue, correlation_id = self.corr_id, ), body=str(n)) while self.response is None: self.connection.process_data_events() #非阻塞版的start_consuming return int(self.response) fibonacci_rpc = FibonacciRpcClient() print(" [x] Requesting fib(30)") response = fibonacci_rpc.call(30) print(" [.] Got %r" % response)

2 redis

缓存系统:mongodb/redis/memcache

redis是一个key-value存储系统。和Memcached类似,它支持存储的value类型相对更多,包括string(字符串)、list(链表)、set(集合)、zset(sorted set--有序集合)和hash(哈希类型)。这些数据类型都支持push/pop、add/remove及取交集并集和差集及更丰富的操作,而且这些操作都是原子性的。在此基础上,redis支持各种不同方式的排序。与memcached一样,为了保证效率,数据都是缓存在内存中。区别的是redis会周期性的把更新的数据写入磁盘或者把修改操作写入追加的记录文件,并且在此基础上实现了master-slave(主从)同步。

2.1 Redis安装和基本使用

wget http://download.redis.io/releases/redis-3.0.6.tar.gz tar xzf redis-3.0.6.tar.gz cd redis-3.0.6 make

启动服务端

src/redis-server

启动客户端

src/redis-cli redis> set foo bar OK redis> get foo "bar"

redis-py 的API的使用可以分类为:

2.1 操作模式

redis-py提供两个类Redis和StrictRedis用于实现Redis的命令,StrictRedis用于实现大部分官方的命令,并使用官方的语法和命令,Redis是StrictRedis的子类,用于向后兼容旧版本的redis-py。

import redis r = redis.Redis(host=‘10.211.55.4‘, port=6379) r.set(‘foo‘, ‘Bar‘) print r.get(‘foo‘)

2.2 连接池

redis-py使用connection pool来管理对一个redis server的所有连接,避免每次建立、释放连接的开销。默认,每个Redis实例都会维护一个自己的连接池。可以直接建立一个连接池,然后作为参数Redis,这样就可以实现多个Redis实例共享一个连接池。

import redis pool = redis.ConnectionPool(host=‘10.211.55.4‘, port=6379) r = redis.Redis(connection_pool=pool) r.set(‘foo‘, ‘Bar‘) print r.get(‘foo‘)

3 操作

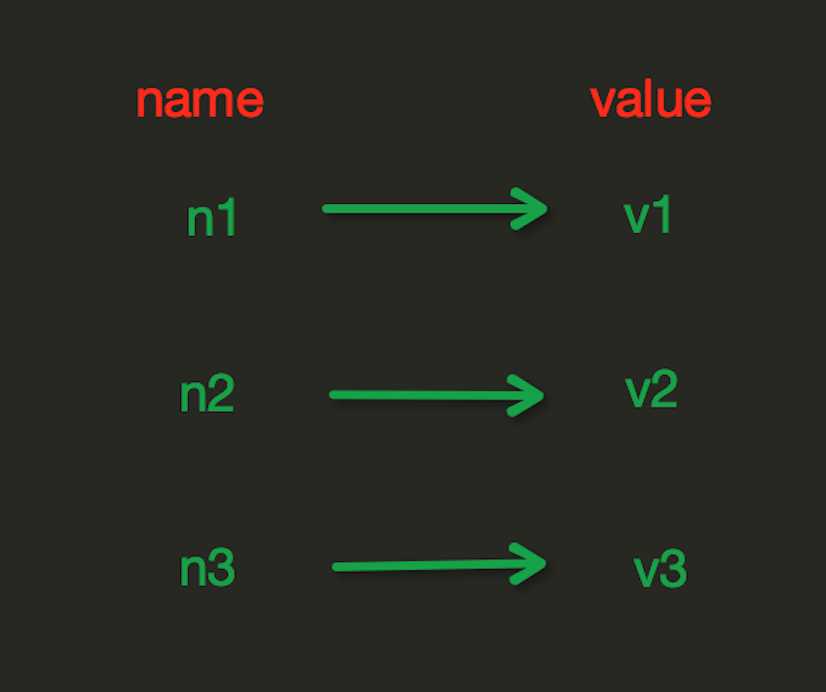

3.1 string操作

edis中的String在在内存中按照一个name对应一个value来存储。如图:

在Redis中设置值,默认,不存在则创建,存在则修改

参数:

ex,过期时间(秒)

px,过期时间(毫秒)

nx,如果设置为True,则只有name不存在时,当前set操作才执行

xx,如果设置为True,则只有name存在时,岗前set操作才执行

设置值,只有name不存在时,执行设置操作(添加)

设置值

参数:

time,过期时间(数字秒 或 timedelta对象)

设置值

参数:

time_ms,过期时间(数字毫秒 或 timedelta对象)

批量设置值 如: mset(k1=‘v1‘, k2=‘v2‘)或mget({‘k1‘: ‘v1‘, ‘k2‘: ‘v2‘})

获取值

批量获取 如: mget(‘name‘, ‘age‘)或r.mget([‘name‘, ‘age‘])

getset(name, value)

设置新值并获取原来的值

# 对name对应值的二进制表示的位进行操作 # 参数: # name,redis的name # offset,位的索引(将值变换成二进制后再进行索引) # value,值只能是 1 或 0 # 注:如果在Redis中有一个对应: n1 = "foo", 那么字符串foo的二进制表示为:01100110 01101111 01101111 所以,如果执行 setbit(‘n1‘, 7, 1),则就会将第7位设置为1, 那么最终二进制则变成 01100111 01101111 01101111,即:"goo" # 扩展,转换二进制表示: # source = "周新玉" source = "foo" for i in source: num = ord(i) print bin(num).replace(‘b‘,‘‘)

*用途举例,用最省空间的方式,存储在线用户数及分别是哪些用户在线

获取name对应的值的二进制表示中的某位的值 (0或1)

获取name对应的值的二进制表示中 1 的个数

参数:

key,Redis的name

start,位起始位置

end,位结束位置

返回name对应值的字节长度(一个汉字3个字节)

incr(self, name, amount=1)

自增 name对应的值,当name不存在时,则创建name=amount,否则,则自增。

参数:

name,Redis的name

amount,自增数(必须是整数)

注:同incrby

自增 name对应的值,当name不存在时,则创建name=amount,否则,则自增。

参数:

name,Redis的name

amount,自增数(浮点型)

自减 name对应的值,当name不存在时,则创建name=amount,否则,则自减。

参数:

name,Redis的name

amount,自减数(整数)

在redis name对应的值后面追加内容

参数:

key, redis的name

value, 要追加的字符串

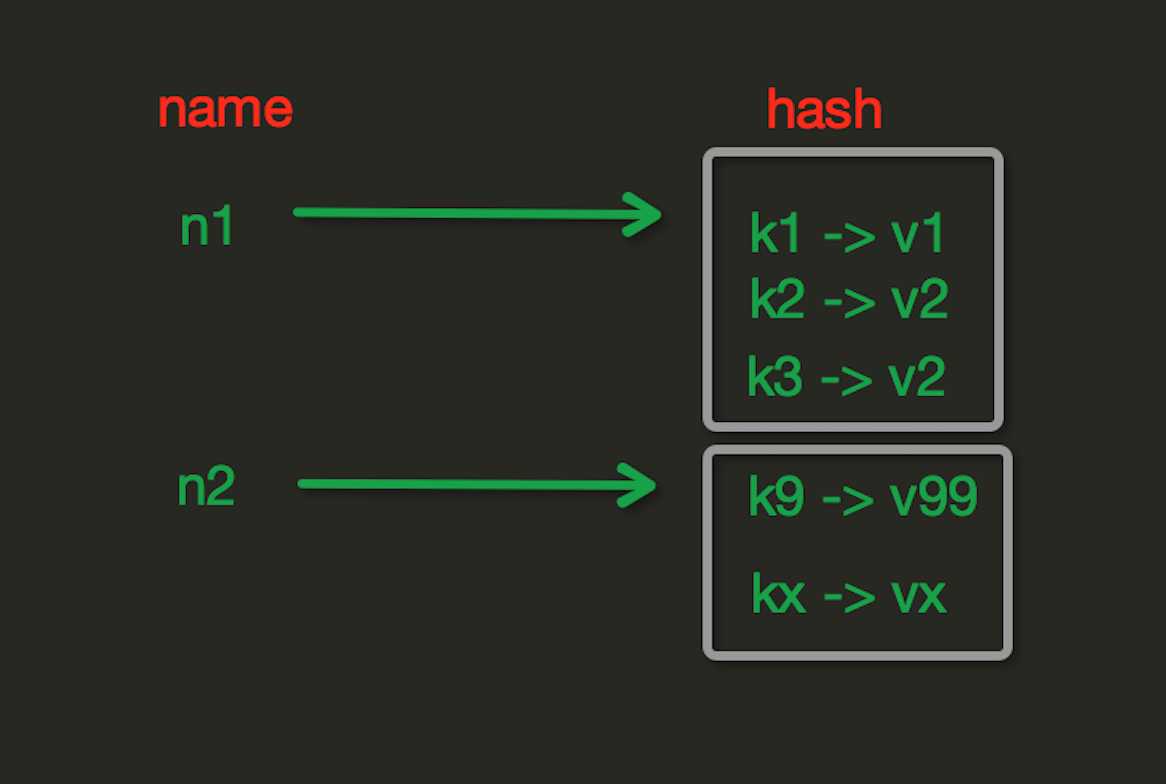

3.2 hash操作

hash表现形式上有些像pyhton中的dict,可以存储一组关联性较强的数据 , redis中Hash在内存中的存储格式如下图:

name对应的hash中设置一个键值对(不存在,则创建;否则,修改)

参数:

name,redis的name

key,name对应的hash中的key

value,name对应的hash中的value

注:

hsetnx(name, key, value),当name对应的hash中不存在当前key时则创建(相当于添加)

在name对应的hash中批量设置键值对 参数: name,redis的name mapping,字典,如:{‘k1‘:‘v1‘, ‘k2‘: ‘v2‘} 如: r.hmset(‘xx‘, {‘k1‘:‘v1‘, ‘k2‘: ‘v2‘})

在name对应的hash中获取根据key获取value

在name对应的hash中获取多个key的值 参数: name,reids对应的name keys,要获取key集合,如:[‘k1‘, ‘k2‘, ‘k3‘] *args,要获取的key,如:k1,k2,k3 如: r.mget(‘xx‘, [‘k1‘, ‘k2‘])或r.hmget(‘xx‘, ‘k1‘, ‘k2‘)

获取name对应hash的所有键值

获取name对应的hash中键值对的个数

获取name对应的hash中所有的value的值

检查name对应的hash是否存在当前传入的key

将name对应的hash中指定key的键值对删除

自增name对应的hash中的指定key的值,不存在则创建key=amount

参数:

name,redis中的name

key, hash对应的key

amount,自增数(整数)

自增name对应的hash中的指定key的值,不存在则创建key=amount

参数:

name,redis中的name

key, hash对应的key

amount,自增数(浮点数)

自增name对应的hash中的指定key的值,不存在则创建key=amount

增量式迭代获取,对于数据大的数据非常有用,hscan可以实现分片的获取数据,并非一次性将数据全部获取完,从而放置内存被撑爆

参数:

name,redis的name

cursor,游标(基于游标分批取获取数据)

match,匹配指定key,默认None 表示所有的key

count,每次分片最少获取个数,默认None表示采用Redis的默认分片个数

如:

hscan info 0 match n*

利用yield封装hscan创建生成器,实现分批去redis中获取数据 参数: match,匹配指定key,默认None 表示所有的key count,每次分片最少获取个数,默认None表示采用Redis的默认分片个数 如: for item in r.hscan_iter(‘xx‘): print item

3.3 list操作

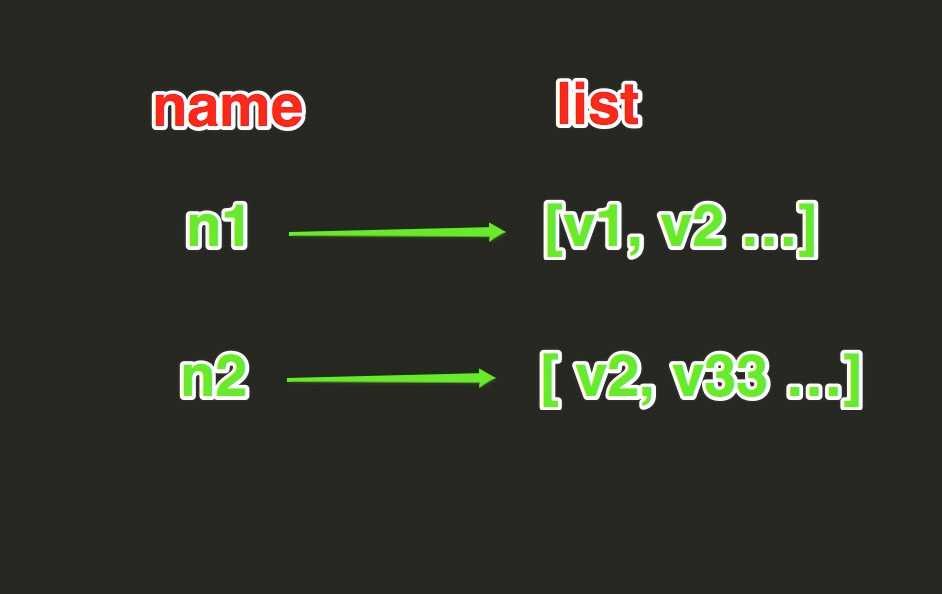

List操作,redis中的List在在内存中按照一个name对应一个List来存储。如图:

在name对应的list中添加元素,每个新的元素都添加到列表的最左边 如: r.lpush(‘oo‘, 11,22,33) 保存顺序为: 33,22,11 扩展: rpush(name, values) 表示从右向左操作

在name对应的list中添加元素,只有name已经存在时,值添加到列表的最左边

更多:

rpushx(name, value) 表示从右向左操作

llen(name)

name对应的list元素的个数

在name对应的列表的某一个值前或后插入一个新值

参数:

name,redis的name

where,BEFORE或AFTER

refvalue,标杆值,即:在它前后插入数据

value,要插入的数据

对name对应的list中的某一个索引位置重新赋值

参数:

name,redis的name

index,list的索引位置

value,要设置的值

在name对应的list中删除指定的值 参数: name,redis的name value,要删除的值 num,num=0,删除列表中所有的指定值; num=2,从前到后,删除2个; num=-2,从后向前,删除2个

在name对应的列表的左侧获取第一个元素并在列表中移除,返回值则是第一个元素

在name对应的列表中根据索引获取列表元素

在name对应的列表分片获取数据

参数:

name,redis的name

start,索引的起始位置

end,索引结束位置

在name对应的列表中移除没有在start-end索引之间的值

参数:

name,redis的name

start,索引的起始位置

end,索引结束位置

从一个列表取出最右边的元素,同时将其添加至另一个列表的最左边

参数:

src,要取数据的列表的name

dst,要添加数据的列表的name

从一个列表的右侧移除一个元素并将其添加到另一个列表的左侧

参数:

src,取出并要移除元素的列表对应的name

dst,要插入元素的列表对应的name

timeout,当src对应的列表中没有数据时,阻塞等待其有数据的超时时间(秒),0 表示永远阻塞

3.4 set集合操作

name对应的集合中添加元素

获取name对应的集合中元素个数

在name1对应的集合中且不在其他name对应的集合的元素集合

如:sdiff name1 name2

获取第一个name对应的集合中且不在其他name对应的集合,再将其新加入到dest对应的集合中

sinter(keys, *args)

获取多一个name对应集合的交集

获取多一个name对应集合的交集,再讲其加入到dest对应的集合中

检查value是否是name对应的集合的成员

获取name对应的集合的所有成员

将某个成员从一个集合中移动到另外一个集合

从集合的右侧(尾部)移除一个成员,并将其返回

从name对应的集合中随机获取numbers个元素

在name对应的集合中删除某些值

获取多一个name对应的集合的并集

获取多一个name对应的集合的并集,并将结果保存到dest对应的集合中

同字符串的操作,用于增量迭代分批获取元素,避免内存消耗太大

3.5 有序集合操作

对于有序集合,每一个元素有两个值,即:值和分数,分数专门用来做排序。

在name对应的有序集合中添加元素 如:zadd(‘zz‘, ‘n1‘, 1, ‘n2‘, 2)或zadd(‘zz‘, n1=11, n2=22)

获取name对应的有序集合元素的数量

获取name对应的有序集合中分数 在 [min,max] 之间的个数

按照索引范围获取name对应的有序集合的元素 参数: name,redis的name start,有序集合索引起始位置(非分数) end,有序集合索引结束位置(非分数) desc,排序规则,默认按照分数从小到大排序 withscores,是否获取元素的分数,默认只获取元素的值 score_cast_func,对分数进行数据转换的函数 更多: 从大到小排序: zrevrange(name, start, end, withscores=False, score_cast_func=float) 按照分数范围获取name对应的有序集合的元素: zrangebyscore(name, min, max, start=None, num=None, withscores=False, score_cast_func=float) 从大到小排序: zrevrangebyscore(name, max, min, start=None, num=None, withscores=False, score_cast_func=float)

获取某个值在 name对应的有序集合中的排行(从 0 开始)

更多:

zrevrank(name, value),从大到小排序

删除name对应的有序集合中值是values的成员 如:zrem(‘zz‘, [‘s1‘, ‘s2‘])

根据排行范围删除

根据分数范围删除

获取name对应有序集合中 value 对应的分数

获取两个有序集合的交集,如果遇到相同值不同分数,则按照aggregate进行操作

aggregate的值为: SUM MIN MAX

获取两个有序集合的并集,如果遇到相同值不同分数,则按照aggregate进行操作

aggregate的值为: SUM MIN MAX

同字符串相似,相较于字符串新增score_cast_func,用来对分数进行操作

3.6 其他操作

切换db,redis共有16个db

根据删除redis中的任意数据类型

检测redis的name是否存在

根据模型获取redis的name 更多: KEYS * 匹配数据库中所有 key 。 KEYS h?llo 匹配 hello , hallo 和 hxllo 等。 KEYS h*llo 匹配 hllo 和 heeeeello 等。 KEYS h[ae]llo 匹配 hello 和 hallo ,但不匹配 hillo

对redis的name重命名为

将redis的某个值移动到指定的db下,db中有key则不移动

获取name对应值的类型

为某个redis的某个name设置超时时间

随机获取一个redis的name(不删除)

同字符串操作,用于增量迭代获取key

4 管道

redis-py默认在执行每次请求都会创建(连接池申请连接)和断开(归还连接池)一次连接操作,如果想要在一次请求中指定多个命令,则可以使用pipline实现一次请求指定多个命令,并且默认情况下一次pipline 是原子性操作。

import redis pool = redis.ConnectionPool(host=‘10.211.55.4‘, port=6379) r = redis.Redis(connection_pool=pool) # pipe = r.pipeline(transaction=False) pipe = r.pipeline(transaction=True) pipe.set(‘name‘, ‘zhouxy‘) pipe.set(‘role‘, ‘student‘) pipe.execute()

5 发布订阅

redis helper:

import redis class RedisHelper: def __init__(self): self.__conn = redis.Redis(host=‘10.211.55.4‘) self.chan_sub = ‘fm104.5‘ self.chan_pub = ‘fm104.5‘ def public(self, msg): self.__conn.publish(self.chan_pub, msg) return True def subscribe(self): pub = self.__conn.pubsub() #打开收音机 pub.subscribe(self.chan_sub) #调收音频道 pub.parse_response() #准备接收 return pub

订阅者:

from monitor.RedisHelper import RedisHelper obj = RedisHelper() redis_sub = obj.subscribe() while True: msg= redis_sub.parse_response() print msg

发布者:

from monitor.RedisHelper import RedisHelper obj = RedisHelper() obj.public(‘hello‘)

更多redis命令参考:http://doc.redisfans.com

标签:个数 reg events 链接 记录 数据类型 版本 localhost 负载均衡

原文地址:https://www.cnblogs.com/cirr-zhou/p/8976294.html