标签:16px 提升 http rom features sed hot enter --

Multi-attention Network for One Shot Learning

2018-05-15 22:35:50

本文的贡献点在于:

1. 表明类别标签信息对 one shot learning 可以提供帮助,并且设计一种方法来挖掘该信息;

2. 提出一种 attention network 来产生 attention maps for creating the image representation of an exemplar image in novel class based on its class tag.

3. 进一步的提出一种 multi-attention scheme 来提升模型的表现;

4. 收集了两个新的数据集,并且构建了一个评价标准。

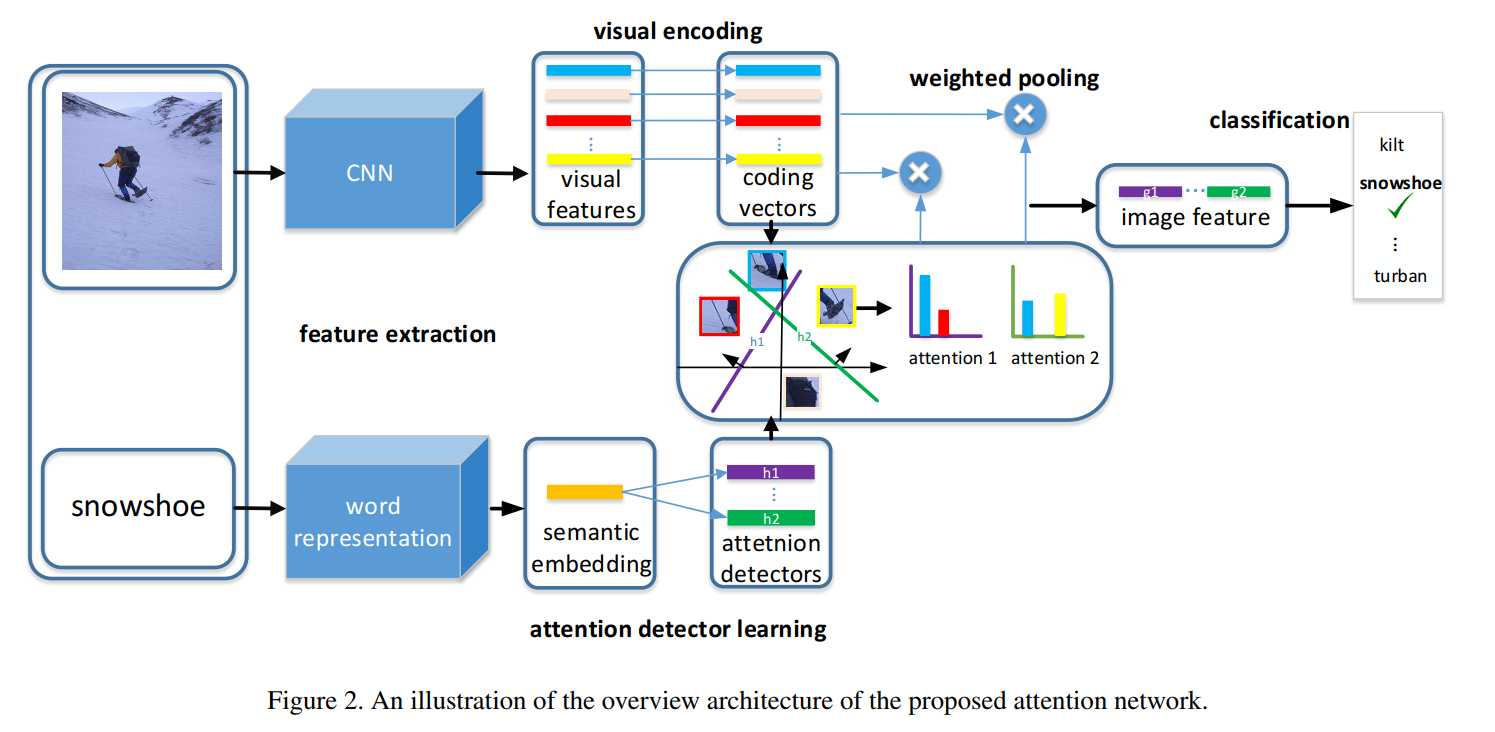

本文的流程图:

Attention Map Generation:

本文 attention value 的计算也是依赖于 visual feature 和 language feature 之间的响应。大致过程如下:

1. 首先用 Word embedding 的方法,得到类别标签的特征 c,然后将该 feature 进一步的学习,可以用 lstm 或者 fc layer,即:

![]()

其中,w 和 b 都是可学习的模型参数。

2. 在得到 hidden state 之后,我们将其与 visual feature 进行相乘,得到响应:

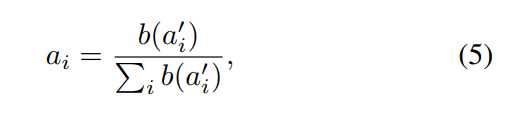

3. 将 attention value 进行归一化处理:

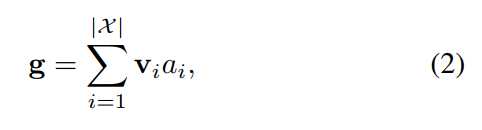

4. 将attention values 和 features 进行相乘,得到加权之后的 feature:

Multi-Attention Mechanism:

此处的 multi-attention mechanism 就是刚刚那个机制的一个拓展,用不同的参数,得到不同角度的 attention value。

![]()

--- Done !

Multi-attention Network for One Shot Learning

标签:16px 提升 http rom features sed hot enter --

原文地址:https://www.cnblogs.com/wangxiaocvpr/p/9043590.html