标签:pca 两种 info 好的 enc 分享图片 降维 无监督学习 线性

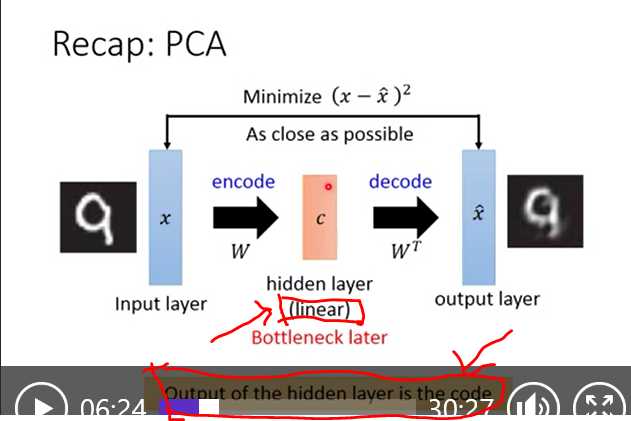

PCA简介:【线性】原矩阵乘以过渡矩阵W得到新的矩阵,原矩阵和新矩阵是同样的东西,只是通过W换基。

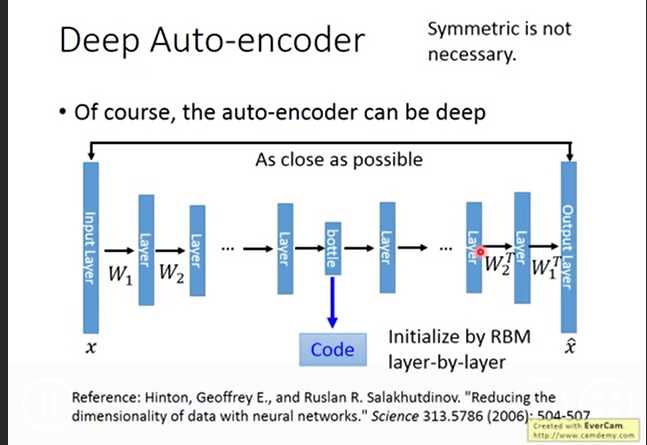

自编码:

自编码和PCA的区别:

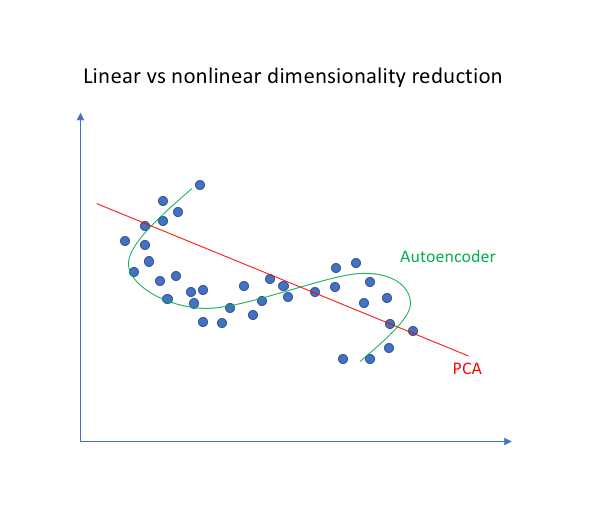

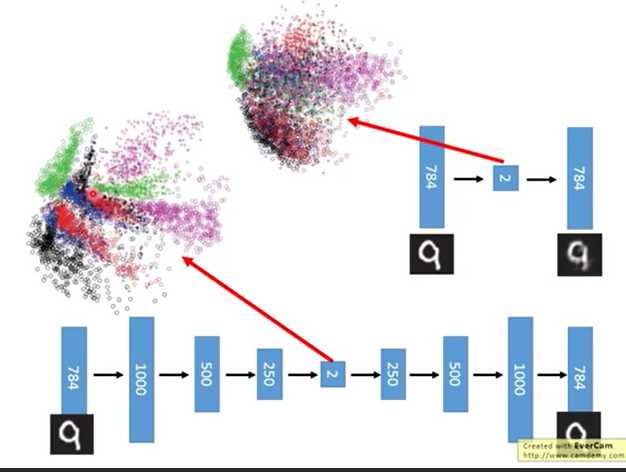

由于神经网络能够学习非线性关系,因此可以认为这是PCA更有力(非线性)的泛化。而PCA试图发现描述原始数据的低维超平面,自编码器则能够学习非线性流形(流形为连续的非交叉的曲面)。这两种方法之间的区别如下图所示。

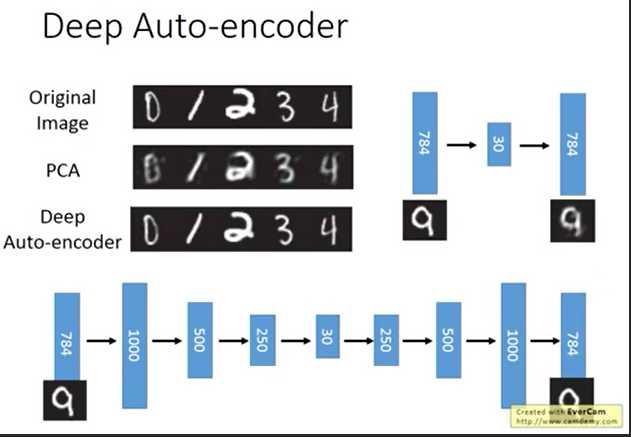

自编码还原的结果比PCA清晰。

而两者的重点是要拿到比较好的30维code。

标签:pca 两种 info 好的 enc 分享图片 降维 无监督学习 线性

原文地址:https://www.cnblogs.com/Lee-yl/p/10109764.html