标签:文件 插入 class 返回 为我 request 服务 使用 一条龙

很多时候呢,我们都是读取本地HTML文件来进行爬虫练手,但每次都要手打不同的HTML明显耗时耗力;

还有些小伙伴不喜欢F12,偏偏喜欢在Pycharm中查看HTML的源代码;

……

难道每次都只能“复制——新建——粘贴——保存”一条龙服务吗?

不不不,我们还有Python的第三方库——urllib。

urllib模块是模拟浏览器去访问URL地址,然后拿到服务器响应回来的数据,也就是整个HTML文件。

import urllib.request as ur

# urlopen返回的是一个HTTPResponse对象,需使用read方法。

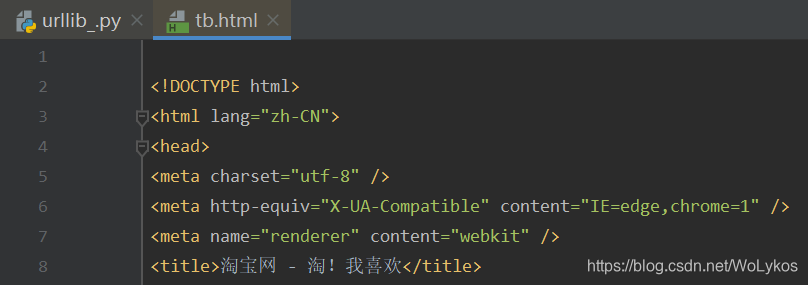

ret = ur.urlopen('https://www.taobao.com/').read()

print(ret)

# 写入文件,'wb'为写入二进制文件

with open('tb.html', 'wb') as f:

f.write(ret)

为我心爱的女孩~~

标签:文件 插入 class 返回 为我 request 服务 使用 一条龙

原文地址:https://www.cnblogs.com/WoLykos/p/12095181.html