标签:rom requests 持久 __name__ request main ext pip response

聚焦爬虫:爬取页面中指定的页面内容。

1.指定url

2.发起请求

3.获取响应数据

4.数据解析

5.持久化存储

1.bs4

2.正则

3.xpath (***)

解析的局部的文本内容都会在标签之间或者标签对应的属性中进行存储

1.进行指定标签的定位

2.标签或者标签对应的属性中存储的数据值进行提取(解析)

1.标签定位

2.提取标签、标签属性中存储的数据值

1.实例化一个BeautifulSoup对象,并且将页面源码数据加载到该对象中

2.通过调用BeautifulSoup对象中相关的属性或者方法进行标签定位和数据提取

pip install bs4 -i https://pypi.tuna.tsinghua.edu.cn/simple

pip install lxml -i https://pypi.tuna.tsinghua.edu.cn/simple

from bs4 import BeautifulSoup

对象的实例化:

1.将本地的html文档中的数据加载到该对象中

fp = open(‘./test.html‘,‘r‘,encoding=‘utf-8‘)

soup = BeautifulSoup(fp,‘lxml‘)

2.将互联网上获取的页面源码加载到该对象中(常用方法,推荐)

page_text = response.text

soup = BeatifulSoup(page_text,‘lxml‘)

soup.tagName:返回的是文档中第一次出现的tagName对应的标签

soup.find():

find(‘tagName‘):等同于soup.div

- 属性定位:

soup.find(‘div‘,class_/id/attr=‘song‘)

soup.find_all(‘tagName‘):返回符合要求的所有标签(列表)

select:

select(‘某种选择器(id,class,标签...选择器)‘),返回的是一个列表。

2.层级选择器:

soup.select(‘.tang > ul > li > a‘):>表示的是一个层级

soup.select(‘.tang > ul a‘):空格表示的多个层级

3.获取标签之间的文本数据:

soup.a.text/string/get_text()

text/get_text():可以获取某一个标签中所有的文本内容

string:只可以获取该标签下面直系的文本内容

4.获取标签中属性值:

soup.a[‘href‘]

import requests

from bs4 import BeautifulSoup

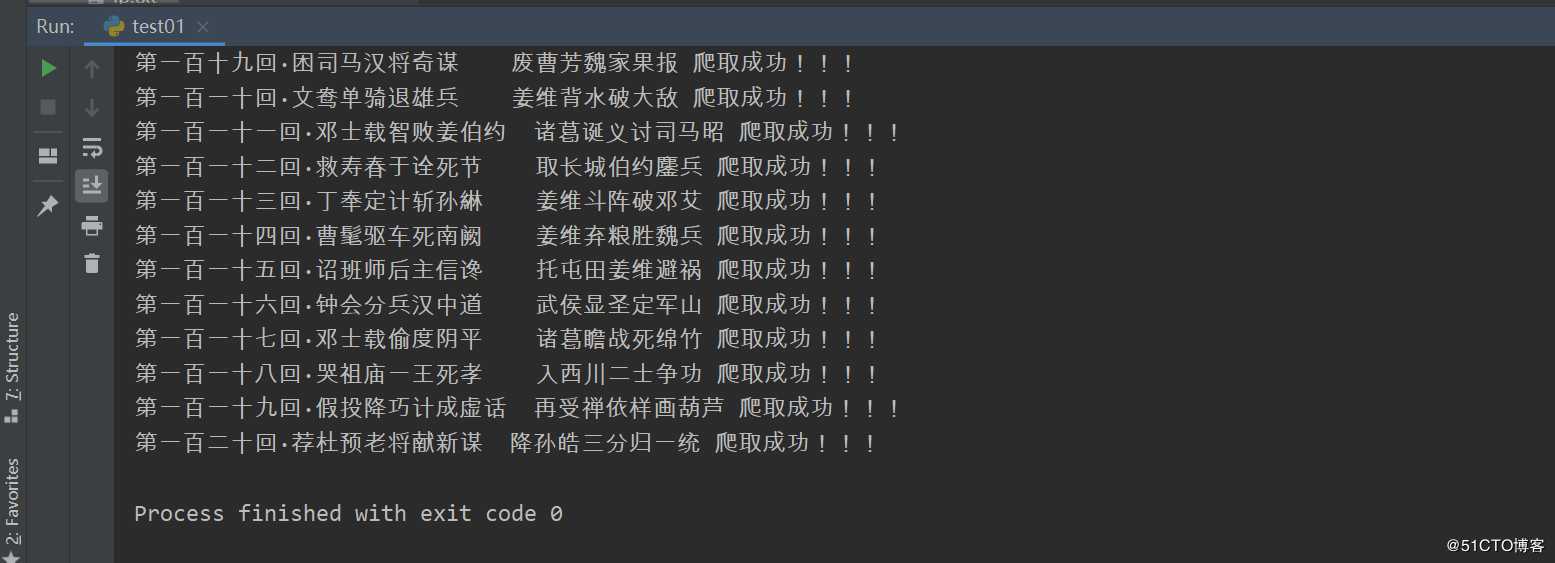

if __name__ == "__main__":

#对首页的页面数据进行爬取

headers = {

‘User-Agent‘: ‘Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_0) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/72.0.3626.121 Safari/537.36‘

}

url = ‘http://www.shicimingju.com/book/sanguoyanyi.html‘

page_text = requests.get(url=url,headers=headers).text

#在首页中解析出章节的标题和详情页的url

#实例化BeautifulSoup对象,需要将页面源码数据加载到该对象中

soup = BeautifulSoup(page_text,‘lxml‘)

#解析章节标题和详情页的url

li_list = soup.select(‘.book-mulu > ul > li‘)

fp = open(‘./sanguo.txt‘,‘w‘,encoding=‘utf-8‘)

for li in li_list:

title = li.a.string

detail_url = ‘http://www.shicimingju.com‘+li.a[‘href‘]

#对详情页发起请求,解析出章节内容

detail_page_text = requests.get(url=detail_url,headers=headers).text

#解析出详情页中相关的章节内容

detail_soup = BeautifulSoup(detail_page_text,‘lxml‘)

div_tag = detail_soup.find(‘div‘,class_=‘chapter_content‘)

#解析到了章节的内容

content = div_tag.text

fp.write(title+‘:‘+content+‘\n‘)

print(title,‘爬取成功!!!‘)

1.在平时使用最多的数据解析方法是xpath,这里bs4方法了解即可

2.其他bs4的案例可以参考我的博客

https://blog.51cto.com/13760351/2500048

标签:rom requests 持久 __name__ request main ext pip response

原文地址:https://blog.51cto.com/13760351/2512512