标签:影响 失败 手动 err ethernet 传输 src ifd 加载

前言双网卡绑定单个IP 地址 为了提供网络的高可用性,我们可能需要将多块网卡绑定成一块虚拟网卡对外提供服务,这样即使其中的一块物理网卡出现故障,也不会导致连接中断。

bond在Linux下叫bonding,IBM称为etherchanel,broadcom叫team,但是名字怎么变,效果都是将两块或更多的网卡当做一块网卡使用,在增加带宽的同时也可以提高冗余性。

bond技术提供了(0-6)共7种工作模式,分别如下:

* mode=0 round-robin轮询策略(balance-rr)

* mode=1 active-backup主备策略(active-backup)

* mode=2 load balancing (xor)异或策略(balance-xor)

* mode=3 fault-tolerance (broadcast)广播策略(broadcast)

* mode=4 lacp IEEE 802.3ad 动态链路聚合(IEEE 802.3ad Dynamic link aggregation) (802.3ad)

* mode=5 transmit load balancing适配器传输负载均衡(balance-tlb)

* mode=6 adaptive load balancing适配器负载均衡(balance-alb)常用的就三种,如下:

* mode=0:默认,平衡负载模式,有自动备援,但需要配置交换机。

* mode=1:主备模式,其中一条线若断线,其他线路将会自动备援,不需要配置交换机。

* mode=6:平衡负载模式,有自动备援,不需要配置交换机。至于其他的模式,解释如下:

* mode=2:选择网卡的序号=(源MAC地址 XOR 目标MAC地址) % Slave网卡(从网卡)的数量,

其他的传输策略可以通过xmit_hash_policy配置项指定

* mode=3:使用广播策略,数据包会被广播至所有Slave网卡进行传送

* mode=4:使用动态链接聚合策略,启动时会创建一个聚合组,所有Slave网卡共享同样的速率和双工设定

但是,mode4有两个必要条件:

1.支持使用ethtool工具获取每个slave网卡的速率和双工设定;

2.需要交换机支持IEEE 802.3ad 动态链路聚合(Dynamic link aggregation)模式

* mode=5:基于每个slave网卡的速率选择传输网卡。必要条件:支持使用ethtool工具获取每个slave网卡的速率。多网卡bond配置

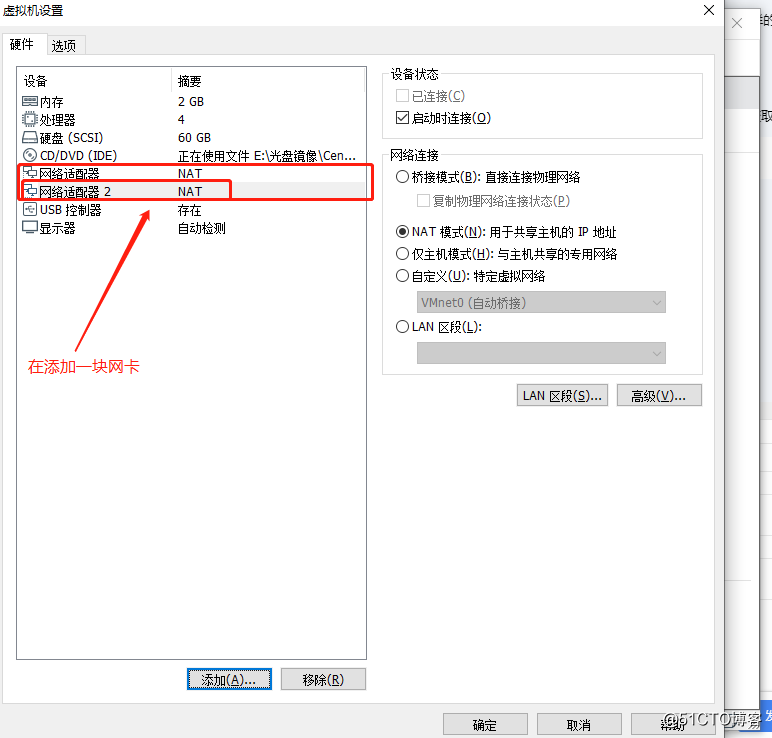

1)、添加网卡,手动创建配置文件如下:

//加载bonding模块,并确认已经加载

[root@bond ~]# modprobe --first-time bonding

[root@bond ~]# lsmod | grep bonding

bonding 141566 0

//编辑bond1配置文件

[root@bond ~]# vim /etc/sysconfig/network-scripts/ifcfg-bond1

DEVICE=bond1

TYPE=Bond

IPADDR=192.168.45.111

NETMASK=255.255.255.0

GATEWAY=192.168.45.254

DNS1=114.114.114.114

DNS2=8.8.8.8

USERCTL=no

BOOTPROTO=none

ONBOOT=yes

//修改ens33配置文件

[root@bond ~]# vim /etc/sysconfig/network-scripts/ifcfg-ens33

DEVICE=ens33

TYPE=Ethernet

ONBOOT=yes

BOOTPROTO=none

DEFROUTE=yes

IPV4_FAILURE_FATAL=no

NMAE=ens33

MASTER=bond1

SLAVE=yes

//修改ens36配置文件

[root@bond ~]# vim /etc/sysconfig/network-scripts/ifcfg-ens36

DEVICE=ens36

TYPE=Ethernet

ONBOOT=yes

BOOTPROTO=none

DEFROUTE=yes

IPV4_FAILURE_FATAL=no

NMAE=ens36

MASTER=bond1

SLAVE=yes

//配置bonding

[root@bond ~]# vim /etc/modules-load.d/bonding.conf

alias bond1 bonding

options bonding mode=1 miimon=200

以下重启网络后查看各个网卡的信息

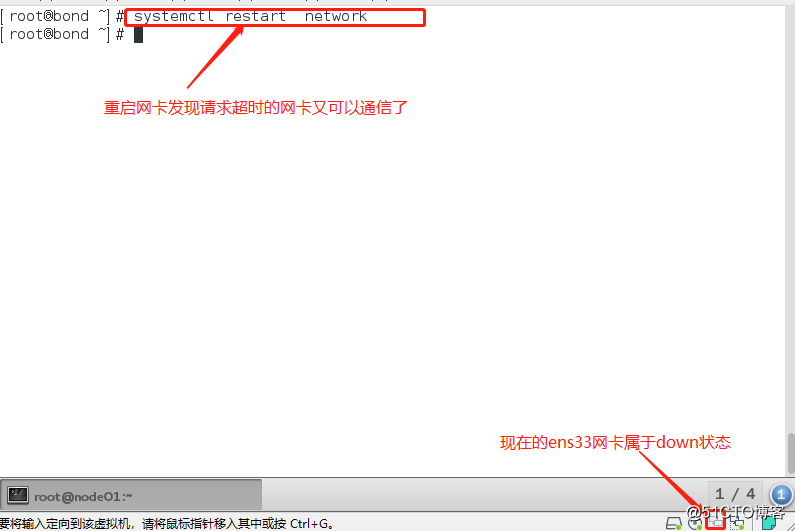

//重启网卡使配置生效

[root@web01 ~]# systemctl restart network

//如果重启失败,则说明bond没配置成

[root@bond ~]# ip a show ens33

2: ens33: <BROADCAST,MULTICAST,SLAVE,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast master bond1 state UP qlen 1000

link/ether 00:0c:29:33:22:73 brd ff:ff:ff:ff:ff:ff

[root@bond ~]# ip a show ens36

3: ens36: <BROADCAST,MULTICAST,SLAVE,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast master bond1 state UP qlen 1000

link/ether 00:0c:29:33:22:73 brd ff:ff:ff:ff:ff:ff

[root@bond ~]# ip a show bond1

7: bond1: <BROADCAST,MULTICAST,MASTER,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP qlen 1000

link/ether 00:0c:29:33:22:73 brd ff:ff:ff:ff:ff:ff

inet 192.168.45.111/24 brd 192.168.45.255 scope global bond1

valid_lft forever preferred_lft forever

inet6 fe80::20c:29ff:fe33:2273/64 scope link

valid_lft forever preferred_lft forever查看bond1相关信息

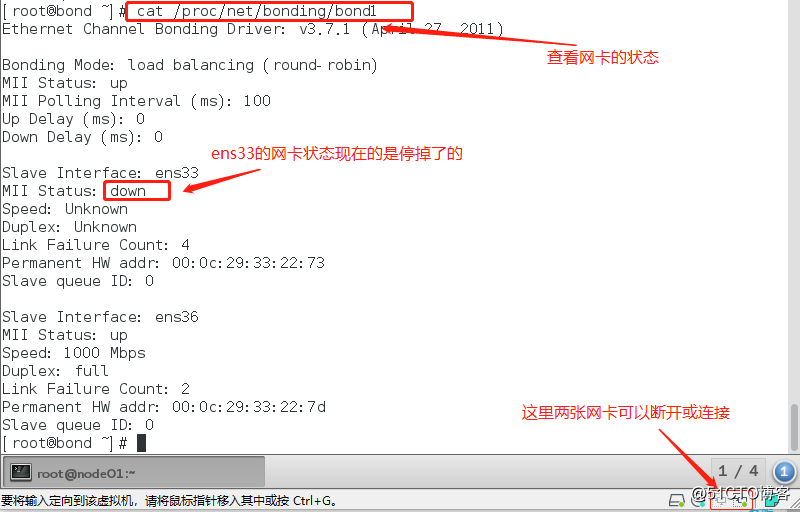

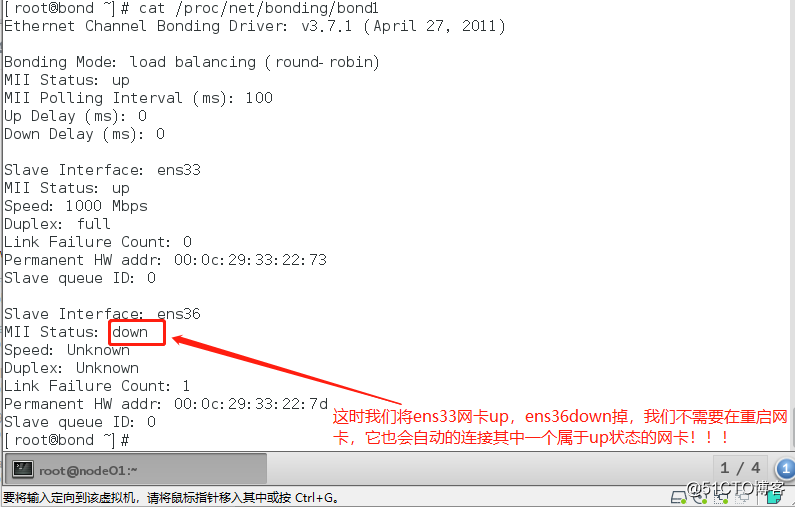

[root@bond ~]# cat /proc/net/bonding/bond1

Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011)

Bonding Mode: load balancing (round-robin) //绑定模式

MII Status: up //接口状态,表示以启用

MII Polling Interval (ms): 100

Up Delay (ms): 0

Down Delay (ms): 0

Slave Interface: ens33

MII Status: up //接口状态,表示以启用

Speed: 1000 Mbps //端口速率

Duplex: full

Link Failure Count: 0

Permanent HW addr: 00:0c:29:33:22:73 //接口永久MAC地址

Slave queue ID: 0

Slave Interface: ens36 //备用接口: ens36

MII Status: up //接口状态,表示以启用

Speed: 1000 Mbps

Duplex: full

Link Failure Count: 0

Permanent HW addr: 00:0c:29:33:22:7d

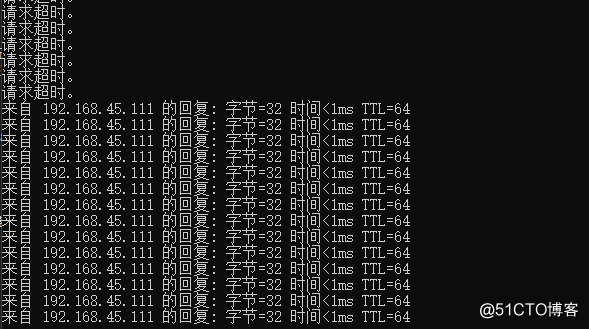

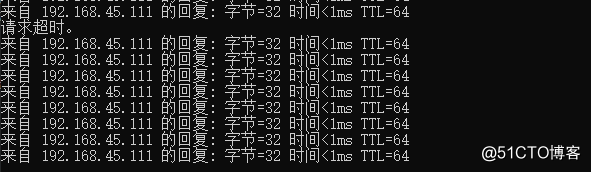

Slave queue ID: 0简单测试:

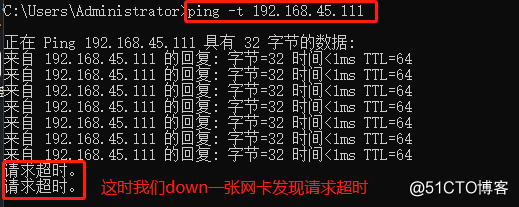

当做到这一步的时候,ens33或ens36中任意一块网卡down掉,都不会影响通信

注: 如果你是使用vmware workstaction虚拟机进行测试,请不要直接执行命令ifdown ens33或ifdown ens36进行测试,这样因为虚拟机的原因测试不到效果,可以在网络适配器里将已连接√给取消掉

标签:影响 失败 手动 err ethernet 传输 src ifd 加载

原文地址:https://blog.51cto.com/14306186/2524904