标签:png 权重 模型 load src 分类器 训练 样本 组合

AdaBoost,是英文"Adaptive Boosting"(自适应增强)的缩写。

Adaboost算法的思想:在前一轮识别过程中识别错误的样本会在下一轮中提升权重,而那些识别正确的样本会降低权重。

Adaboost算法的原理:(1)将每个样本的权重进行初始化。每一个样本的权重相同(2)训练弱分类器。训练过程中,某个样本被准确分类,那么在构造下一个训练集中,它的权重就被降低;某个样本没有被准确分类,那么在构造下一个训练集中,它的权重就被提升。在这个过程中,会得到弱分类器对应的话语权。(3)更新权值后的样本集被用于训练下一个弱分类器。(4)将各个弱分类器组合成强分类器。分类误差率小的弱分类器的话语权较大,分类误差率大的弱分类器的话语权较小。

提升树是以分类树或者回归树为基本分类器的提升方法。

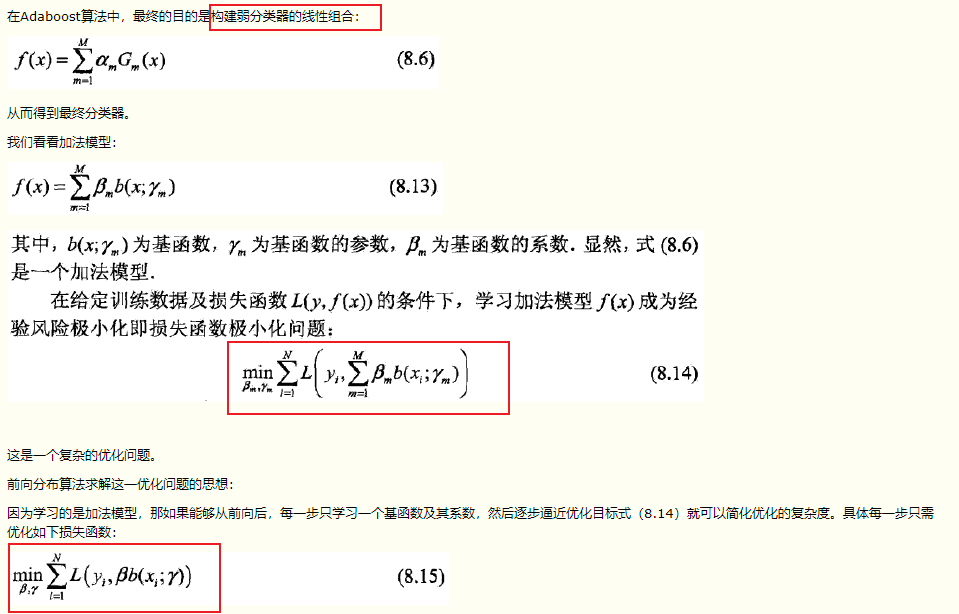

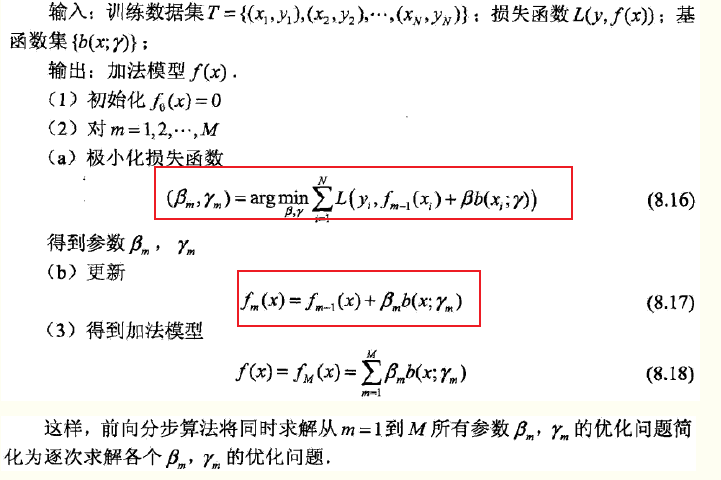

该算法实际上是前向分步算法的一个实现,在这个方法里,模型是加法模型,损失函数是指数损失,算法是前向分步算法。

前向分布算法:

标签:png 权重 模型 load src 分类器 训练 样本 组合

原文地址:https://www.cnblogs.com/hugrice/p/14675710.html