标签:

引入:二元分类问题

建模:判别学习算法(discriminative learning algorithm)直接根据P(y|x)【即给定特征x下的分类结果y】建模

之前我们用的算法(如logistic回归)就是判别学习算法

引入:还是二元分类问题

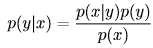

建模:生成学习算法(generative learning algorithm)对P(x|y)【即给定具体的一类y下的特征x】、P(y)建模,然后由bayes公式可求出P(y|x):

,注意其中P(X)= P(x|y=1)*P(y=1) + P(x|y=0)*P(y=0)

,注意其中P(X)= P(x|y=1)*P(y=1) + P(x|y=0)*P(y=0)

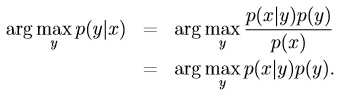

然而实际求解的时候并不用求P(x)。因为由上式还可推出这个:

其中 表示P(y|x)取最大值时y的值。

表示P(y|x)取最大值时y的值。

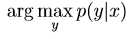

多元正太分布和普通的其实没什么两样,只不过参数变成了均值向量μ(mean vector)和协方差矩阵Σ(convariance matrix)

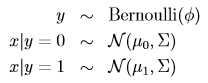

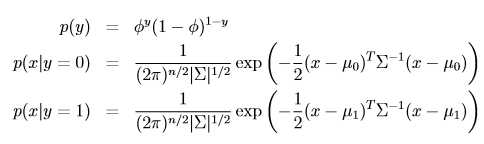

在GDA model中,我们用多元正态分布为P(x|y)建模:

,即

,即

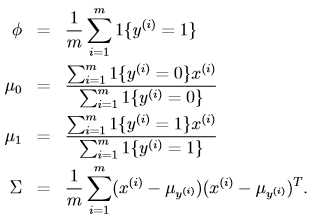

还是和原来的分析方法一样,求极大似然 -> log -> 求极值 。最后得

注意这里面一些符号的含义:

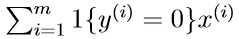

表示所有分类结果为0的X(i)的和【那个1可以理解为一个indicator function,大括号里表达式为true则值为1,否则为0】

表示所有分类结果为0的X(i)的和【那个1可以理解为一个indicator function,大括号里表达式为true则值为1,否则为0】

表示分类结果为1的样本的总数

表示分类结果为1的样本的总数

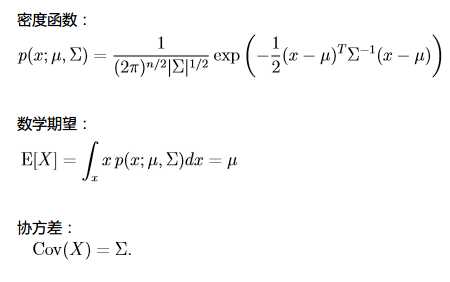

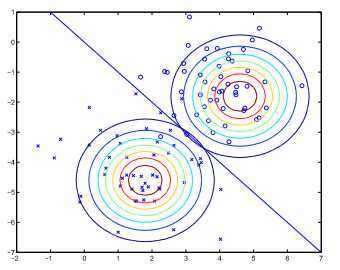

这个model其实就干了这么一件事:

如上图,两个饼表示对y=0和y=1的样本分别建立的正态分布模型,斜线即对样本分类的边界。两个饼大致相切在斜线附近

under construction

标签:

原文地址:http://www.cnblogs.com/pdev/p/4534812.html