标签:

近几年大数据越来越火热。由于工作需要以及个人兴趣,最近开始学习大数据相关技术。学习过程中的一些经验教训希望能通过博文沉淀下来,与网友分享讨论,作为个人备忘。

第一篇,在win7虚拟机下搭建hadoop2.6.0伪分布式环境。

1. 所需要的软件

使用Vmware 11.0搭建虚拟机,安装Ubuntu 14.04.2系统。

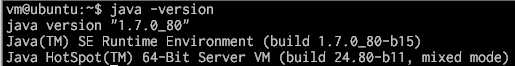

Jdk 1.7.0_80

Hadoop 2.6.0

2. 安装vmware和ubuntu

略

3. 在ubuntu中安装JDK

将jdk解压缩到目录:/home/vm/tools/jdk

在~/.bash_profile中配置环境变量,并通过source ~/.bash_profile生效。

|

#java export JAVA_HOME=/home/vm/tools/jdk export JRE_HOME=/home/vm/tools/jdk/jre export PATH=$JAVA_HOME/bin:$JRE_HOME/bin:$PATH export CLASSPATH=$JAVA_HOME/lib:$JRE_HOME/lib:$CLASSPATH |

检验jdk安装是否成功。

4. 配置ssh信任关系,实现无密码登录

4.1 安装ssh

Ubuntu默认安装了ssh客户端,但没有安装ssh服务端,因此可以通过apt-get安装。

安装ssh-server:sudo apt-get install openssh-server

如果没有ssh客户端,也可以通过apt-get安装。

安装ssh-client:sudo apt-get install openssh-client

启动ssh-server:sudo service ssh start

启动以后,通过ps –aux | grep sshd查看ssh服务器是否安装成功。

4.2 配置ssh信任关系

生成机器A的公私密钥对:ssh-keygen -t rsa,之后一路回车。在~/.ssh目录下生成公钥id_rsa.pub,私钥id_ras。

拷贝机器A的id_rsa.pub到机器B的认证文件中:

cat id_rsa.pub >> ~/.ssh/authorized_keys

这时候机器A到机器B的信任关系就建立好了,此时在机器A可以不需要密码直接ssh登录机器B了。

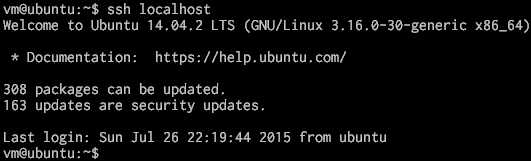

本例中机器A和B是同一台机器,配置ssh信任关系以后可以使用ssh localhost或者ssh 机器IP地址来验证。

5. 安装hadoop2.6.0

5.1 解压hadoop2.6.0

从官网下载hadoop-2.6.0.tar.gz,解压到目录/home/vm/tools/hadoop,并配置~/.bash_profile环境变量。通过source ~/.bash_profile生效。

|

#hadoop export HADOOP_HOME=/home/vm/tools/hadoop export PATH=$HADOOP_HOME/bin:$PATH export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib" |

5.2 修改配置文件

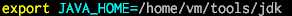

修改$HADOOP_HOME/etc/hadoop/hadoop-env.sh和yarn-evn.sh,配置JAVA_HOME路径:

修改$HADOOP_HOME/etc/hadoop/slaves,增加本机IP地址:

cat "192.168.62.129" >> slaves

修改$HADOOP_HOME/etc/hadoop/下的几个重要的*-site.xml:

core-site.xml 192.168.62.129是我虚拟机的IP地址

|

<configuration> <property> <name>fs.defaultFS</name> <value>hdfs://192.168.62.129:9000</value> </property> <property> <name>hadoop.tmp.dir</name> <value>file:/home/vm/app/hadoop/tmp</value> <description>a base for other temporary directories.</description> </property> </configuration> |

hdfs-site.xml

|

<configuration> <property> <name>dfs.replication</name> <value>1</value> </property> <property> <name>dfs.namenode.name.dir</name> <value>file:/home/vm/app/hadoop/dfs/nn</value> </property> <property> <name>dfs.namenode.data.dir</name> <value>file:/home/vm/app/hadoop/dfs/dn</value> </property> <property> <name>dfs.permissions</name> <value>false</value> <description> permission checking is turned off </description> </property> </configuration> |

mapred-site.xml

|

<configuration> <property> <name>mapred.job.tracker</name> <value>hdfs://192.168.62.129:9001</value> </property> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> </configuration> |

yarn-site.xml

|

<configuration> <!-- Site specific YARN configuration properties --> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> </configuration> |

5.3 格式化文件系统

在$HADOOP_HOME下执行bin/hdfs namenode –format格式化文件系统

5.4 启停

在$HADOOP_HOME下执行sbin/start-dfs.sh和sbin/start-yarn.sh启动hadoop集群,执行sbin/stop-dfs.sh和sbin/stop-yarn.sh停止hadoop集群。

启动过程例如:

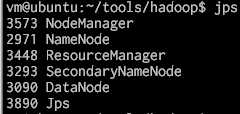

启动完毕进程如下:

6. 查询集群信息

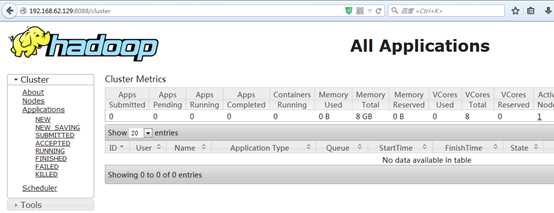

8088端口,查看All Applications信息:

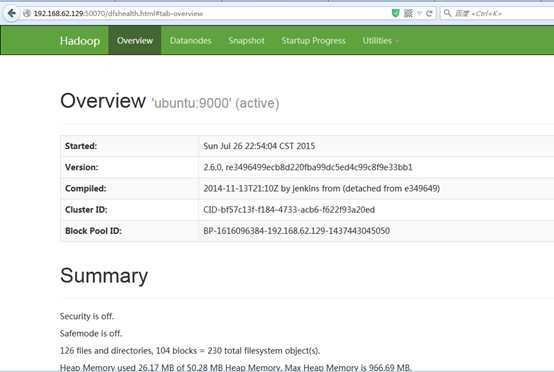

50070端口,查看hdfs信息:

7. 验证hadoop环境搭建是否成功

7.1 验证hdfs是否正常

可以使用各种hdfs命令测试。例如:

hdfs dfs -ls ./

hdfs dfs -put file.1 ./

hdfs dfs -get ./file1

hdfs dfs -rm -f ./file.1

hdfs dfs -cat ./file1

hdfs dfs -df -h

7.2 验证map/reduce计算框架是否正常

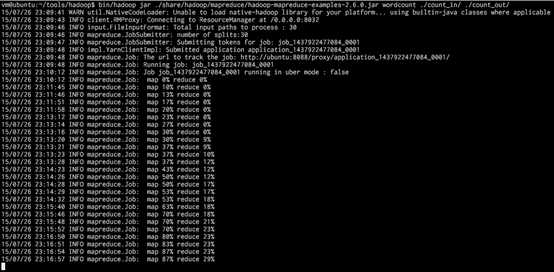

在$HADOOP_HOME目录下执行:bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-2.6.0.jar wordcount ./count_in/ ./count_out/

其中./count_in/提前在hdfs集群创建,统计该目录下所有文件的单词数量,输出到./count_out/目录。

执行过程示例如下:

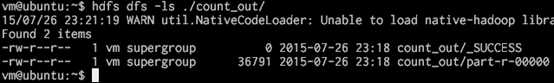

执行完毕生成结果:

至此,Hadoop2.6.0的伪分布式环境搭建完成。

标签:

原文地址:http://www.cnblogs.com/simplestupid/p/4679016.html