标签:

这里所谓的自学习,其实就是利用稀疏自编码器对无标签样本学习其特征

准备工作

(1)下载Yann Lecun的MNIST数据集

用到了如下的两个数据集:

程序开始

第0步:设置神经网络的结构

该神经网络包括三层:

输入层的神经元个数(数字识别,则设置输入的图像大小)

输出端的神经元个数(也就是类别数)

隐藏层神经元个数

另外一些关于系数编码的参数

sparsityParam、lambda、beta

最大迭代次数:maxIter

第一步:产生训练数据集和测试数据集

(1)导入数据集mnistData和mnistLabels

mnistData是一个矩阵,每一列为一个输入样本(也就是一个输入的数字图像所有像素点按列排布)

mnistLabels是一个向量,它存储的数字表示mnistData中每一列样本的类别

(2)将输入的样本集mnistData进行分组

① 首先,将mnistData分为两组:一组为有标签的数据集(数字0-4的样本),另一组为无标签的数据集(数字5-9的样本)

(这两组的指标集分别为labeledSet和unlabeledSet)

② 然后,再将有标签的数据集平均分为两组,一组作为训练集、一组作为测试集;

(这两组的指标集分别为trainSet和testSet)

这里的指标,指在mnistData中的列序号

③ 分别得到上述三组指标集得到相应的数据集,并得到有标签数据集的标签

unlabeledData:无标签数据集,每一列为一个样本

trainData:有标签训练集,每一列为一个样本,相应的标签存放在trainLabels中

testData:有标签测试集,每一列为一个样本,相应的标签存放在testLabels中

第二步:训练稀疏自编码器

利用无标签数据集unlabeledData训练稀疏自编码器

① 输出化自编码器的参数theta

② 调用minFunc中的最优化函数,计算得到稀疏自编码器的参数

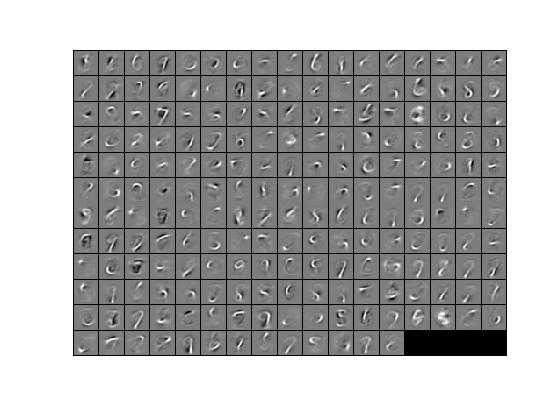

下图是学习得到的W1的图像

第三步:提取特征

在得到稀疏自编码器后,可以利用它从有标签的数据集中提取图像特征,这里需要完成feedForwardAutoencoder.m函数

所谓图像的特征,其实就是指该图像在稀疏自编码器的权值矩阵W1作用下得到的隐藏层的输出

可以得到训练集的特征trainFeatures和测试集的特征testFeatures

它们的每一列分别是由稀疏自编码器提取出的特征

第四步:训练softmax回归模型

利用训练集的特征集trainFeatures及其标签集trainLabels,训练softmax回归模型

第五步:对测试数据集进行分类

利用得到的softmax回归模型对测试集进行分类

标签:

原文地址:http://www.cnblogs.com/lutingting/p/4764630.html