标签:

本项目主要讲解了一套应用于互联网电商企业中,使用Java、Spark等技术开发的大数据统计分析平台,对电商网站的各种用户行为(访问行为、页面跳转行为、购物行为、广告点击行为等)进行复杂的分析。用统计分析出来的数据,辅助公司中的PM(产品经理)、数据分析师以及管理人员分析现有产品的情况,并根据用户行为分析结果持续改进产品的设计,以及调整公司的战略和业务。最终达到用大数据技术来帮助提升公司的业绩、营业额以及市场占有率的目标。

1.课程研发环境

开发工具: Eclipse

Linux:CentOS 6.4

Spark: 1.5.1

Hadoop: hadoop-2.5.0-cdh5.3.6

Hive: hive-0.13.1-cdh5.3.6

ZooKeeper: zookeeper-3.4.5-cdh5.3.6

Kafka: 2.9.2-0.8.1

其他工具:flume-ng-1.5.0-cdh5.3.6、SecureCRT、WinSCP、VirtualBox等

2.内容简介

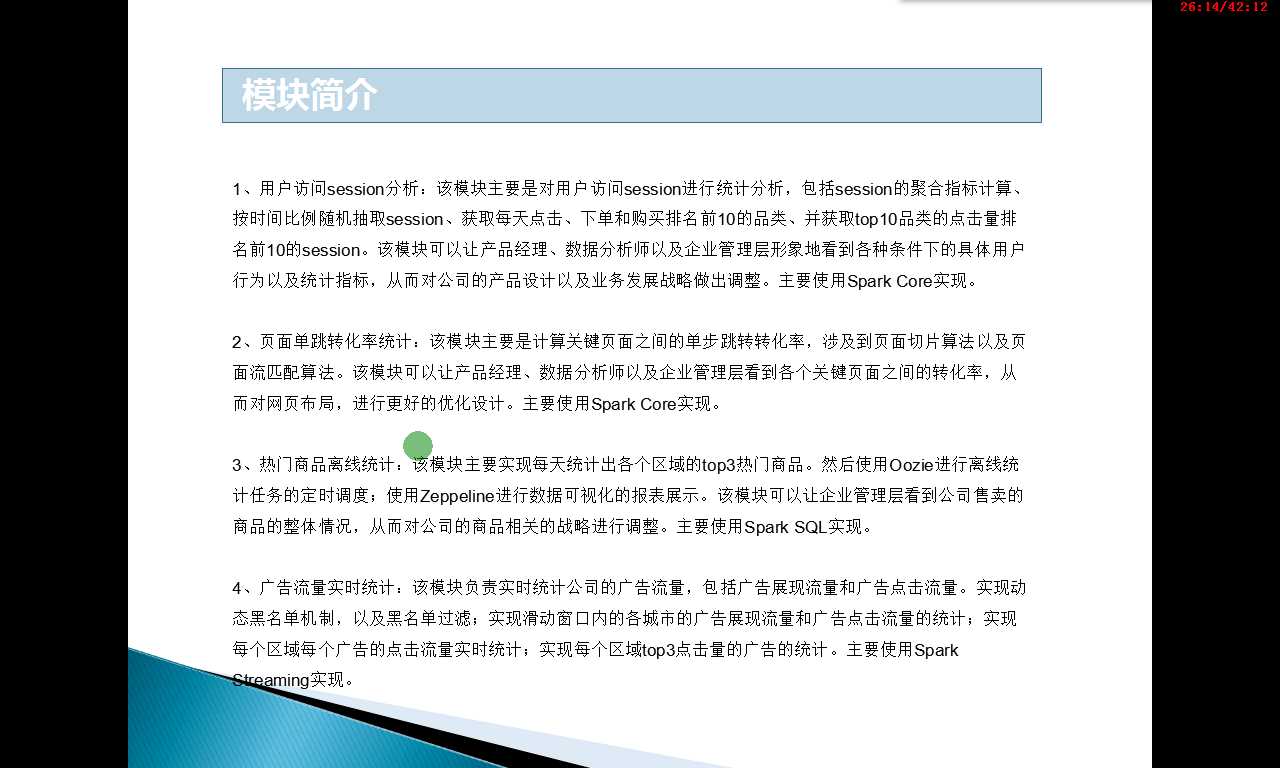

项目主要采用目前大数据领域最流行、最热门的技术——Spark,具有普通项目无法比拟的技术前瞻性与尖端性。本项目使用了Spark技术生态栈中最常用的三个技术框架,Spark Core、Spark SQL和Spark Streaming,进行离线计算和实时计算业务模块的开发。实现了包括用户访问session分析、页面单跳转化率统计、热门商品离线统计、广告点击流量实时统计4个业务模块。

项目中所有的业务功能模块都是直接从实际企业项目中抽取出来的,业务复杂度绝对没有任何缩水,只是为了更好的贴近大数据实战课程的需要,进行了一定程度上的技术整合和业务整合。该项目的真实性、业务复杂性以及实战型,绝对不是市面上现有的仅几个课时的Demo级的大数据项目可以比拟的。

通过合理的将实际业务模块进行技术整合与改造,该项目完全涵盖了Spark Core、Spark SQL和Spark Streaming这三个技术框架中几乎所有的功能点、知识点以及性能优化点。仅一个项目,即可全面掌握Spark技术在实际项目中如何实现各种类型的业务需求!在项目中,重点讲解了实际企业项目中积累下来的宝贵的性能调优、troubleshooting以及数据倾斜解决方案等知识和技术,几乎所有知识和技术都是全网唯一,是任何其他视频课程以及书本中都没有包含的珍贵经验积累!同时以企业级大数据项目开发流程贯穿每个业务模块的讲解,涵盖了项目开发全流程,包括需求分析、方案设计、数据设计、编码实现、测试以及性能调优等环节,全面还原真实大数据项目的开发流程。该项目的整体商业价值绝对在百万元以上!

学习完本课程之后,可以大幅度提升学员的Spark技术能力、实战开发能力、项目经验、性能调优和troubleshooting经验。如果学员已经学习过《Spark从入门到精通(Scala编程、案例实战、高级特性、Spark内核源码剖析、Hadoop高端)》课程,再学习完本课程,则完全可以达到2~3年左右Spark大数据开发经验的水平,正式迈入Spark高级开发工程师的行列!在跳槽或者面试的时候,精湛的Spark技术以及复杂的Spark大数据项目的经验,足以让你应付国内任何公司的面试(包括BAT等顶级互联网公司的面试难度),从而让学员通过学习掌握自己的人生!

在此特别强调,本课程的学习要求有Java基础、Hadoop基础,如果学员没有相关基础,请先自学相关知识。本课程要求学员有扎实的Spark技术基础,如果没有,则推荐学习北风网的《Spark从入门到精通(Scala编程、案例实战、高级特性、Spark内核源码剖析、Hadoop高端)》课程(http://www。ibeifeng。com/goods-560.html)。

备注一:关于《Spark从入门到精通(Scala编程、案例实战、高级特性、Spark内核源码剖析、Hadoop高端)》与本套课程的关系,如果学习了第一套Spark技术课程,那么在融会贯通的情况下,可以达到1~2年Spark开发经验的水平;如果在学习完第一套Spark课程,同时学习完第二套Spark项目课程,并且融会贯通的情况下,那么可以达到2~3年的Spark开发经验的水平,成为Spark高级/资深开发工程师。

备注二:考虑到学员不统一的技术基础,因此本项目仅仅要求J2SE基础,也就是Java基础编程即可,不要求J2EE,而且也不使用任何Java框架,不涉及与第三方技术整合。主要就是为了降低课程的学习门槛。本课程不会讲解J2EE层的开发,只是讲解Spark如何与J2EE结合使用,组成交互式大数据平台的架构。因此唯一的要求仅仅是Java编程基础以及Spark扎实的技术即可学习课程。

备注三:关于课程开发语言的选择,本套课程选择使用Java,而不是Scala,作为编程语言;原因主要是因为在开发大型、复杂的大数据业务系统或平台时,Java的优势是Scala所不可比拟的;在真正大型复杂的项目中,可能Spark需要管理大量的组件,此时可能需要用Spring框架;可能需要执行复杂的数据库操作,此时需要ORM类框架,比如MyBatis;可能需要与Redis、Kafka、ZooKeeper整合使用,此时需要使用Java Client API;以上需求都是Scala满足不了的。使用Scala很可能会导致项目的多语言混编,造成可维护性和可扩展性大幅度降低。(注意,本套项目课程为了降低学习难度,并且聚焦在Spark上,没有使用以上任何技术,只是用纯粹的Java基础编程与Spark技术;但是这并不意味着你在真正的工作中不会碰到上述的情况)

本课程的最大特色包括:

1、全网唯一的高端大数据项目:市面上目前完全没有任何高端的大数据项目实战类课程,更没有Spark大数据项目实战类课程,本课程是全网唯一的企业级大型Spark大数据实战项目课程!

2、企业级大数据项目的架构搭建:配置管理组件、JDBC辅助组件(内置数据库连接池)、Domain与DAO模型等等,完全正规的大型大数据项目架构!

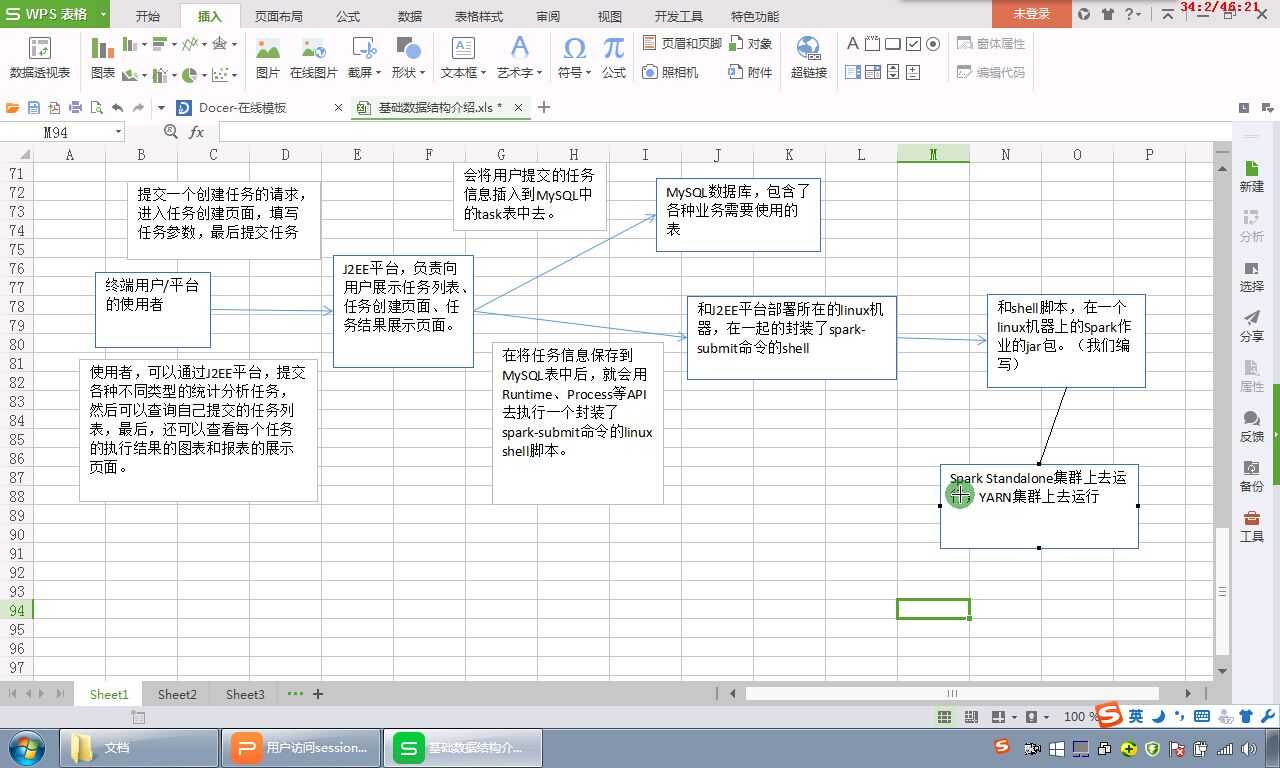

3、交互式大数据分析平台架构:本项目的原型不是普通的定时调度离线统计任务的大数据项目;而是Spark与J2EE系统结合构成的交互式大数据分析平台,项目中的Spark开发都是按该架构来讲解的!

4、真实还原完整的企业级大数据项目开发流程:项目中采用完全还原企业大数据项目开发场景的方式来讲解,每一个业务模块的讲解都包括了数据分析、需求分析、方案设计、数据库设计、编码实现、功能测试、性能调优、troubleshooting与解决数据倾斜(后期运维)等环节,真实还原企业级大数据项目开发场景。让学员掌握真实大数据项目的开发流程和经验!

5、技术点覆盖广:一套项目课程,全面涵盖了至少90%以上的Spark Core、Spark SQL和Spark Streaming的几乎所有的初、中、高级技术点;通过本项目课程的学习,可以全面锻炼了学员的Spark大数据项目实战能力,将技术与项目融会贯通,彻底精通Spark实战开发!

6、真实的性能调优方案与troubleshooting经验:项目中通过实际的功能模块和业务场景,以及讲师曾经开发过的处理十亿、甚至百亿以上数据级别的Spark作业的经验积累,贯穿讲解了大量的高级复杂的性能调优技术和知识、troubleshooting解决线上报错和故障的经验。真正帮助学员掌握企业实际项目中使用的高精尖Spark技术!

7、高端的数据倾斜解决方案:本课程讲解了高端而且宝贵的,大量实际项目中积累的——数据倾斜全套解决方案!包括数据倾斜问题的判断、诊断与定位,以及一整套7种针对各种不同类型数据倾斜的解决方案,彻底帮助学员解决企业项目中最棘手的数据倾斜问题,称为企业中最核心的技术人才!全网唯一的珍贵技术!

8、业务功能极其复杂:项目中的四个功能模块,全部是实际企业项目中提取出来的,并进行技术整合和改良过的功能模块,包含了比实际项目中更多、更全面的技术点。所有模块的需求,全部是企业级的复杂和真实的需求,业务模块非常之复杂,绝对不是市面上的Demo级别的大数据项目能够想比拟的。学习过后,真正帮助学员增加实际企业级项目的实战经验!

9、大量的全网唯一的高端技术:自定义Accumulator、按时间比例随机抽取算法、二次排序、分组取topN、页面切片生成以及页面流匹配算法、Hive与MySQL异构数据源、RDD转换为DataFrame、注册和使用临时表、自定义UDAF聚合函数(group_concat_distinct)、自定义get_json_object等普通函数、Spark SQL的高级内置函数(if与case when等)、开窗函数(ROW_NUMBER)、动态黑名单机制、transform、updateStateByKey、transform与Spark SQL整合、window滑动窗口、高性能写数据库,等等。

10、行业经验穿插介绍:贯穿了大量讲师在大数据行业内的从业经验以及所见所闻,帮助学员丰富行业阅历。

11、高端源代码:赠送完整spark大型大数据项目的商业级别的源代码,价值上百万;稍加改造,二次开发,甚至可以直接用于你的企业的大数据行为分析。

12、现场Excel手工画图与写笔记:所有复杂业务流程、架构原理、Spark技术原理、业务需求分析、技术实现方案等知识的讲解,采用Excel画图或者写详细比较的方式进行讲解与分析,细致入微、形象地透彻剖析理论知识,帮助学员更好的理解、记忆与复习巩固。

一、大数据集群搭建

第1讲-课程介绍

第2讲-课程环境搭建:CentOS 6.4集群搭建

第3讲-课程环境搭建:hadoop-2.5.0-cdh5.3.6集群搭建

第4讲-课程环境搭建:hive-0.13.1-cdh5.3.6安装

第5讲-课程环境搭建:zookeeper-3.4.5-cdh5.3.6集群搭建

第6讲-课程环境搭建:kafka_2.9.2-0.8.1集群搭建

第7讲-课程环境搭建:flume-ng-1.5.0-cdh5.3.6安装

第8讲-课程环境搭建:离线日志采集流程介绍

第9讲-课程环境搭建:实时数据采集流程介绍

第10讲-课程环境搭建:Spark 1.5.1客户端安装以及基于YARN的提交模式

二、用户访问session分析:

第11讲-用户访问session分析:模块介绍

第12讲-用户访问session分析:基础数据结构以及大数据平台架构介绍

第13讲-用户访问session分析:需求分析

第14讲-用户访问session分析:技术方案设计

第15讲-用户访问session分析:数据表设计

第16讲-用户访问session分析:Eclipse工程搭建以及工具类说明

第17讲-用户访问session分析:开发配置管理组件

第18讲-用户访问session分析:JDBC原理介绍以及增删改查示范

第19讲-用户访问session分析:数据库连接池原理

第20讲-用户访问session分析:单例设计模式

第21讲-用户访问session分析:内部类以及匿名内部类

第22讲-用户访问session分析:开发JDBC辅助组件(上)

第23讲-用户访问session分析:开发JDBC辅助组件(下)

第24讲-用户访问session分析:JavaBean概念讲解

第25讲-用户访问session分析:DAO模式讲解以及TaskDAO开发

第26讲-用户访问session分析:工厂模式讲解以及DAOFactory开发

第27讲-用户访问session分析:JSON数据格式讲解以及fastjson介绍

第28讲-用户访问session分析:Spark上下文构建以及模拟数据生成

第29讲-用户访问session分析:按session粒度进行数据聚合

第30讲-用户访问session分析:按筛选参数对session粒度聚合数据进行过滤

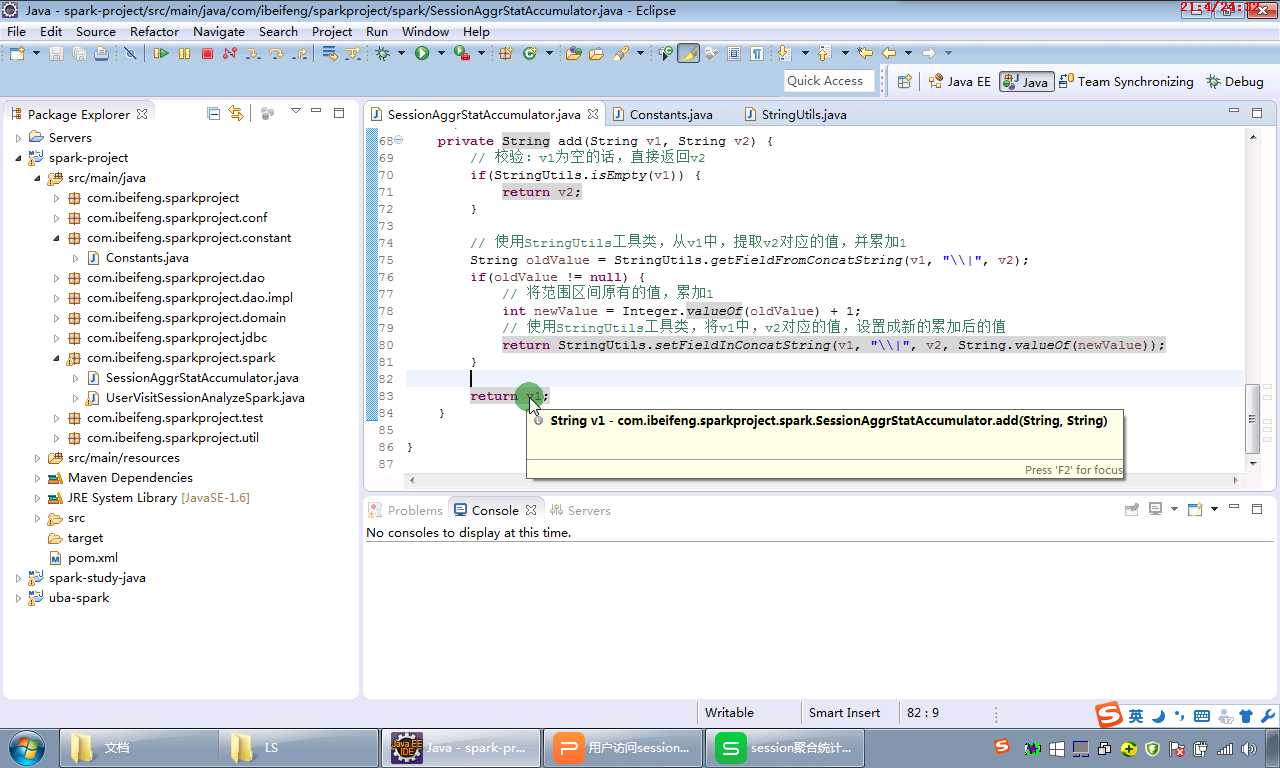

第31讲-用户访问session分析:session聚合统计之自定义Accumulator

第32讲-用户访问session分析:session聚合统计之重构实现思路与重构session聚合

第33讲-用户访问session分析:session聚合统计之重构过滤进行统计

第34讲-用户访问session分析:session聚合统计之计算统计结果并写入MySQL

第35讲-用户访问session分析:session聚合统计之本地测试

第36讲-用户访问session分析:session聚合统计之使用Scala实现自定义Accumulator

第37讲-用户访问session分析:session随机抽取之实现思路分析

第38讲-用户访问session分析:session随机抽取之计算每天每小时session数量

第39讲-用户访问session分析:session随机抽取之按时间比例随机抽取算法实现

第40讲-用户访问session分析:session随机抽取之根据随机索引进行抽取

第41讲-用户访问session分析:session随机抽取之获取抽取session的明细数据

第42讲-用户访问session分析:session随机抽取之本地测试

第43讲-用户访问session分析:top10热门品类之需求回顾以及实现思路分析

第44讲-用户访问session分析:top10热门品类之获取session访问过的所有品类

第45讲-用户访问session分析:top10热门品类之计算各品类点击、下单和支付的次数

第46讲-用户访问session分析:top10热门品类之join品类与点击下单支付次数

第47讲-用户访问session分析:top10热门品类之自定义二次排序key

第48讲-用户访问session分析:top10热门品类之进行二次排序

第49讲-用户访问session分析:top10热门品类之获取top10品类并写入MySQL

第50讲-用户访问session分析:top10热门品类之本地测试

第51讲-用户访问session分析:top10热门品类之使用Scala实现二次排序

第52讲-用户访问session分析:top10活跃session之开发准备以及top10品类RDD生成

第53讲-用户访问session分析:top10活跃session之计算top10品类被各sessoin点击的次数

第54讲-用户访问session分析:top10活跃session之分组取TopN算法获取top10活跃session

第55讲-用户访问session分析:top10活跃session之本地测试以及阶段总结

三、企业级性能调优、troubleshooting经验与数据倾斜解决方案:

第56讲-用户访问session分析:性能调优之在实际项目中分配更多资源

第57讲-用户访问session分析:性能调优之在实际项目中调节并行度

第58讲-用户访问session分析:性能调优之在实际项目中重构RDD架构以及RDD持久化

第59讲-用户访问session分析:性能调优之在实际项目中广播大变量

第60讲-用户访问session分析:性能调优之在实际项目中使用Kryo序列化

第61讲-用户访问session分析:性能调优之在实际项目中使用fastutil优化数据格式

第62讲-用户访问session分析:性能调优之在实际项目中调节数据本地化等待时长

第63讲-用户访问session分析:JVM调优之原理概述以及降低cache操作的内存占比

第64讲-用户访问session分析:JVM调优之调节executor堆外内存与连接等待时长

第65讲-用户访问session分析:Shuffle调优之原理概述

第66讲-用户访问session分析:Shuffle调优之合并map端输出文件

第67讲-用户访问session分析:Shuffle调优之调节map端内存缓冲与reduce端内存占比

第68讲-用户访问session分析:Shuffle调优之HashShuffleManager与SortShuffleManager

第69讲-用户访问session分析:算子调优之MapPartitions提升Map类操作性能

第70讲-用户访问session分析:算子调优之filter过后使用coalesce减少分区数量

第71讲-用户访问session分析:算子调优之使用foreachPartition优化写数据库性能

第72讲-用户访问session分析:算子调优之使用repartition解决Spark SQL低并行度的性能问题

第73讲-用户访问session分析:算子调优之reduceByKey本地聚合介绍

第74讲-用户访问session分析:troubleshooting之控制shuffle reduce端缓冲大小以避免OOM

第75讲-用户访问session分析:troubleshooting之解决JVM GC导致的shuffle文件拉取失败

第76讲-用户访问session分析:troubleshooting之解决YARN队列资源不足导致的application直接失败

第77讲-用户访问session分析:troubleshooting之解决各种序列化导致的报错

第78讲-用户访问session分析:troubleshooting之解决算子函数返回NULL导致的问题

第79讲-用户访问session分析:troubleshooting之解决yarn-client模式导致的网卡流量激增问题

第80讲-用户访问session分析:troubleshooting之解决yarn-cluster模式的JVM栈内存溢出问题

第81讲-用户访问session分析:troubleshooting之错误的持久化方式以及checkpoint的使用

第82讲-用户访问session分析:数据倾斜解决方案之原理以及现象分析

第83讲-用户访问session分析:数据倾斜解决方案之聚合源数据以及过滤导致倾斜的key

第84讲-用户访问session分析:数据倾斜解决方案之提高shuffle操作reduce并行度

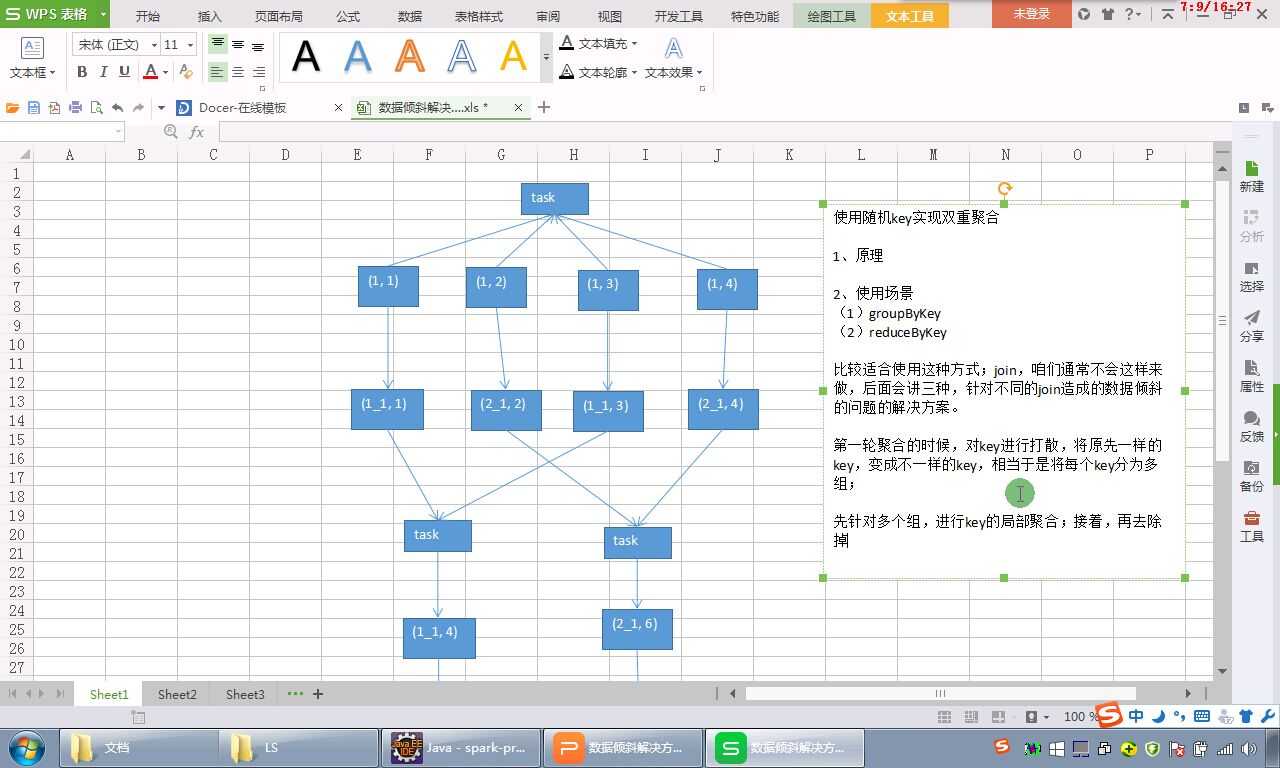

第85讲-用户访问session分析:数据倾斜解决方案之使用随机key实现双重聚合

第86讲-用户访问session分析:数据倾斜解决方案之将reduce join转换为map join

第87讲-用户访问session分析:数据倾斜解决方案之sample采样倾斜key单独进行join

第88讲-用户访问session分析:数据倾斜解决方案之使用随机数以及扩容表进行join

四、页面单跳转化率统计:

第89讲-页面单跳转化率:模块介绍

第90讲-页面单跳转化率:需求分析、技术方案设计、数据表设计

第91讲-页面单跳转化率:编写基础代码

第92讲-页面单跳转化率:页面切片生成以及页面流匹配算法实现

第93讲-页面单跳转化率:计算页面流起始页面的pv

第94讲-页面单跳转化率:计算页面切片的转化率

第95讲-页面单跳转化率:将页面切片转化率写入MySQL

第96讲-页面单跳转化率:本地测试

第97讲-页面单跳转化率:生产环境测试

第98讲-用户访问session分析:生产环境测试

五、各区域热门商品统计:

第99讲-各区域热门商品统计:模块介绍

第100讲-各区域热门商品统计:需求分析、技术方案设计以及数据设计

第101讲-各区域热门商品统计:查询用户指定日期范围内的点击行为数据

第102讲-各区域热门商品统计:异构数据源之从MySQL中查询城市数据

第103讲-各区域热门商品统计:关联城市信息以及RDD转换为DataFrame后注册临时表

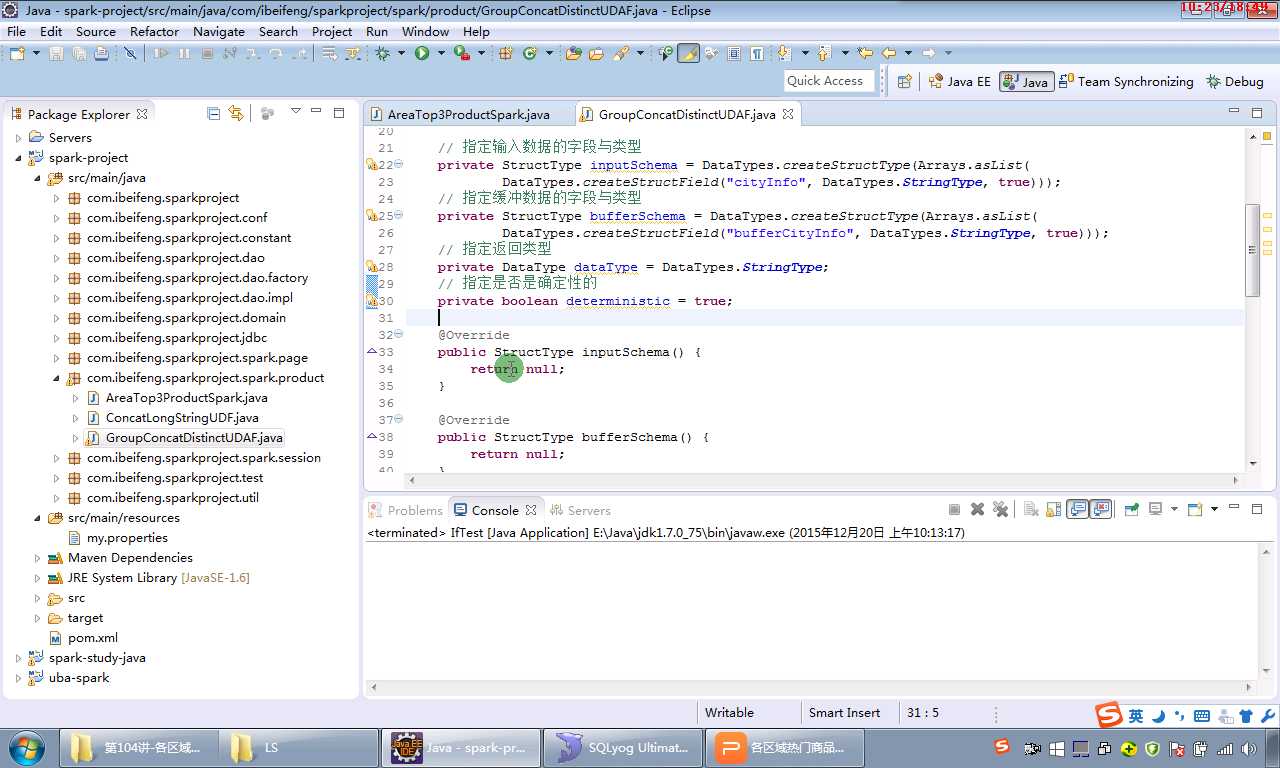

第104讲-各区域热门商品统计:开发自定义UDAF聚合函数之group_concat_distinct()

第105讲-各区域热门商品统计:查询各区域各商品的点击次数并拼接城市列表

第106讲-各区域热门商品统计:关联商品信息并使用自定义get_json_object函数和内置if函数标记经营类型

第106讲-各区域热门商品统计:使用开窗函数统计各区域的top3热门商品

第107讲-各区域热门商品统计:使用内置case when函数给各个区域打上级别标记

第108讲-各区域热门商品统计:将结果数据写入MySQL中

第109讲-各区域热门商品统计:Spark SQL数据倾斜解决方案

第110讲-各区域热门商品统计:生产环境测试

六、广告点击流量实时统计:

第111讲-广告点击流量实时统计:需求分析、技术方案设计以及数据设计

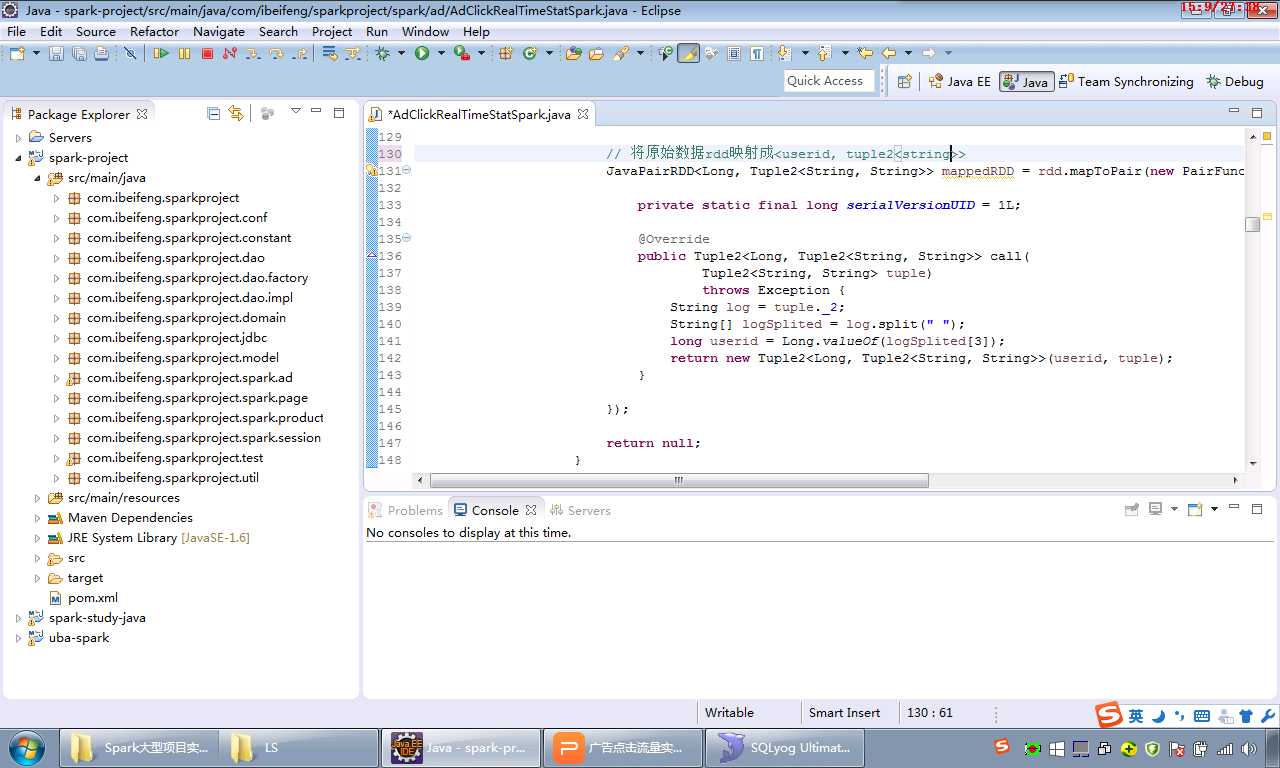

第112讲-广告点击流量实时统计:为动态黑名单实时计算每天各用户对各广告的点击次数

第113讲-广告点击流量实时统计:使用高性能方式将实时计算结果写入MySQL中

第114讲-广告点击流量实时统计:过滤出每个batch中的黑名单用户以生成动态黑名单

第115讲-广告点击流量实时统计:基于动态黑名单进行点击行为过滤

第116讲-广告点击流量实时统计:计算每天各省各城市各广告的点击量

第117讲-广告点击流量实时统计:计算每天各省的top3热门广告

第118讲-广告点击流量实时统计:计算每天各广告最近1小时滑动窗口内的点击趋势

第119讲-广告点击流量实时统计:实现实时计算程序的HA高可用性

第120讲-广告点击流量实时统计:对实时计算程序进行性能调优

第121讲-广告点击流量实时统计:生产环境测试

第122讲-课程总结:都学到了什么?

目标一. 掌握大数据集群环境的搭建

目标二. 掌握企业级大数据项目架构的搭建

目标三. 掌握J2EE+Spark的交互式大数据分 析系统架构

目标四. 掌握企业级大数据项目的开发流程

目标五. 将Spark Core、Spark SQL、Spark Streaming的90%以上的技术点和知 识点应用在项目中,技术与项目融 会贯通

目标六. 使用高级的Spark技术开发各种复 杂的大数据统计与分析类的业务需 求和功能

目标七. 掌握企业级的高端性能调优方案、 troubleshooting解决线上故障能 力以及数据倾斜解决方案

亮点一、全网唯一的高端Spark大数据项目。

亮点二、按照企业级的标准搭建大数据项目的架构。

亮点三、按照高端的J2EE与Spark结合的交互式分析大数据平台的架构,讲解Spark开发。

亮点四、采用真实的企业级大数据项目开发流程,包括近10个步骤。

亮点五、技术点覆盖广泛,一套课程覆盖Spark Core、Spark SQL与Spark Streaming高达90%以上的技术点。

亮点六、真实的企业级性能调优方案、troubleshooting解决线上故障经验、高端的数据倾斜解决方案。

亮点七、业务功能极其复杂,全部采用真实的企业级业务需求。

亮点八、包含大量全网唯一的Spark技术点。

亮点九、贯穿了大量讲师行业从业的经验与经历,以及感想。

亮点十、赠送全套完整商业级别的源代码,稍加改造即可应用,商业价值在百万以上。

1.课程针对人群

本课程针对有Java编程基础(不要求J2EE)、有扎实Spark技术基础的学员。

2.我该怎么学,如何才能学好这门课程,给些建议。

4.1、时间上的安排建议

本课程共120多讲,如果您时间上充分,建议以每天2-3讲的进度往前学习。如果时间特别充裕,建议将重点理论知识的相关视频看2~3遍。

4.2、学习要求

学习的时候, 可以要自己边看边做笔记,建议看视频的同时,电脑上打开一个记事本即可。所有理论知识的剖析和讲解一定要反复思考和理解,如果不理解,建议看2~3遍;所有代码,全部都要求跟着视频,手动敲一遍代码,脱开视频,自己再敲一遍,争取能够自己完全将项目敲出来。

4.3、讲师建议

1.最好看完视频之后,抛开视频,独立自己去把上课中的示例写一遍,看自己是否理解,如果不正确,可以回过头看再看下视频,如果反复,达到真正理解和熟练掌握的目的。

2.对于案例实战部分,一定要自己亲自动手做一遍,不要满足听完就OK了

3. 建议一般听视频,一般拿个纸和笔,做一些记录和笔记,这是一种非常好的学习习惯。

4. 一定不要过于依赖视频,要学会看API和使用百度,学会思考,学会举一反三

5. 最后祝您学有所成!

Spark大型项目实战:电商用户行为分析大数据平台

标签:

原文地址:http://www.cnblogs.com/destim/p/5380542.html