标签:

激活函数:

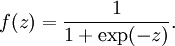

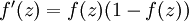

1)sigmoid函数 - 值域(0,1)

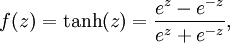

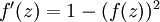

2)tanh函数 - 值域(-1,1)

两个函数都扩展至向量表示:

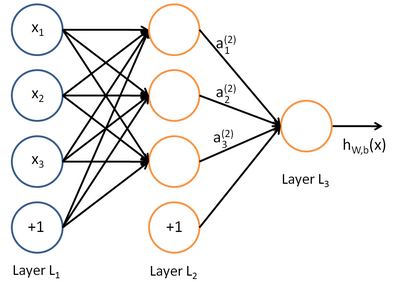

- 网络层数

- 网络层数

- 第l层的节点数(不包括偏置单元)

- 第l层的节点数(不包括偏置单元)

- 第l层第j单元 与 第l+1层第i单元之间的连接参数,大小为

- 第l层第j单元 与 第l+1层第i单元之间的连接参数,大小为

- 第l+1层第i单元的偏置项

- 第l+1层第i单元的偏置项

- 第l层的激活值

- 第l层的激活值

- 第l层第i单元输入加权和(包括偏置单元)

- 第l层第i单元输入加权和(包括偏置单元)

- 样本

- 样本

m - 样本数

α - 学习率

λ - 权重衰减参数,控制方差代价函数两项的相对重要性。

hw,b(x)=a

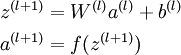

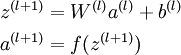

前向传播

初始化

(1)

(1)

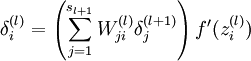

后向传播

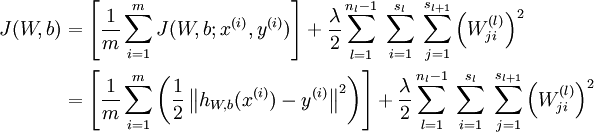

===> 目标:整体代价函数最小化

(2)

(2)

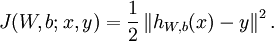

由单样本代价函数 , 加上规则化项减少权重幅度,防止过拟合。

, 加上规则化项减少权重幅度,防止过拟合。

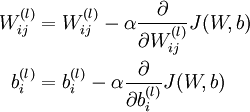

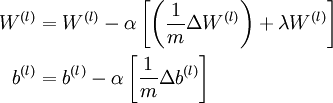

===> 梯度下降法

(3)

(3)

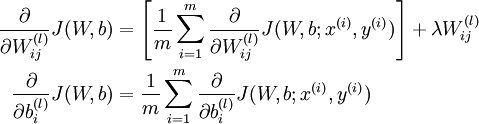

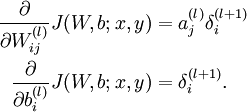

问题转化为求后面两个偏导数

===> 整体偏导数转化为单样本偏导数

(4)

(4)

===> 后向传播求单样本偏导

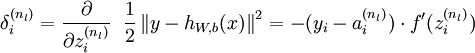

先求最后一层

(5)

(5)

神经网络伪代码

当不满足结束条件(迭代次数/结果误差率等):

对所有层,

0

0

对每个样本(x,y):

#前向传播

#后向传播

利用公式组(5)计算  和

和

更新权重参数

标签:

原文地址:http://www.cnblogs.com/IvanSSSS/p/5419283.html