标签:ann 适应 ram 定义 ati 映射 class 格式 min

1. 常用激活函数

激活函数的选择是构建神经网络过程中的重要环节,下面简要介绍常用的激活函数。

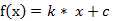

(1) 线性函数 ( Liner Function )

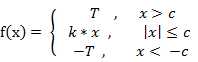

(2) 斜面函数 ( Ramp Function )

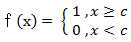

(3) 阈值函数 ( Threshold Function )

以上3个激活函数都属于线性函数,下面介绍两个常用的非线性激活函数。

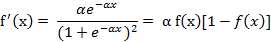

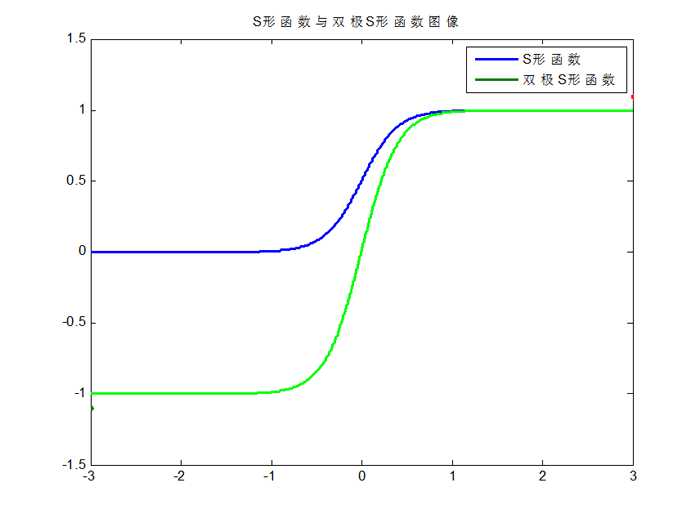

(4) S形函数 ( Sigmoid Function )

该函数的导函数:

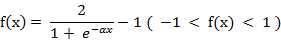

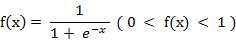

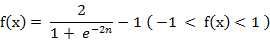

(5) 双极S形函数

该函数的导函数:

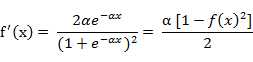

S形函数与双极S形函数的图像如下:

图3. S形函数与双极S形函数图像

双极S形函数与S形函数主要区别在于函数的值域,双极S形函数值域是(-1,1),而S形函数值域是(0,1)。

由于S形函数与双极S形函数都是可导的(导函数是连续函数),因此适合用在BP神经网络中。(BP算法要求激活函数可导)

2.数据预处理

在训练神经网络前一般需要对数据进行预处理,一种重要的预处理手段是归一化处理。下面简要介绍归一化处理的原理与方法。

(1) 什么是归一化?

数据归一化,就是将数据映射到[0,1]或[-1,1]区间或更小的区间,比如(0.1,0.9) 。

(2) 为什么要归一化处理?

<1>输入数据的单位不一样,有些数据的范围可能特别大,导致的结果是神经网络收敛慢、训练时间长。

<2>数据范围大的输入在模式分类中的作用可能会偏大,而数据范围小的输入作用就可能会偏小。

<3>由于神经网络输出层的激活函数的值域是有限制的,因此需要将网络训练的目标数据映射到激活函数的值域。例如神经网络的输出层若采用S形激活函数,由于S形函数的值域限制在(0,1),也就是说神经网络的输出只能限制在(0,1),所以训练数据的输出就要归一化到[0,1]区间。

<4>S形激活函数在(0,1)区间以外区域很平缓,区分度太小。例如S形函数f(X)在参数a=1时,f(100)与f(5)只相差0.0067。

(3) 归一化算法

一种简单而快速的归一化算法是线性转换算法。线性转换算法常见有两种形式:

<1>y = ( x - min )/( max - min )

其中min为x的最小值,max为x的最大值,输入向量为x,归一化后的输出向量为y 。上式将数据归一化到 [ 0 , 1 ]区间,当激活函数采用S形函数时(值域为(0,1))时这条式子适用。

<2>y = 2 * ( x - min ) / ( max - min ) - 1

这条公式将数据归一化到 [ -1 , 1 ] 区间。当激活函数采用双极S形函数(值域为(-1,1))时这条式子适用。

(4) Matlab数据归一化处理函数

Matlab中归一化处理数据可以采用premnmx , postmnmx , tramnmx 这3个函数。

<1> premnmx

语法:[pn,minp,maxp,tn,mint,maxt] = premnmx(p,t)

参数:

pn: p矩阵按行归一化后的矩阵

minp,maxp:p矩阵每一行的最小值,最大值

tn:t矩阵按行归一化后的矩阵

mint,maxt:t矩阵每一行的最小值,最大值

作用:将矩阵p,t归一化到[-1,1] ,主要用于归一化处理训练数据集。

<2> tramnmx

语法:[pn] = tramnmx(p,minp,maxp)

参数:

minp,maxp:premnmx函数计算的矩阵的最小,最大值

pn:归一化后的矩阵

作用:主要用于归一化处理待分类的输入数据。

<3> postmnmx

语法: [p,t] = postmnmx(pn,minp,maxp,tn,mint,maxt)

参数:

minp,maxp:premnmx函数计算的p矩阵每行的最小值,最大值

mint,maxt:premnmx函数计算的t矩阵每行的最小值,最大值

作用:将矩阵pn,tn映射回归一化处理前的范围。postmnmx函数主要用于将神经网络的输出结果映射回归一化前的数据范围。

3.使用Matlab实现神经网络

使用Matlab建立前馈神经网络主要会使用到下面3个函数:

newff :前馈网络创建函数

train:训练一个神经网络

sim :使用网络进行仿真

下面简要介绍这3个函数的用法。

(1) newff函数

<1>newff函数语法

newff函数参数列表有很多的可选参数,具体可以参考Matlab的帮助文档,这里介绍newff函数的一种简单的形式。

语法:net = newff ( A, B, {C} ,‘trainFun’)

参数:

A:一个n×2的矩阵,第i行元素为输入信号xi的最小值和最大值;

B:一个k维行向量,其元素为网络中各层节点数;

C:一个k维字符串行向量,每一分量为对应层神经元的激活函数;

trainFun :为学习规则采用的训练算法。

<2>常用的激活函数

常用的激活函数有:

a) 线性函数 (Linear transfer function)

f(x) = x

该函数的字符串为’purelin’。

b) 对数S形转移函数( Logarithmic sigmoid transfer function )

该函数的字符串为’logsig’。

c) 双曲正切S形函数 (Hyperbolic tangent sigmoid transfer function )

也就是上面所提到的双极S形函数。该函数的字符串为’ tansig’。

Matlab的安装目录下的toolbox\nnet\nnet\nntransfer子目录中有所有激活函数的定义说明。

<3>常见的训练函数

常见的训练函数有:

traingd :梯度下降BP训练函数(Gradient descent backpropagation)

traingdx :梯度下降自适应学习率训练函数

<4>网络配置参数

一些重要的网络配置参数如下:

net.trainparam.goal :神经网络训练的目标误差

net.trainparam.show : 显示中间结果的周期

net.trainparam.epochs :最大迭代次数

net.trainParam.lr : 学习率

(2) train函数

网络训练学习函数。

语法:[ net, tr, Y1, E ] = train( net, X, Y )

参数:

X:网络实际输入

Y:网络应有输出

tr:训练跟踪信息

Y1:网络实际输出

E:误差矩阵

(3) sim函数

语法:Y=sim(net,X)

参数:

net:网络

X:输入给网络的K×N矩阵,其中K为网络输入个数,N为数据样本数

Y:输出矩阵Q×N,其中Q为网络输出个数

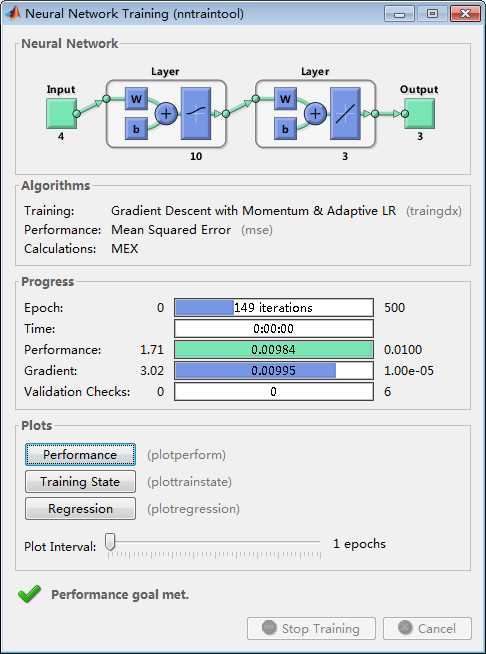

(4) Matlab BP网络实例

我将Iris数据集分为2组,每组各75个样本,每组中每种花各有25个样本。其中一组作为以上程序的训练样本,另外一组作为检验样本。为了方便训练,将3类花分别编号为1,2,3 。

使用这些数据训练一个4输入(分别对应4个特征),3输出(分别对应该样本属于某一品种的可能性大小)的前向网络。

Matlab程序如下:

%读取训练数据 [f1,f2,f3,f4,class] = textread(‘trainData.txt‘ , ‘%f%f%f%f%f‘,150); %注意数据格式,数据之间有逗号和空格之分;然后类别为1,2,3 %特征值归一化 [input,minI,maxI] = premnmx( [f1 , f2 , f3 , f4 ]‘) ; %构造输出矩阵 s = length( class) ; output = zeros( s , 3 ) ; for i = 1 : s output( i , class( i ) ) = 1 ; end %创建神经网络 net = newff( minmax(input) , [10 3] , { ‘logsig‘ ‘purelin‘ } , ‘traingdx‘ ) ; %设置训练参数 net.trainparam.show = 50 ; net.trainparam.epochs = 500 ; net.trainparam.goal = 0.01 ; net.trainParam.lr = 0.01 ; %开始训练 net = train( net, input , output‘ ) ; %读取测试数据 [t1 t2 t3 t4 c] = textread(‘testData.txt‘ , ‘%f%f%f%f%f‘,150); %测试数据归一化 testInput = tramnmx ( [t1,t2,t3,t4]‘ , minI, maxI ) ; %仿真 Y = sim( net , testInput ) %统计识别正确率 [s1 , s2] = size( Y ) ; hitNum = 0 ; for i = 1 : s2 [m , Index] = max( Y( : , i ) ) ; if( Index == c(i) ) hitNum = hitNum + 1 ; end end sprintf(‘识别率是 %3.3f%%‘,100 * hitNum / s2 )

实验结果:

其他的神经网络:

%产生指定类别的样本点,并在图中绘出 X = [0 1; 0 1]; % 限制类中心的范围 clusters = 5; % 指定类别数目 points = 10; % 指定每一类的点的数目 std_dev = 0.05; % 每一类的标准差 P = nngenc(X,clusters,points,std_dev); plot(P(1,:),P(2,:),‘+r‘); title(‘输入样本向量‘); xlabel(‘p(1)‘); ylabel(‘p(2)‘); %建立网络 net=newc([0 1;0 1],5,0.1); %设置神经元数目为5 %得到网络权值,并在图上绘出 figure; plot(P(1,:),P(2,:),‘+r‘); w=net.iw{1} hold on; plot(w(:,1),w(:,2),‘ob‘); hold off; title(‘输入样本向量及初始权值‘); xlabel(‘p(1)‘); ylabel(‘p(2)‘); figure; plot(P(1,:),P(2,:),‘+r‘); hold on; %训练网络 net.trainParam.epochs=7; net=init(net); net=train(net,P); %得到训练后的网络权值,并在图上绘出 w=net.iw{1} plot(w(:,1),w(:,2),‘ob‘); hold off; title(‘输入样本向量及更新后的权值‘); xlabel(‘p(1)‘); ylabel(‘p(2)‘); a=0; p = [0.6 ;0.8]; a=sim(net,p) %**************指定输入二维向量及其类别******************* P = [-3 -2 -2 0 0 0 0 +2 +2 +3; 0 +1 -1 +2 +1 -1 -2 +1 -1 0]; C = [1 1 1 2 2 2 2 1 1 1]; %将这些类别转换成学习向量量化网络使用的目标向量 T = ind2vec(C) %用不同的颜色,绘出这些输入向量 plotvec(P,C), title(‘输入二维向量‘); xlabel(‘P(1)‘); ylabel(‘P(2)‘); %建立网络 net = newlvq(minmax(P),4,[.6 .4],0.1); %在同一幅图上绘出输入向量及初始权重向量 figure; plotvec(P,C) hold on W1=net.iw{1}; plot(W1(1,1),W1(1,2),‘ow‘) title(‘输入以及权重向量‘); xlabel(‘P(1), W(1)‘); ylabel(‘P(2), W(2)‘); hold off; %训练网络,并再次绘出权重向量 figure; plotvec(P,C); hold on; net.trainParam.epochs=150; net.trainParam.show=Inf; net=train(net,P,T); plotvec(net.iw{1}‘,vec2ind(net.lw{2}),‘o‘); %对于一个特定的点,得到网络的输出 p = [0.8; 0.3]; a = vec2ind(sim(net,p)) %%%%%%%%%**********随机生成1000个二维向量,作为样本,并绘出其分布************* P = rands(2,1000); plot(P(1,:),P(2,:),‘+r‘) title(‘初始随机样本点分布‘); xlabel(‘P(1)‘); ylabel(‘P(2)‘); %建立网络,得到初始权值 net=newsom([0 1; 0 1],[5 6]); w1_init=net.iw{1,1} %绘出初始权值分布图 figure; plotsom(w1_init,net.layers{1}.distances) %分别对不同的步长,训练网络,绘出相应的权值分布图 for i=10:30:100 net.trainParam.epochs=i; net=train(net,P); figure; plotsom(net.iw{1,1},net.layers{1}.distances) end %对于训练好的网络,选择特定的输入向量,得到网络的输出结果 p=[0.5;0.3]; a=0; a = sim(net,p)

标签:ann 适应 ram 定义 ati 映射 class 格式 min

原文地址:http://www.cnblogs.com/ranjiewen/p/6208869.html