标签:功能 存在 com oop 技术 art logs http 聚合

1.介绍

Spark的日志聚合功能不是standalone模式独享的,是所有运行模式下都会存在的情况

默认情况下历史日志是保存到tmp文件夹中的

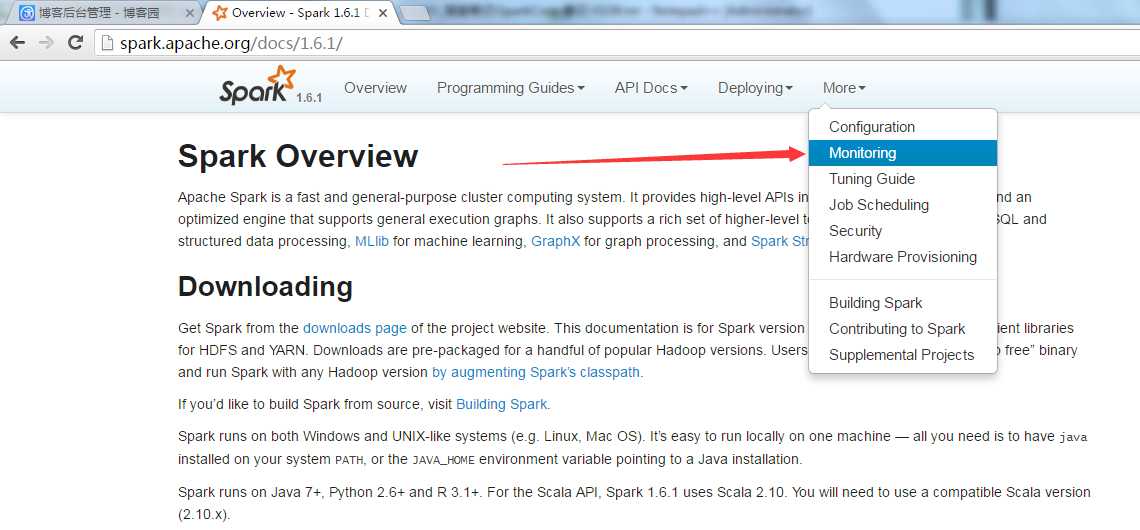

2.参考官网的知识点位置

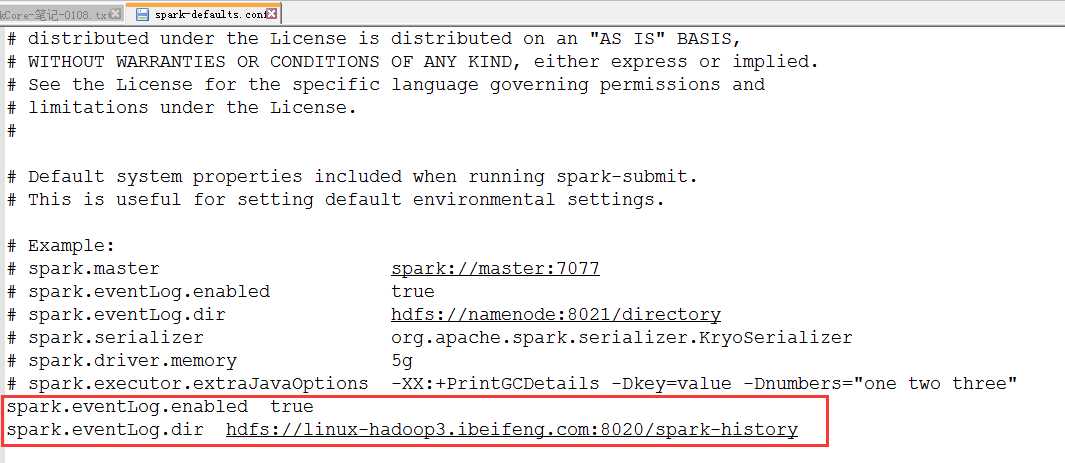

3.修改spark-defaults.conf

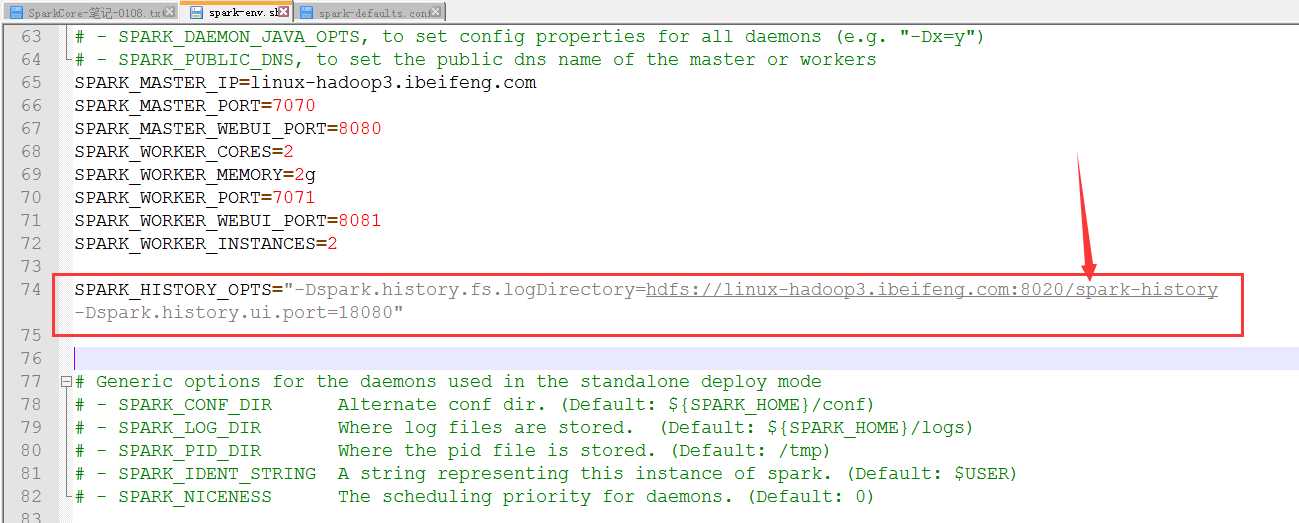

4.修改env.sh

5.在HDFS上新建/spark-history

bin/hdfs dfs -mkdir /spark-history

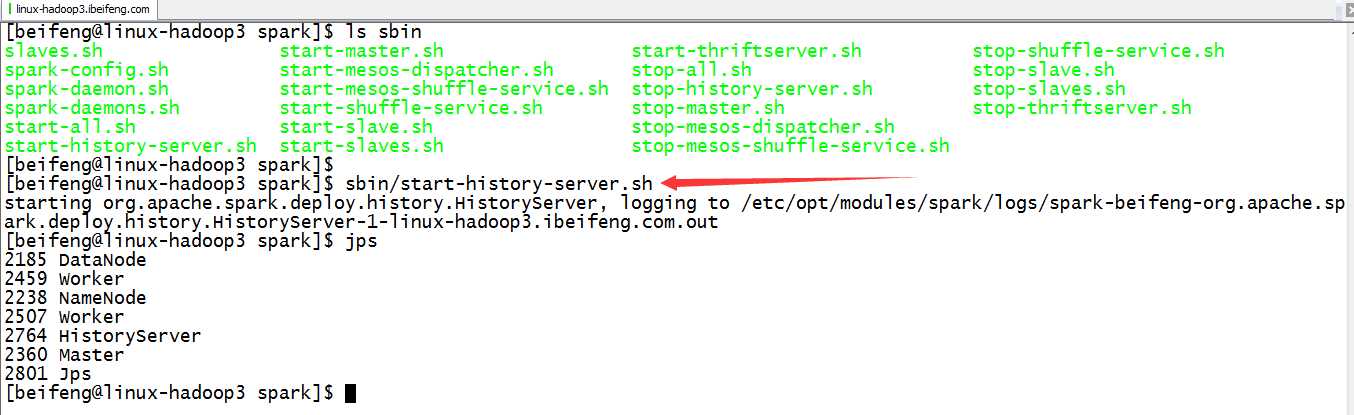

6.启动历史服务

sbin/start-history-server.sh

7.测试

webUI: http://192.168.187.146:18080/

local模式:bin/spark-shell

standalone模式:bin/spark-shell --master spark://linux-hadoop3.ibeifeng.com:7070

8.local模式的测试

标签:功能 存在 com oop 技术 art logs http 聚合

原文地址:http://www.cnblogs.com/juncaoit/p/6379006.html