标签:集合 问答 原则 思考 question img softmax 不能 val

0: 原则上,loss函数都应该选convex函数,convex函数的定义就是函数上方得点是一个convex集合

1: 之前使用的0-1的数据预测正负样本,loss函数选用的是cross entropy loss,

实际上这里的0-1 cross entropy和seq2seq的softmax cross entropy都是使用的log函数算的loss,

但是最近看到有人说,在seq2seq里面使用MSE, mean square error比softmax cross entropy要好很多,

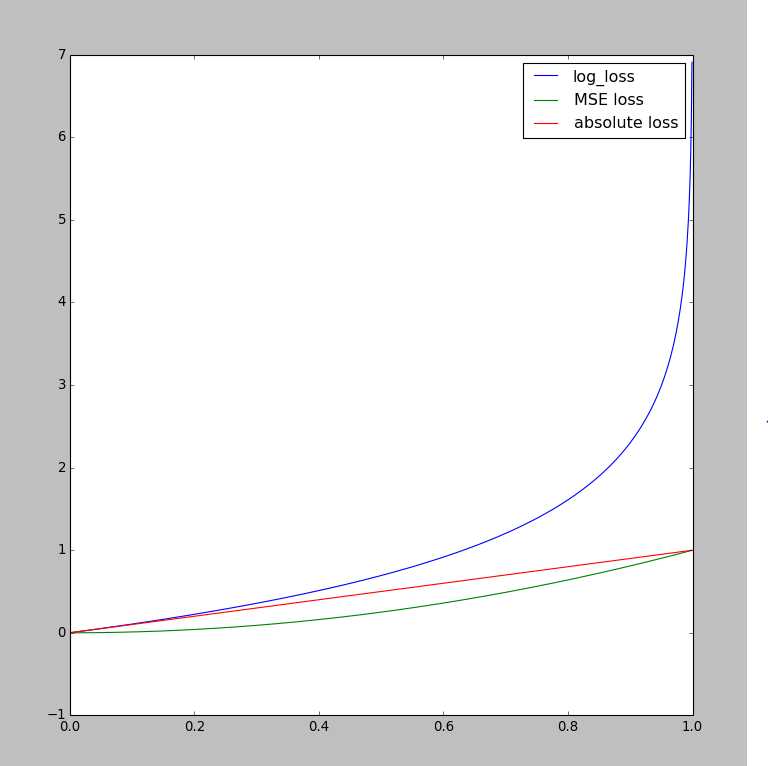

遂作下图,可以观察比较一下各个不同的loss函数,注意到tf官方给的seq2seq模型里面用的就是MSE;

下面是对于分类里面的三种常见的loss的比较,函数形式是

x: predicted - true value的绝对值

log_loss = -np.log(1- x + 1e-12)

mse = x*x

abs_loss = x

我的感觉是,类别非常多,或者越不能准确预测某一类的值的时候,不要用log loss

2: 对于刚刚做的问答匹配采用正样本和负样本之间的cosine差值的loss;

loss = max(0, 0.2 - cosine(question, true answer) + cosine(question, negative answer))

之所以有效,可能是为了防止模型过多关注那些泾渭分明的case,而不去关注那些true answer 和 negative answer很模糊的case;

关于rnn神经网络的loss函数的一些思考

标签:集合 问答 原则 思考 question img softmax 不能 val

原文地址:http://www.cnblogs.com/LarryGates/p/6561493.html