标签:ucid imp data- 使用 记录 估算 res targe think

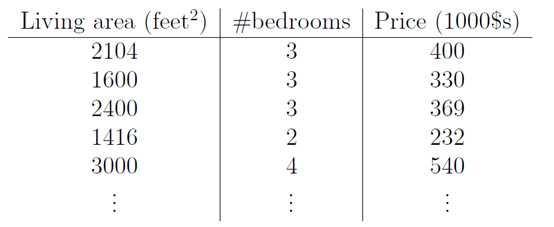

首先举个样例。如果我们有一个二手房交易记录的数据集。已知房屋面积、卧室数量和房屋的交易价格,例如以下表:

假如有一个房子要卖,我们希望通过上表中的数据估算这个房子的价格。

这个问题就是典型的回归问题,这边文章主要讲回归中的线性回归问题。

首先要明确什么是回归。

回归的目的是通过几个已知数据来预測还有一个数值型数据的目标值。

如果特征和结果满足线性关系,即满足一个计算公式h(x)。这个公式的自变量就是已知的数据x,函数值h(x)就是要预測的目标值。

这一计算公式称为回归方程,得到这个方程的过程就称为回归。

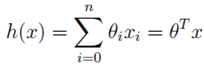

线性回归就是如果这个方式是一个线性方程。即如果这个方程是一个多元一次方程。以咱们上面提到的样例为例:如果房子的房屋面积和卧室数量为自变量x,用x1表示房屋面积。x2表示卧室数量。房屋的交易价格为因变量y,我们用h(x)来表示y。如果房屋面积、卧室数量与房屋的交易价格是线性关系。他们满足公式

上述公式中的θ为參数,也称为权重。能够理解为x1和x2对h(x)的影响度。对这个公式稍作变化就是

公式中θ和x是向量。n是样本数。

假如我们根据这个公式来预測h(x)。公式中的x是我们已知的,然而θ的取值却不知道,仅仅要我们把θ的取值求解出来,我们就能够根据这个公式来做预測了。

那么怎样根据训练数据求解θ的最优取值呢?这就牵扯到另外一个概念:损失函数(Loss Function)。

我们要做的是根据我们的训练集。选取最优的θ,在我们的训练集中让h(x)尽可能接近真实的值。

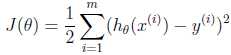

h(x)和真实的值之间的差距。我们定义了一个函数来描写叙述这个差距。这个函数称为损失函数,表达式例如以下:

这里的这个损失函数就是著名的最小二乘损失函数。这里还涉及一个概念叫最小二乘法。这里不再展开了。

我们要选择最优的θ,使得h(x)近期进真实值。这个问题就转化为求解最优的θ,使损失函数J(θ)取最小值。

那么怎样解决这个转化后的问题呢?这又牵扯到一个概念:梯度下降(Radient Descent)

(对的朋友,你没有看错,不是梯度下降,是LMS算法。

耐心点,梯度下降一会儿就出来了)

我们先来看当训练样本仅仅有一个的时候的情况,然后再将训练样本扩大到多个的情况。训练样本仅仅有一个的情况。我们借鉴LMS算法的思想。扩大到多个我们稍后说。

我们要求解使得J(θ)最小的θ值。LMS算法大概的思路是:我们首先随便给θ一个初始化的值。然后改变θ值让J(θ)的取值变小,不断反复改变θ使J(θ)变小的过程直至J(θ)约等于最小值。

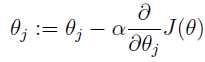

首先我们给θ一个初试值,然后向着让J(θ)变化最大的方向更新θ的取值。如此迭代。公式例如以下:

公式中α称为步长(learning rate)。它控制θ每次向J(θ)变小的方向迭代时的变化幅度。J(θ)对θ的偏导表示J(θ)变化最大的方向。

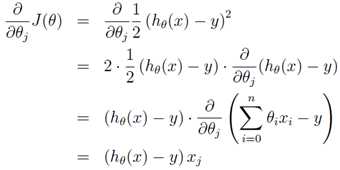

因为求的是极小值。因此梯度方向是偏导数的反方向。求解一下这个偏导,步骤例如以下:

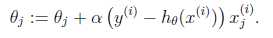

那么θ的迭代公式就变为:

这是当训练集仅仅有一个样本时的数学表达。我们又两种方式将仅仅有一个样本的数学表达转化为样本为多个的情况:梯度下降(gradient descent)和正则方程(The normal equations)。

这里我们重点讲梯度下降。

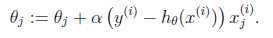

例如以下公式是处理一个样本的表达式:

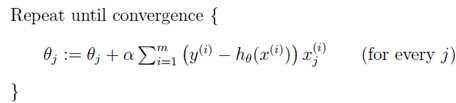

转化为处理多个样本就是例如以下表达:

这样的新的表达式每一步都是计算的所有训练集的数据。所以称之为批梯度下降(batch gradient descent)。

注意。梯度下降可能得到局部最优。但在优化问题里我们已经证明线性回归仅仅有一个最长处,由于损失函数J(θ)是一个二次的凸函数,不会产生局部最优的情况。(如果学习步长α不是特别大)

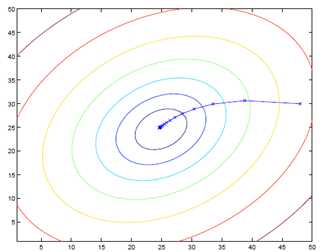

批梯度下降的算法运行步骤例如以下图:

大家细致看批梯度下降的数学表达式。每次迭代的时候都要对全部数据集样本计算求和,计算量就会非常大,尤其是训练数据集特别大的情况。那有没有计算量较小,并且效果也不错的方法呢?有!这就是:随机梯度下降(Stochastic Gradient Descent, SGD)

随机梯度下降在计算下降最快的方向时时随机选一个数据进行计算,而不是扫描所有训练数据集,这样就加快了迭代速度。随机梯度下降并非沿着J(θ)下降最快的方向收敛,而是震荡的方式趋向极小点。

余凯教授在龙星计划课程中用“曲线救国”来比喻随机梯度下降。

随机梯度下降表达式例如以下:

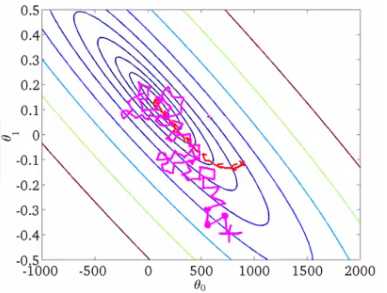

运行步骤例如以下图:

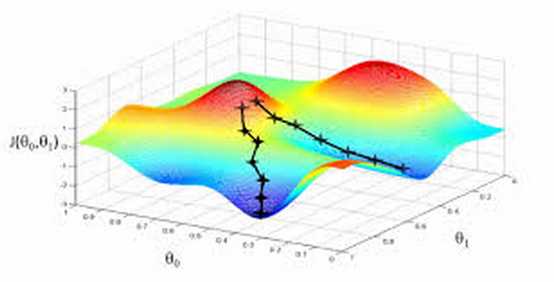

批梯度下降和随机梯度下降在三维图上对照方下:

线性回归是回归问题中的一种,线性回归如果目标值与特征之间线性相关,即满足一个多元一次方程。使用最小二乘法构建损失函数,用梯度下降来求解损失函数最小时的θ值。

线性回归、梯度下降 - Andrew Ng机器学习公开课笔记1.1

标签:ucid imp data- 使用 记录 估算 res targe think

原文地址:http://www.cnblogs.com/jzdwajue/p/7029274.html