标签:font war src 结果 dig 开始 复杂 master span

一、多层神经网络(为什么可以解决多种问题)

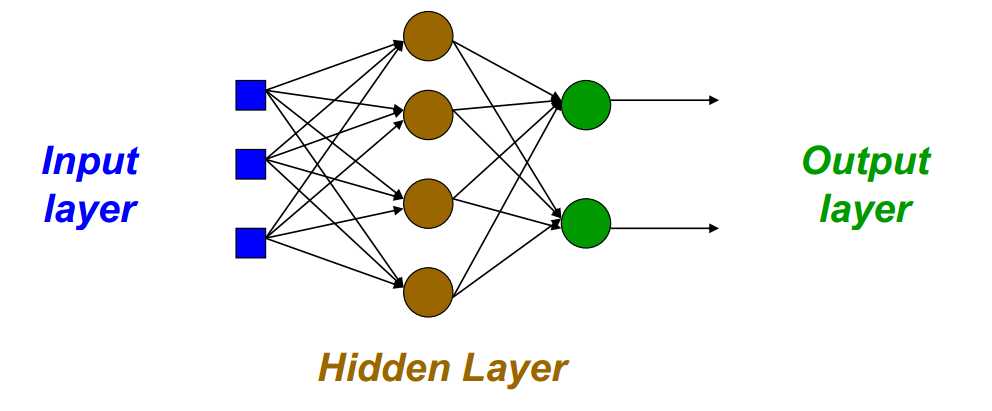

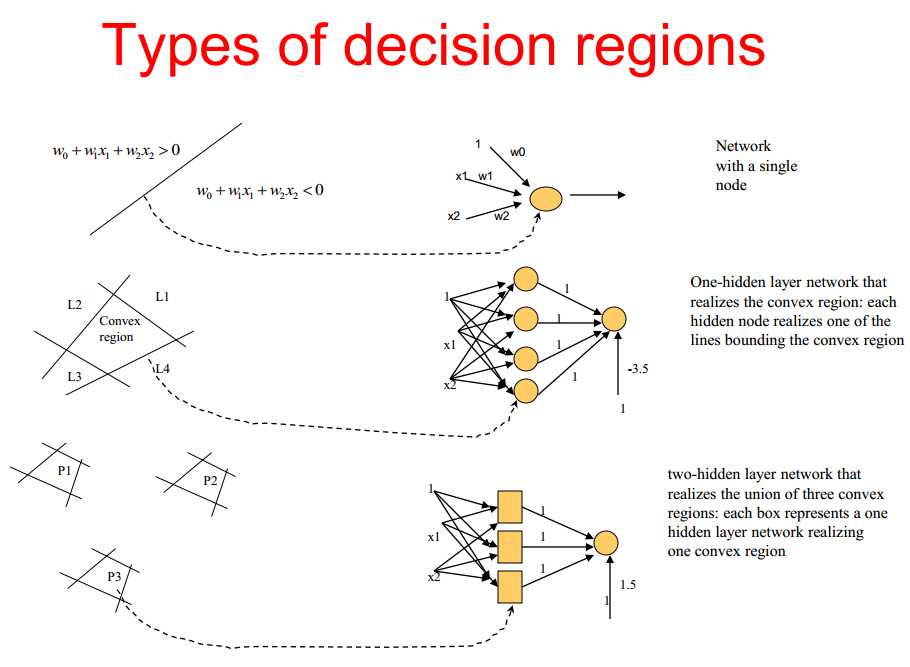

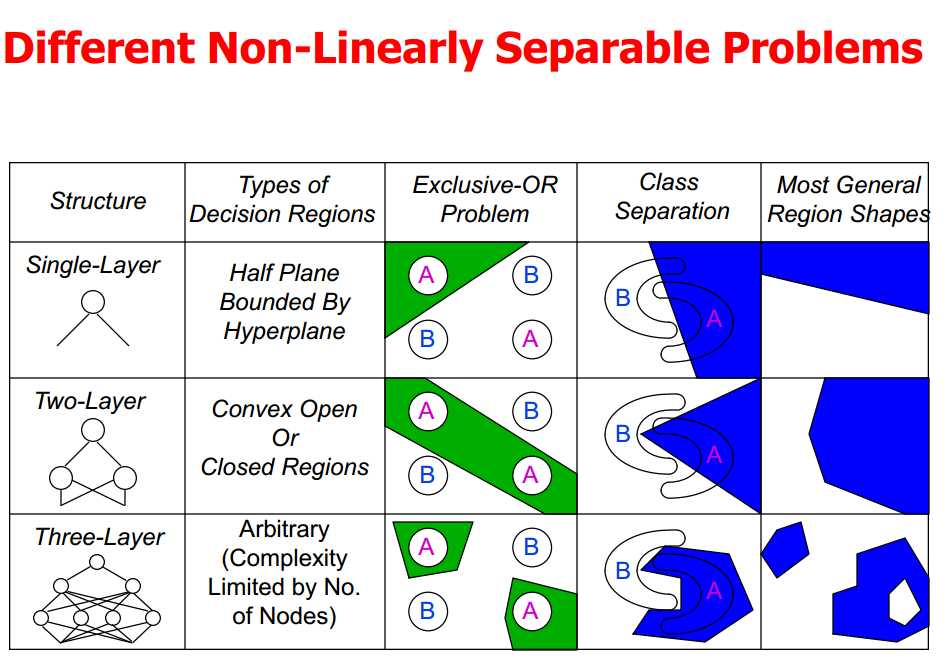

多层神经网络:在输入和输出层上有隐含层,可以克服单层神经网络的限制处理非线性分离问题

第三个图中,每一个方块对应第二个图中神经网络,即有两个隐含层。

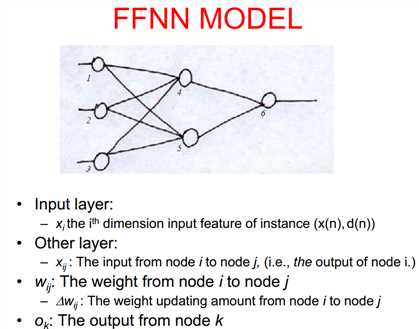

二、Feedforward Neural Networks

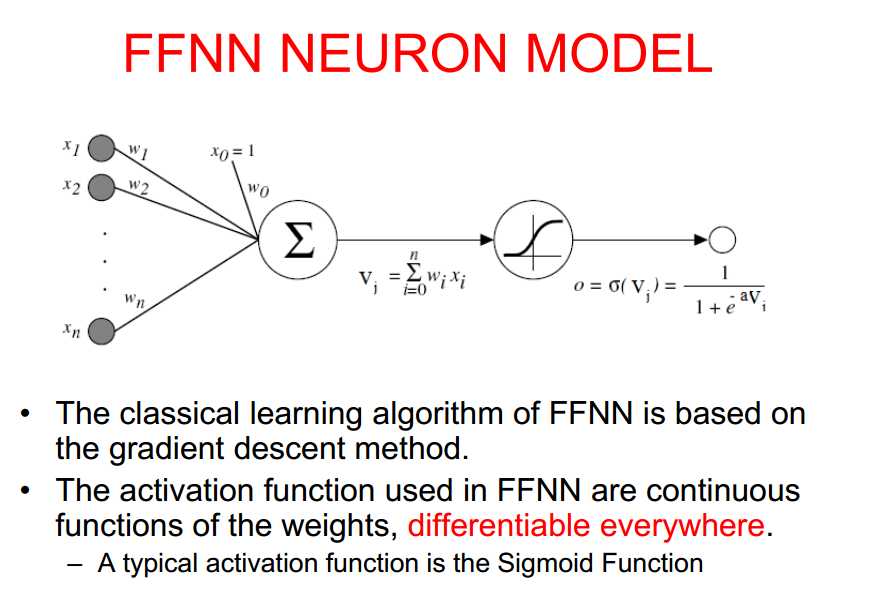

1、FF NN模型

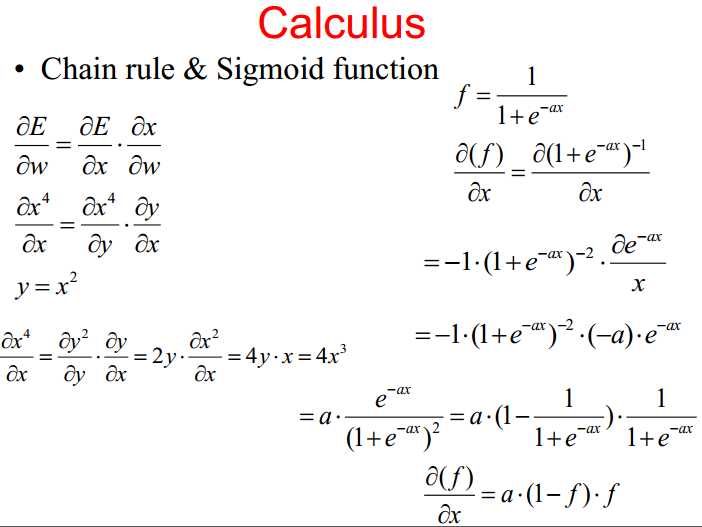

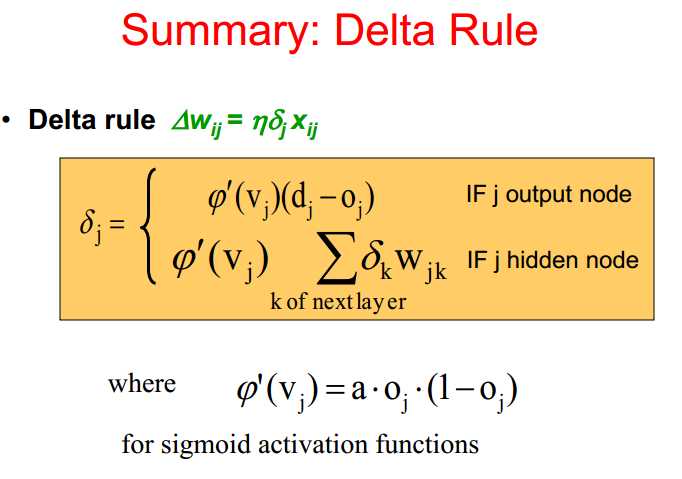

选择sigmoid函数作为激活函数的原因是其处处可导。

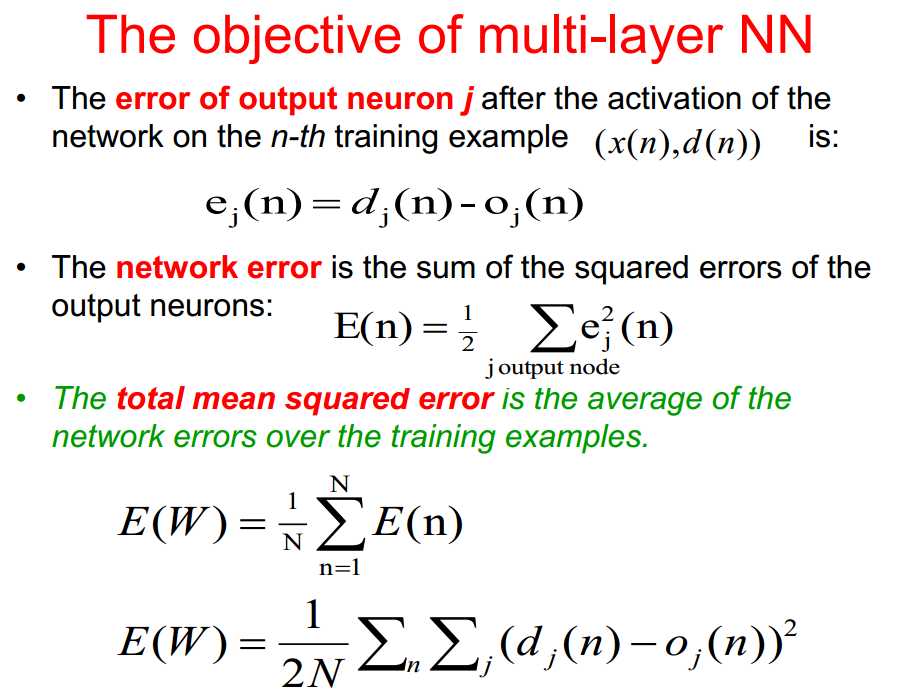

多层神经网络的误差,输出误差(期望输出与真实输出的差)、单个样本网络误差(单个样本对应所有输出与期望输出的误差)、所有样本的网络误差。

前馈神经网络

loss:期望与实际情况的差异 去调整权重。观察到某种情况下(某一权重分布下)的影响(输出结果),去更改行为(权重),以使其往期望的方向改变。

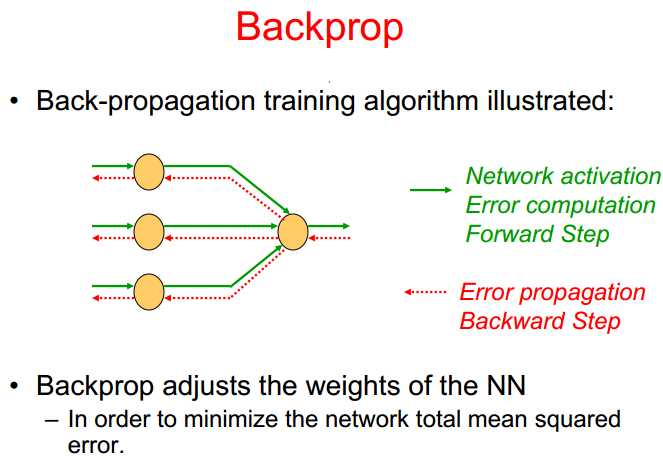

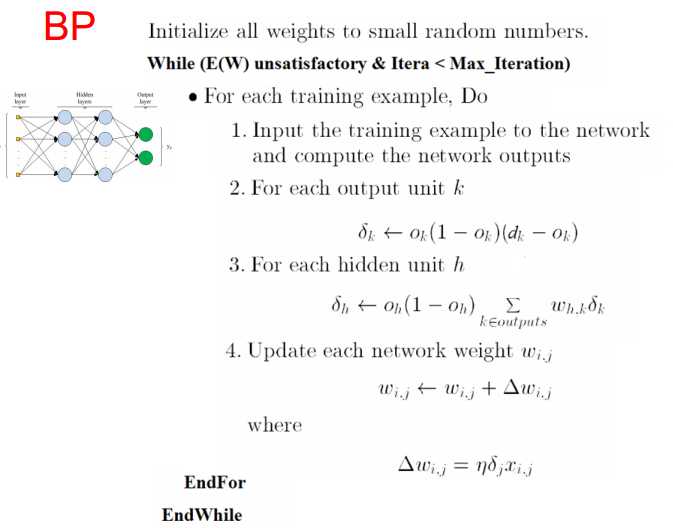

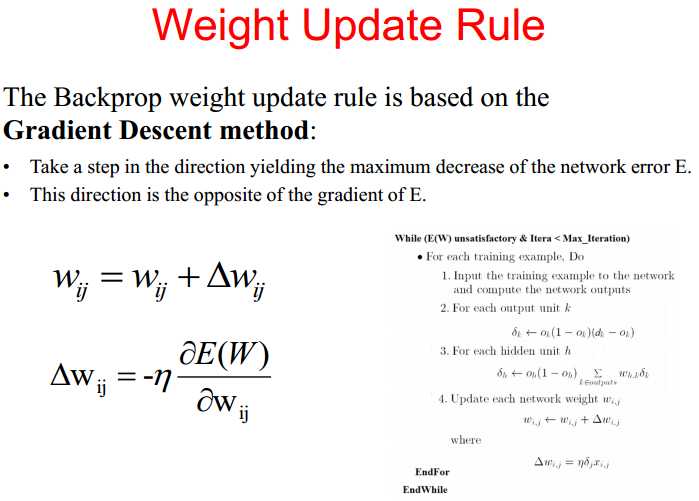

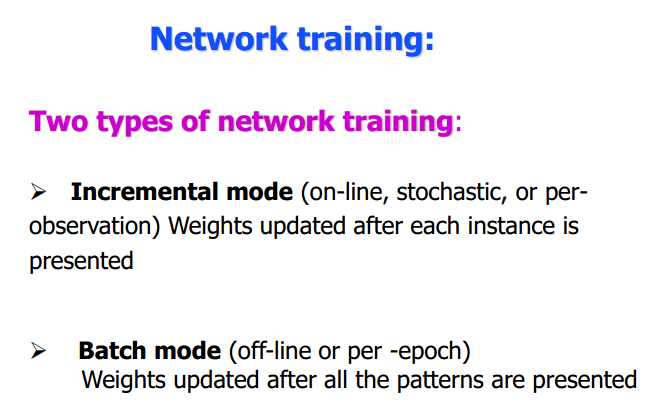

2、训练:BP算法

重复:

算法步骤:

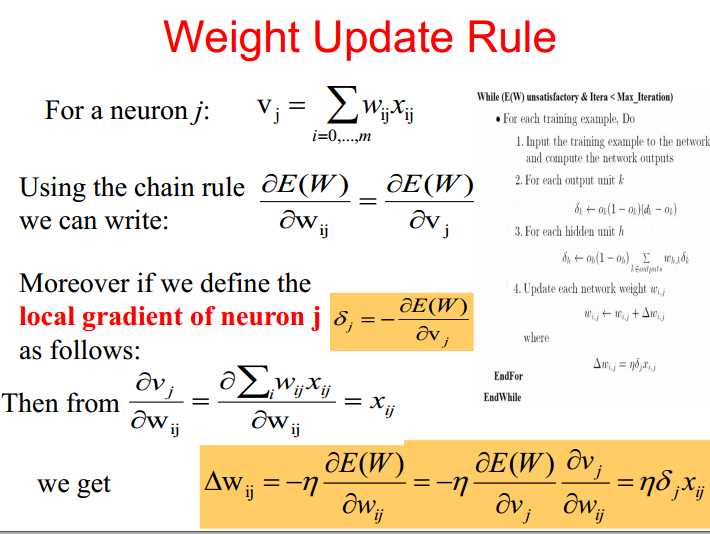

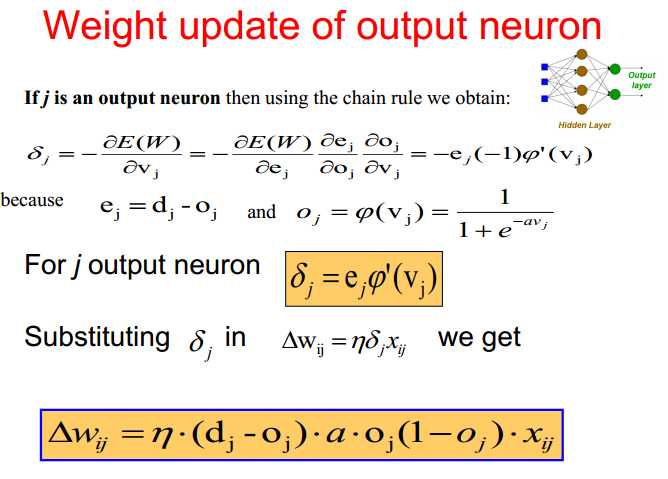

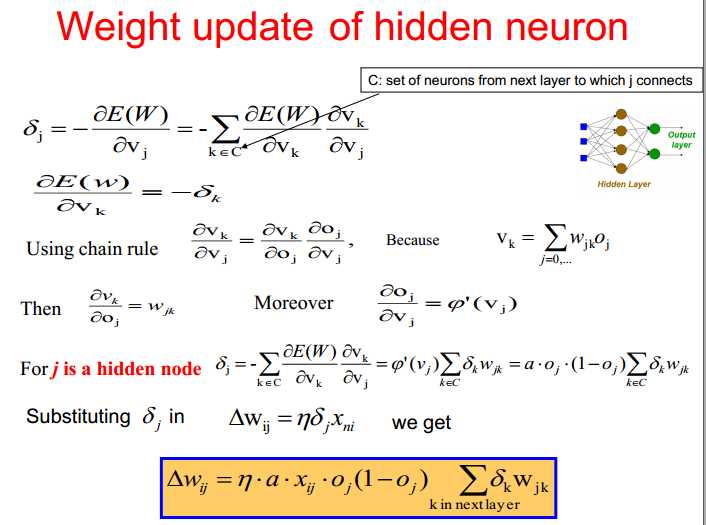

2、BP规则的推导(个人认为十分调理清晰,简单易懂,非常推荐看看)

输出层与隐含层神经元的权重更新不同

各个层到底学到的是什么?

权重与特征并不同等,具有可区分性的特征对应的权重值更大,对应点(神经元)response更高。

这里有一个demo,适合运行在32位的计算机上,希望后面有时间来运行一下(64位要在x86里更改什么来着。。。)

http://www.inf.ed.ac.uk/teaching/courses/inf1-cg/labs/lab6/mcmaster/digit-demo.html

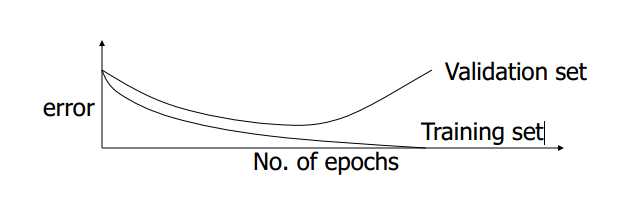

训练停止法则:两点,一是整个平均误差平方达到一个很小的值。二是使用验证集,整个模型的泛化性能表现足够良好。

3、神经网络设计

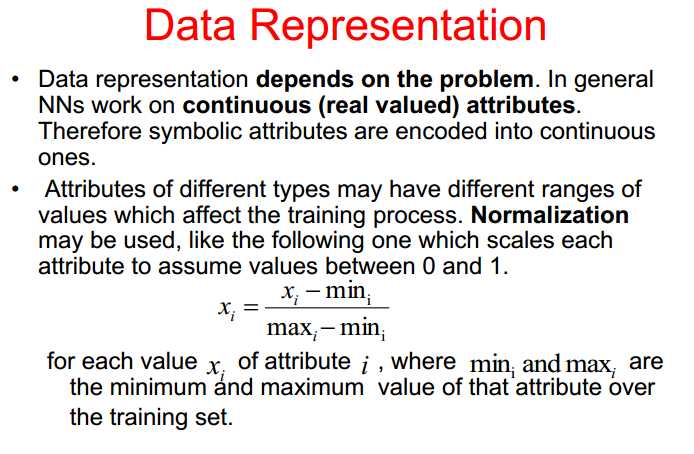

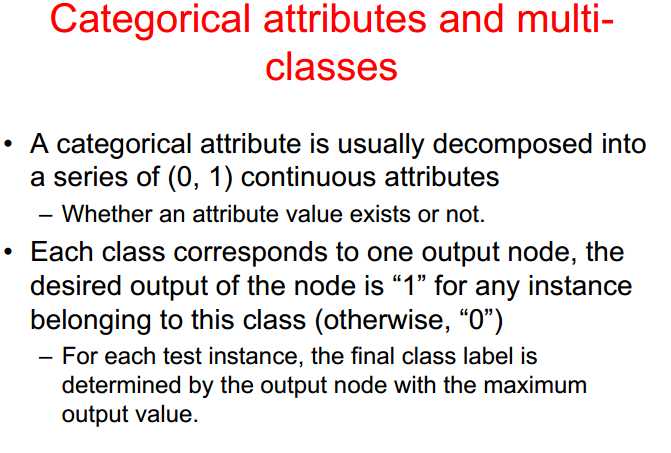

数据表示

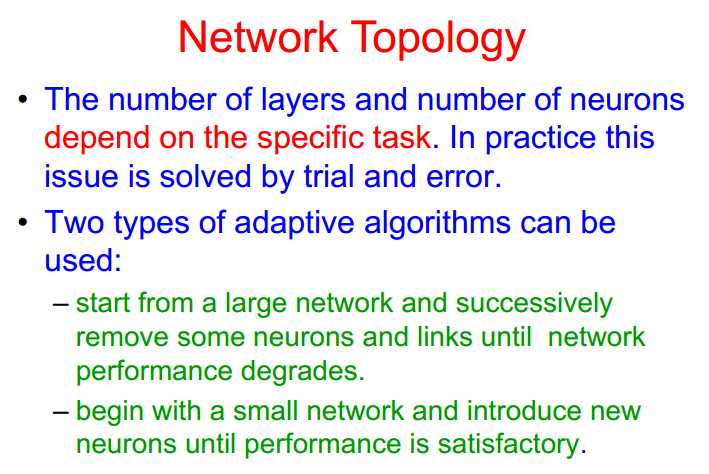

①网络拓扑结构(层数等)

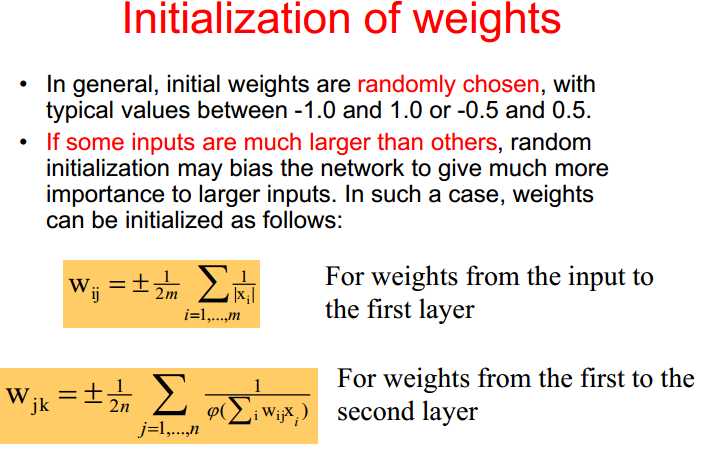

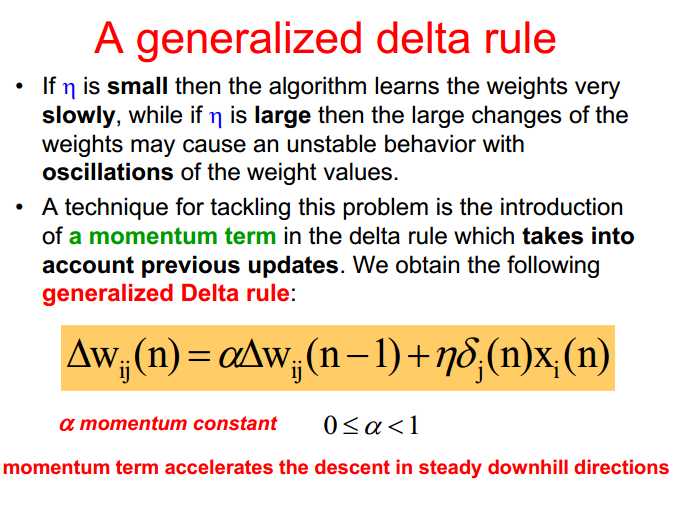

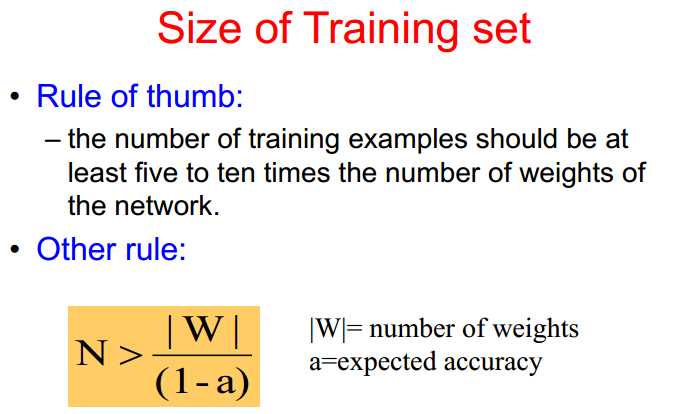

②网络参数(权重、学习率、隐藏层数和神经元个数、训练集样本个数)

2017/7/20 朱兴全教授学术讲座观点与总结第三讲:多层神经网络

标签:font war src 结果 dig 开始 复杂 master span

原文地址:http://www.cnblogs.com/betterforever/p/7220454.html