标签:height 流程 font logs 技术 jpg 9.png ack com

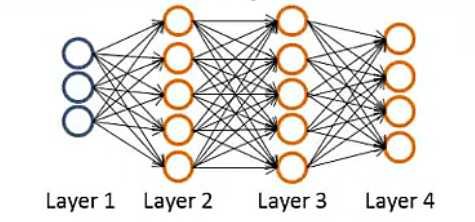

Cost Function:

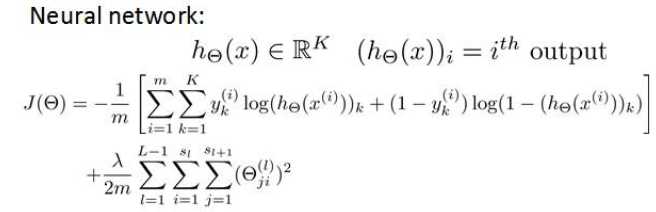

前向传播(Forward propagation)

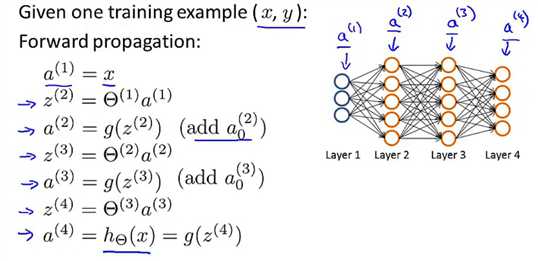

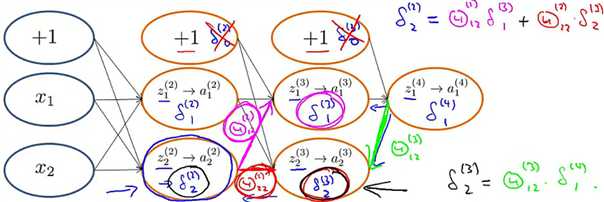

反向传播(Back propagation)

对于反向传播算法最直观的表示就是对于每个节点都计算这样一项(误差项):

![]()

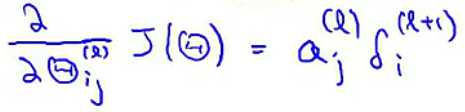

计算完每个节点的误差之后我们便可以得到损失函数对于所有参数的偏导数:

注:这里忽略了正则化项。(aj看成xj)

直观表示:

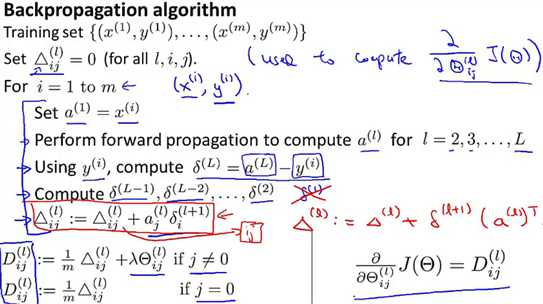

算法流程:

Δ为所有样本的误差和矩阵。

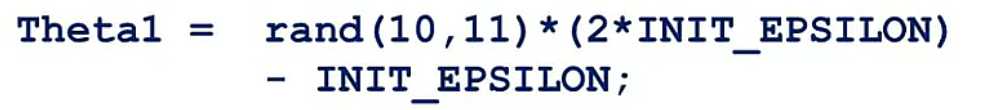

随机初始化参数

对于所有的参数我们必须初始化它们的值,而且它们的初始值不能设置成一样,比如都设置成0或1。如果设置成一样那么所有的a,δ,偏导,所有更新后参数等都会相等。即所有神经元的功能都相等,造成了高度冗余。所以我们必须随机化初始参数。

例如:

表示初始化了一个10*11的参数矩阵,且每个参数都属于[-ε, ε]

标签:height 流程 font logs 技术 jpg 9.png ack com

原文地址:http://www.cnblogs.com/J-K-Guo/p/7236985.html