标签:模型 src round 设置 它的 数值 nbsp col 激活

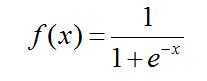

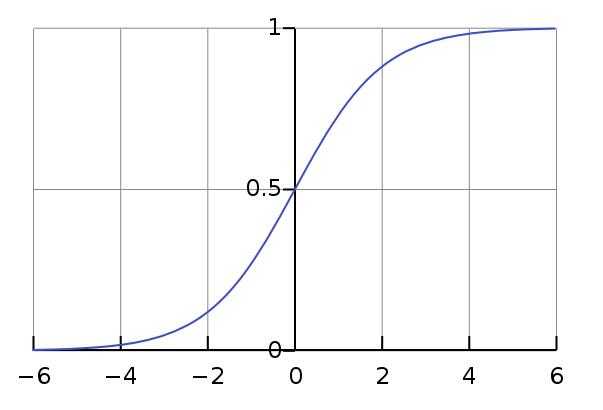

一、Sigmoid函数

1)表达式

2)函数曲线

3)函数缺点

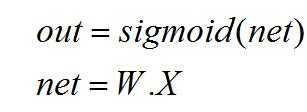

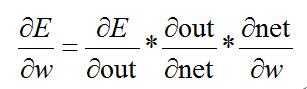

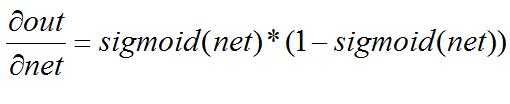

反向求导:

而其中:

所以,由上述反向传播公式可以看出,当神经元数值无线接近1或者0的时候,在反向传播计算过程中,梯度也几乎为0,就导致模型参数几乎不更新了,对模型的学习贡献也几乎为零。也称为参数弥散问题或者梯度弥散问题。

同时,如果初始权重设置过大,会造成一开始就梯度接近为0,就导致模型从一开始就不会学习的严重问题。

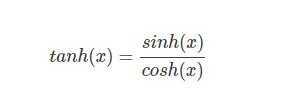

二、tanh函数

1)公式

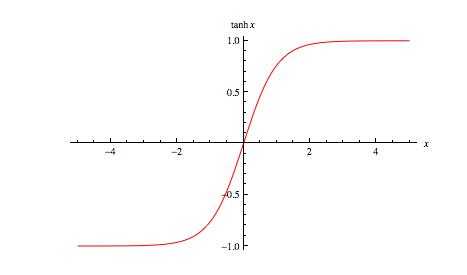

2)曲线

tanh 函数同样存在饱和问题,但它的输出是零中心的,因此实际中 tanh 比 sigmoid 更受欢迎。

三、ReLU函数

标签:模型 src round 设置 它的 数值 nbsp col 激活

原文地址:http://www.cnblogs.com/gczr/p/7520723.html