https://www.bilibili.com/video/av21662972

该算法用openpose实现

以前的人体检测技术很容易找不到人,或者是当人和人靠得非常近的时候,容易识别错误,而CMU的openpose解决了这个问题,在车内的前排座位的遮挡下也能轻易识别到后排乘客。

openpose的原理可以参考这个视频:

https://www.bilibili.com/video/av19506719

2、目标跟踪

该技术主要是和目标检测算法在一起融合实现对视频内的人进行行为识别,判断无人超市中的目标是否正在移动,然后他的移动方向。暂时采用kcf方法和eco方法。

相当于是先识别后跟踪,在判断方向。

3、深度学习目标检测

采用rssd算法识别图片中的目标用于无人超市的结账,该算法速度较快也有很高的召回率。

因为在voc数据集中样本和要预测的图片是有差别的,比如样本是很多猫,需要识别的猫并不在样本中 还有遮挡,在该场景实际应用中,货品样本和要预测的物品差异几乎为零,也就是一模一样,所以识别精度有保证。

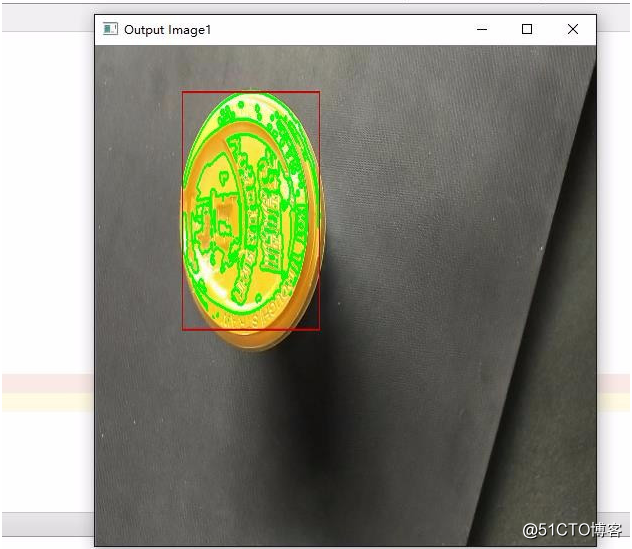

4、自动阈值设定的抠图打标记方法

以前的目标检测每一个模型需要大量的人工对图片中的目标进行标注,现采用阈值设定方法从图中检测出物品用于深度学习的特征提取。可以节省人工提高上新品的速度,现在只需要很短的时间即可将新品录入系统,训练模型让系统快速掌握识别该物品的能力。

5、强化学习在智能运营当中的运用

公司所在的出行行业需要提高司机的接单效率,尽量能够在最短的时间完成最优的订单,那么如何知道司机每天的什么时候应该在什么地方等单。

可以用q-learning的方法,假设每个时间的每个地点属于司机当前的一种状态,那么司机选择去什么地方就是一个action 对应的也得到一个价值 就是订单。

我们建立一个模拟整个城市的模拟运营系统,在里面设置多个司机智能体,通过每天的模拟运行,司机就能够学习到一张表:

创建一个表格。通过它,我们可以为每一个状态(state)上进行的每一个动作(action)计算出最大的未来奖励(reward)的期望。

随着系统内司机的增多,每个地区的乘客被陆续接走,也就是某个地区的乘客人数减少,相应的奖励(reward)也将减少,随着系统迭代模拟次数增加,每个司机的路线都逐渐稳定。根据模拟结果可以指定具体精准的运营策略。

原文地址:http://blog.51cto.com/yixianwei/2106804