标签:采样 规范 计算机 变换 来讲 线性变换 分享图片 计算 模型

《深度学习与计算机视觉》

要看

页:28、30、37、51-53、66-70、

73-78、81、84、88-95、100、

104、113-115、120-121、125-126

125-138、

< 125页的计算还有通道,是我想要的东西。>

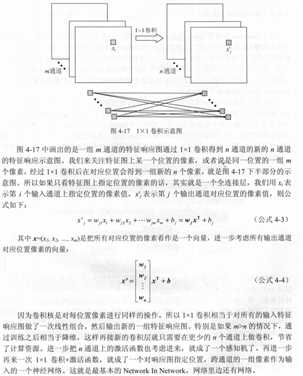

< 136页的1×1卷积,是我想要的东西。>

两个向量的点积结果是,对应位子相乘再相加。

卷积核步长越大,卷积结果的维度越小,这就达到了降采样的目的。

全连接层的非线性变换是激活函数,卷积层的也是。

L2规范化就是权重衰减,它用于wx+b的w里面。

L1规范化

待卷积项与卷积核做卷积之后,得到的结果叫做,特征响应图(feature map)。

卷积核的作用是,可以找到,图像中和自身纹理最相似的部分。

每一张图称为一个通道。

分步式就是多对多。

下图是1×1卷积的解释

关于Bound Box Regression算法,我看的是https://blog.csdn.net/ap1005834/article/details/77915794 和 https://blog.csdn.net/zijin0802034/article/details/77685438,后一篇是对前一篇中某些看不懂的地方的解释说明,其中关于“为什么当IoU>6时能将模型用线性回归来近似”讲的最好,用高数里面的等价无穷小来讲的。

[深度学习][图像处理][毕设][常识]关于图像处理的一些基本常识,以及最近5天的笔记。2018.5.2号

标签:采样 规范 计算机 变换 来讲 线性变换 分享图片 计算 模型

原文地址:https://www.cnblogs.com/zf007/p/8979638.html