标签:oid 专用 softmax 函数 回归 反向 max dcos 图片

监督学习

非监督学习:学习结构化知识

强化学习

监督学习:

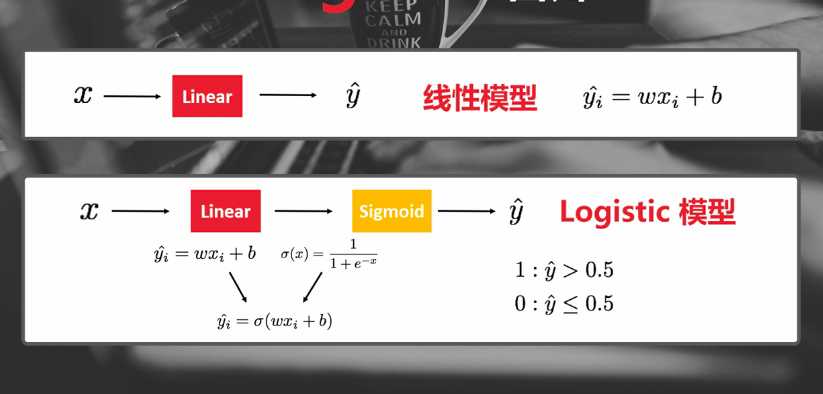

线性回归模型:输出y是连续的

Logistic回归模型(实际上不是回归问题,是分类问题):输出y是0,1离散的

Logistic回归模型:

Sigmoid函数:将任何输入变成0与1之间的输出,也用来表示概率

softmax函数:将多个输入变成总和为1的输出,

图片

且cost函数有变化,变成二分类专用函数或者交叉熵(衡量两个分布相似性)

梯度下降法:w=w-a(dcost/dw) 使cost变小

反向传播算法(链式法则)

有各种优化算法,但都是先算出各个参数的梯度,下一节介绍各种优化算法

标签:oid 专用 softmax 函数 回归 反向 max dcos 图片

原文地址:https://www.cnblogs.com/rotate/p/9009721.html