标签:ati nat ESS course 就是 方式 两种 现在 训练

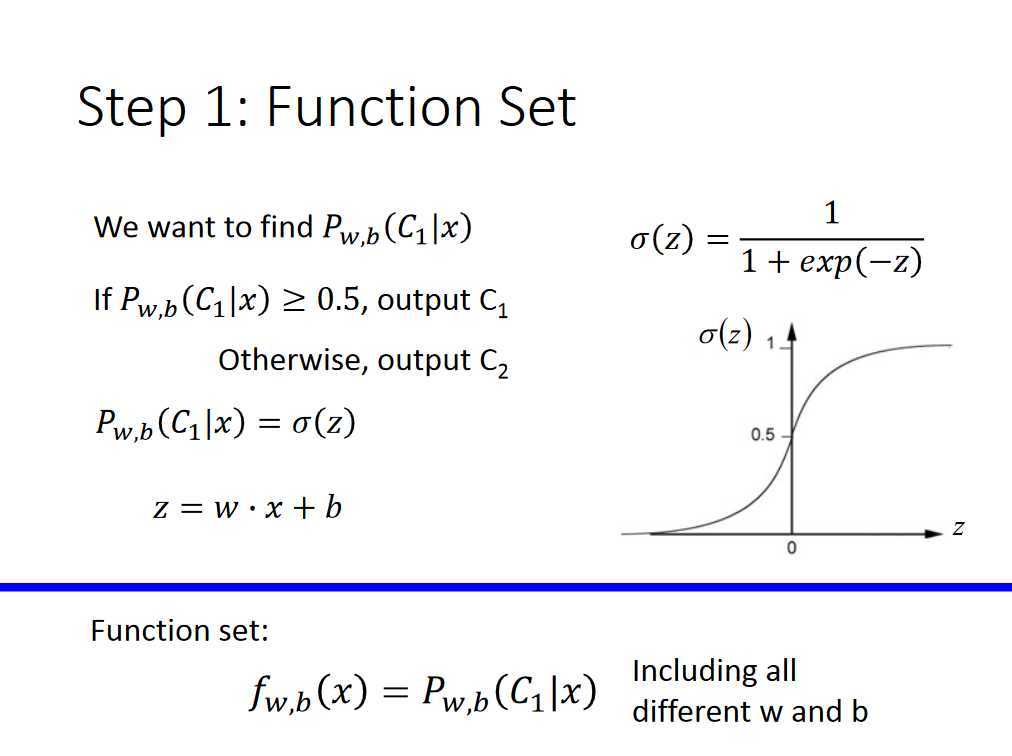

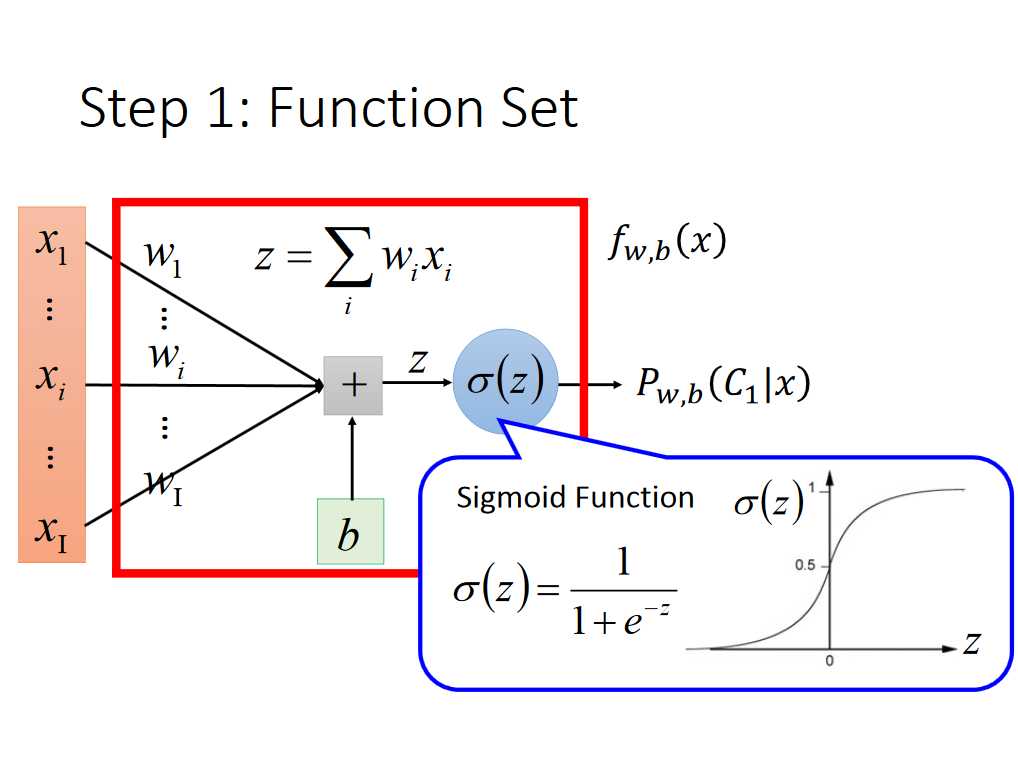

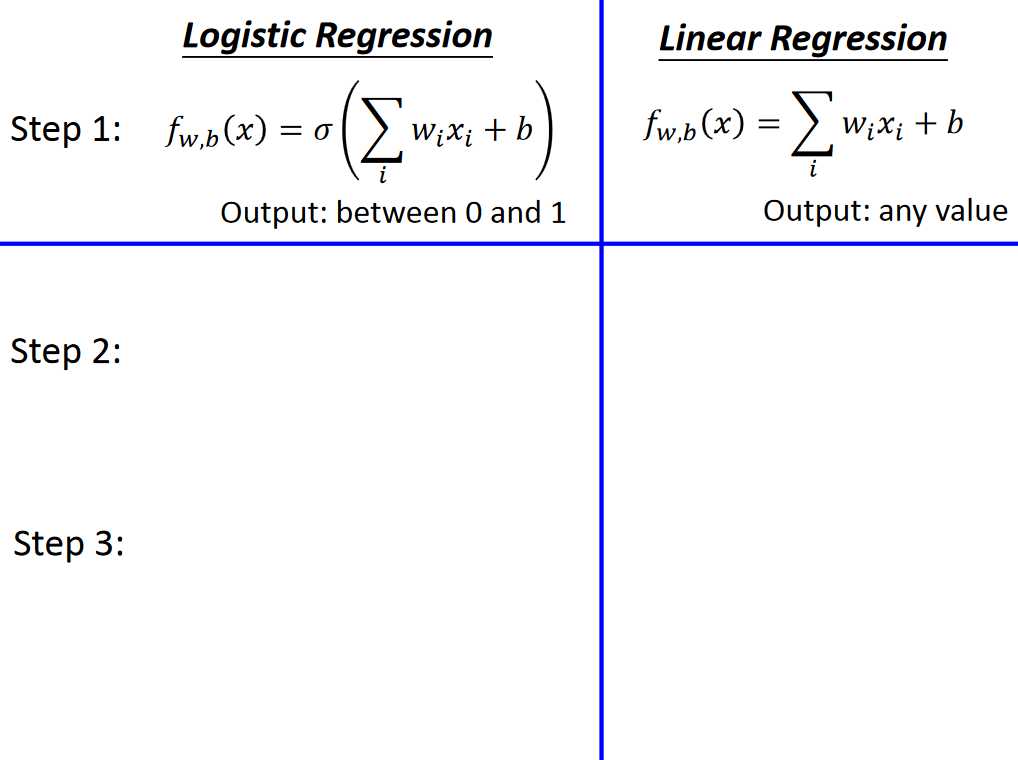

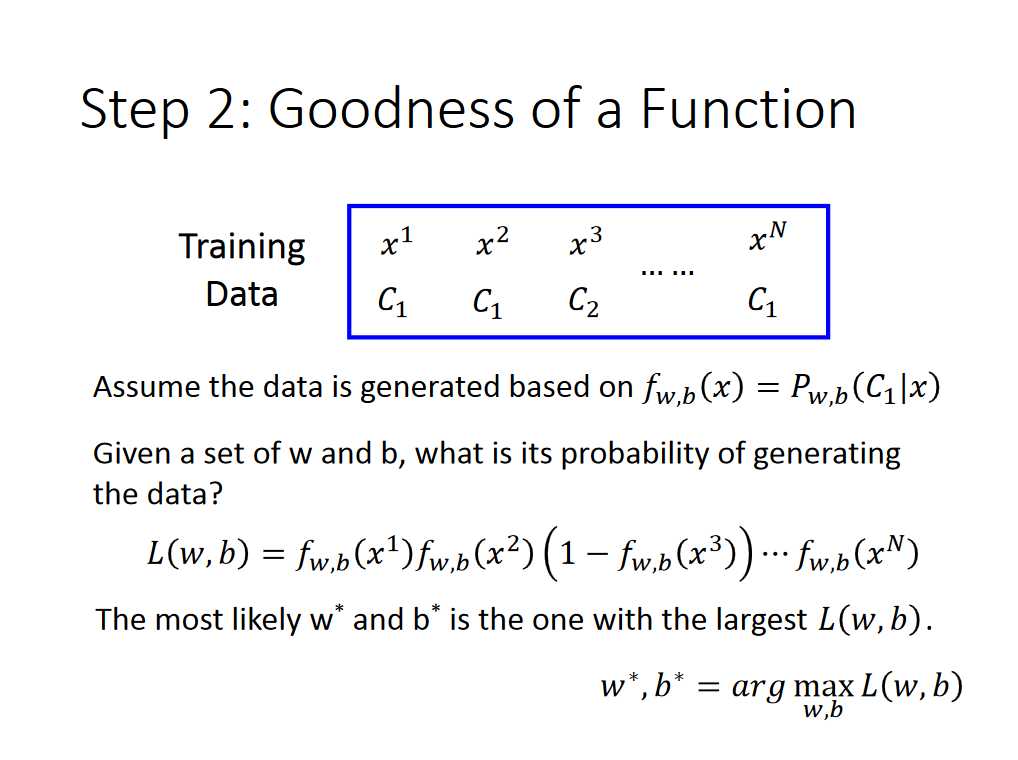

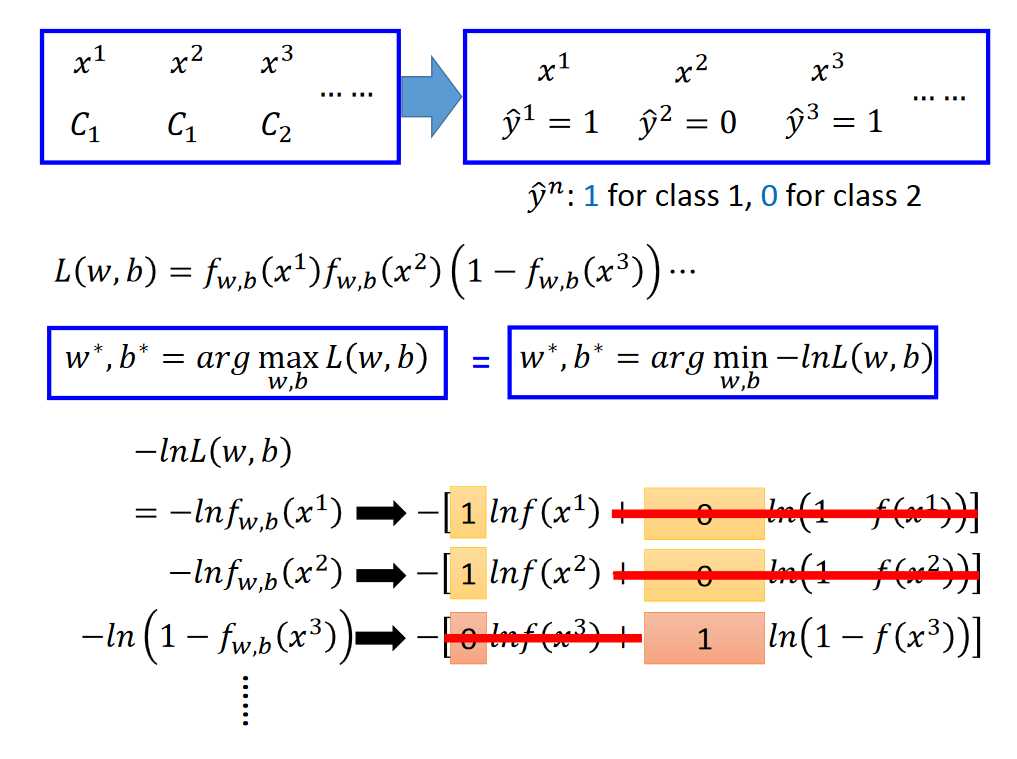

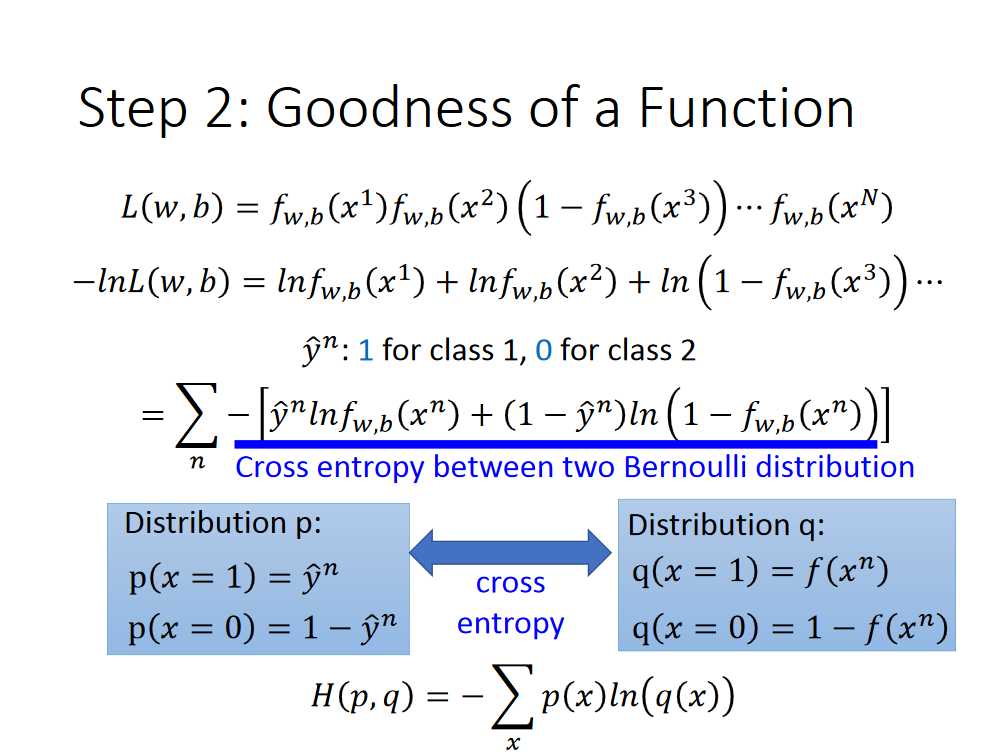

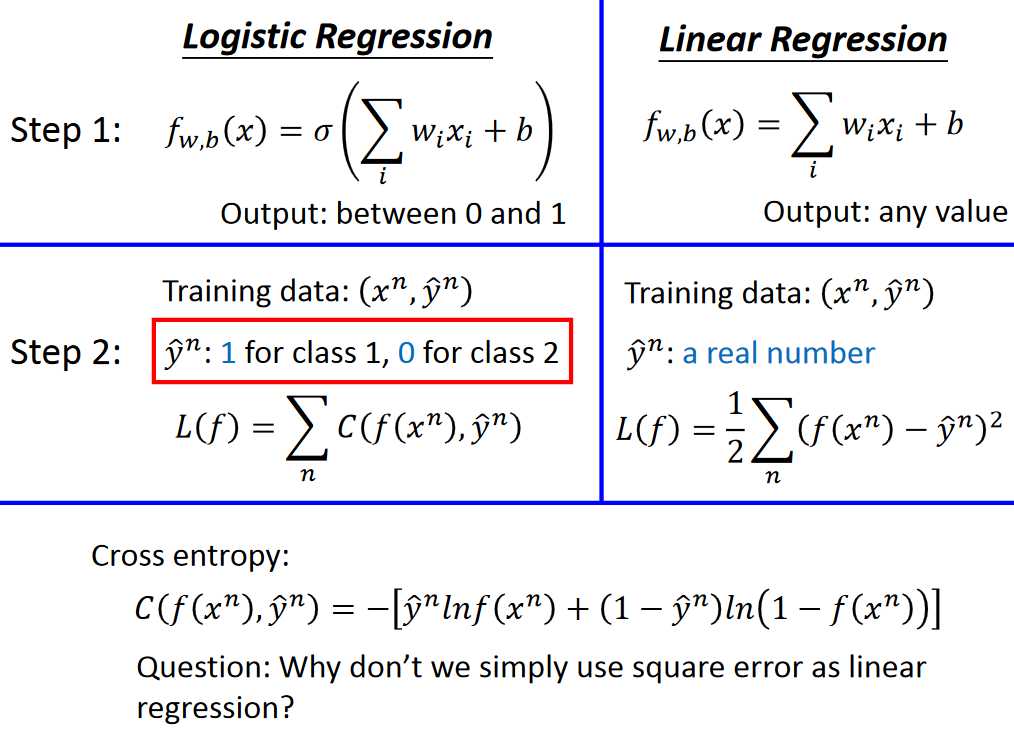

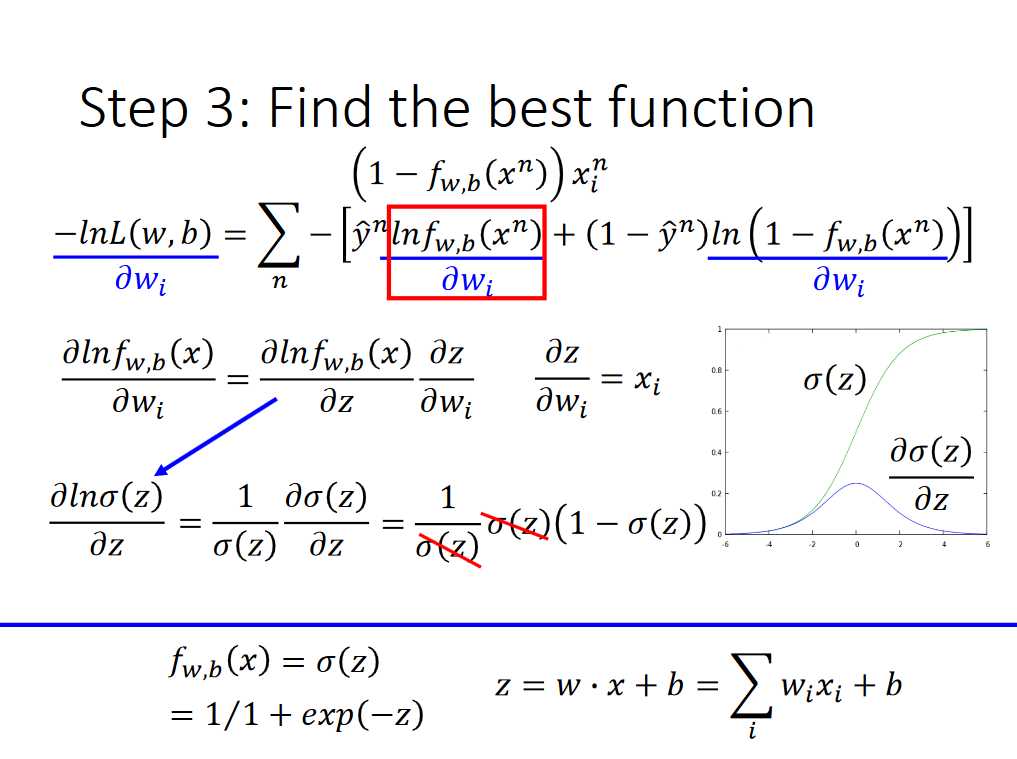

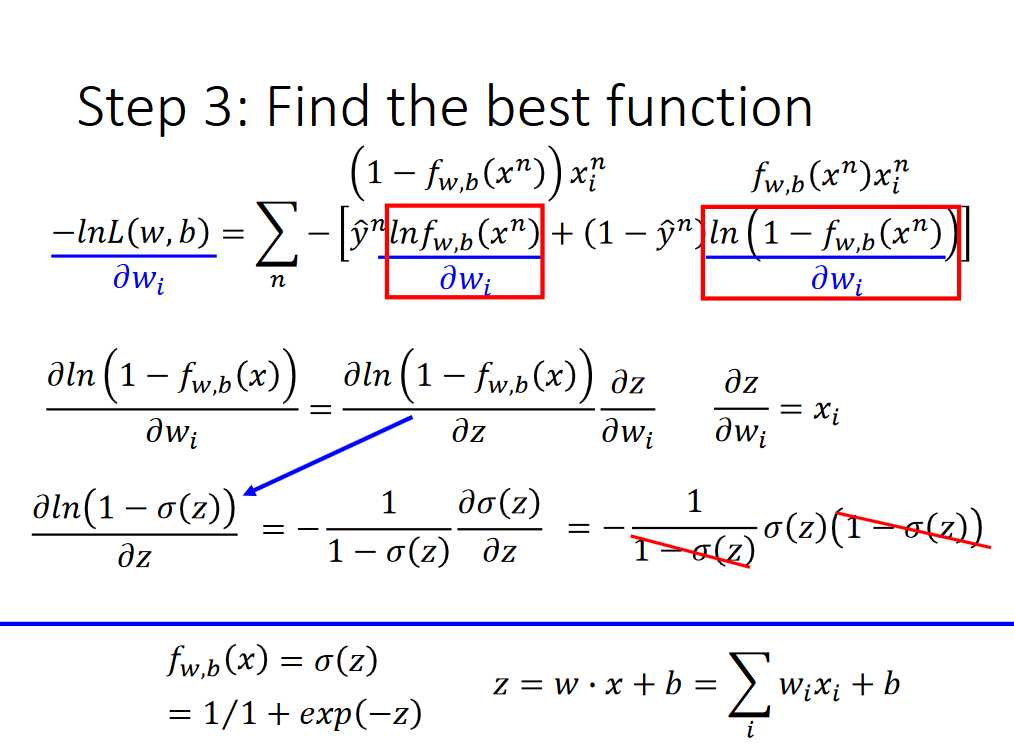

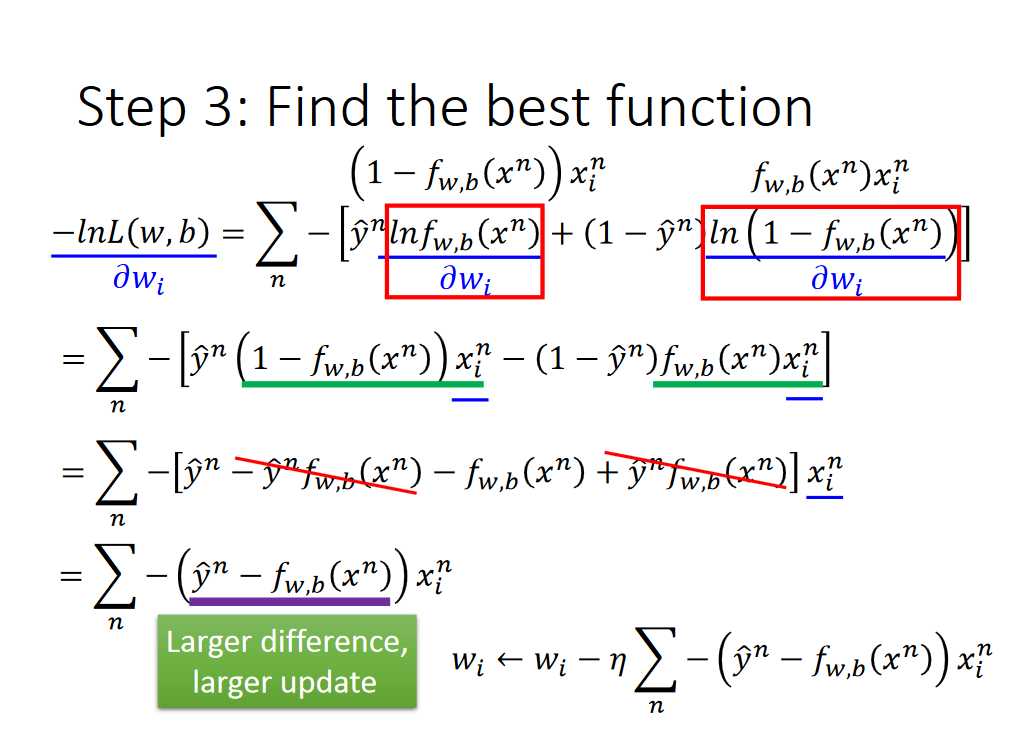

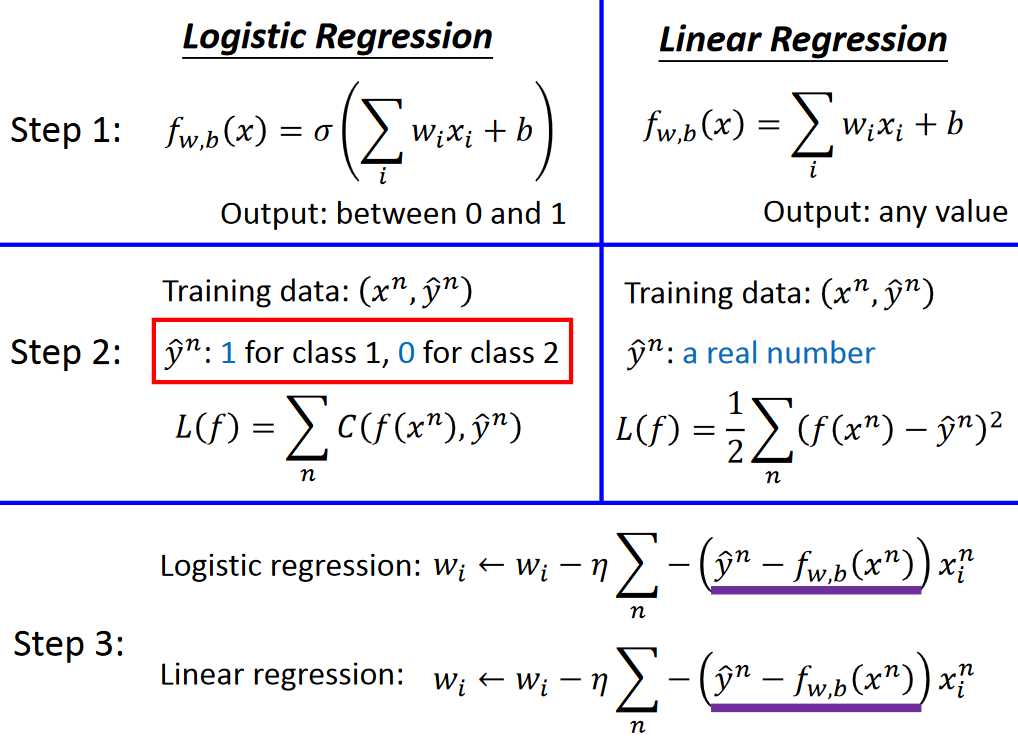

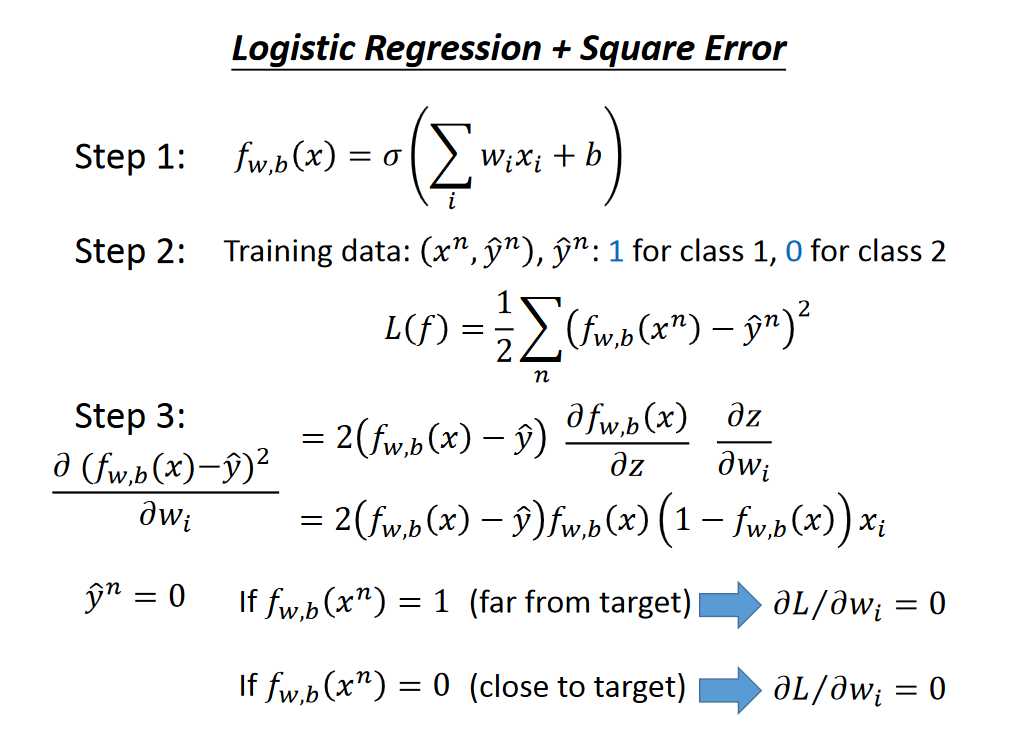

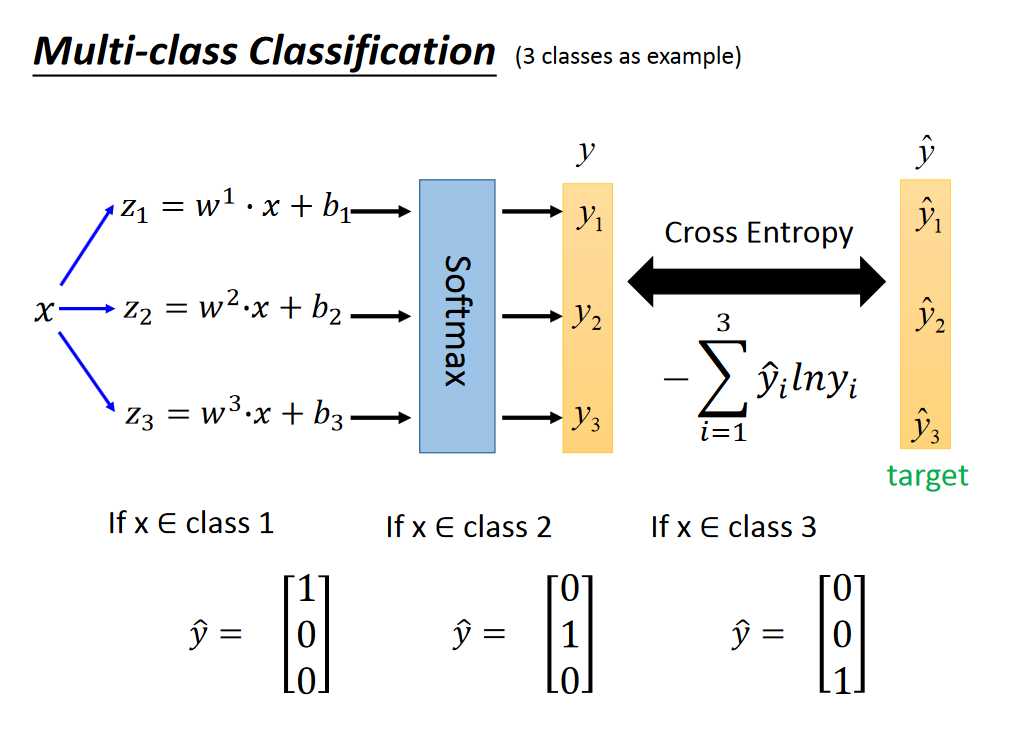

Logistic Regression的三个步骤

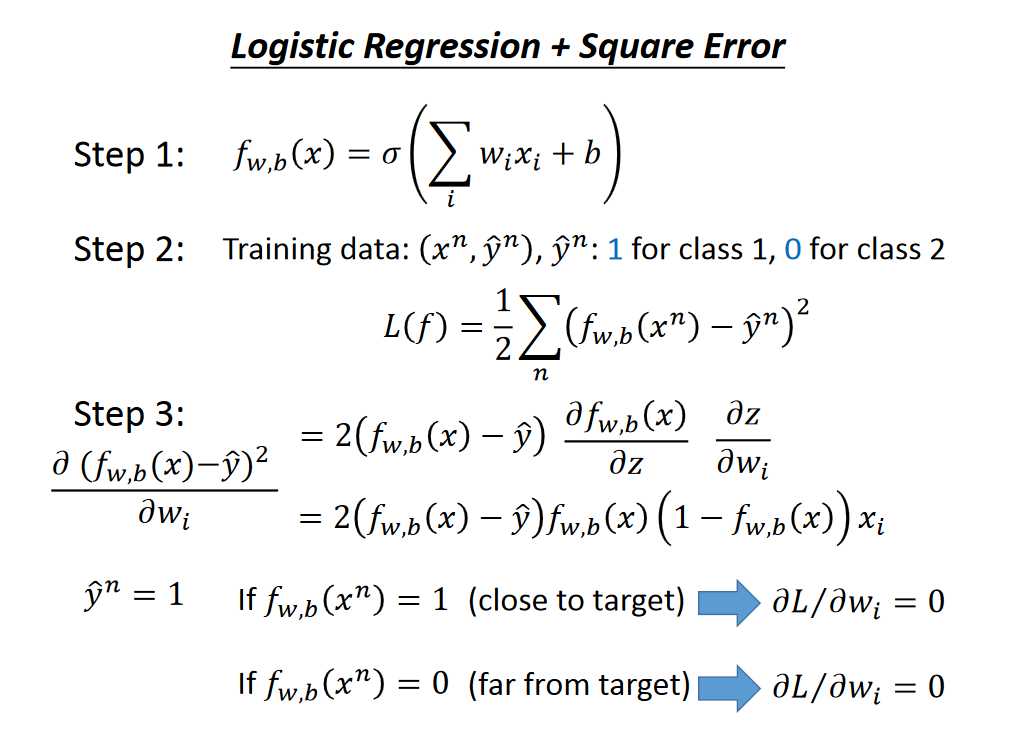

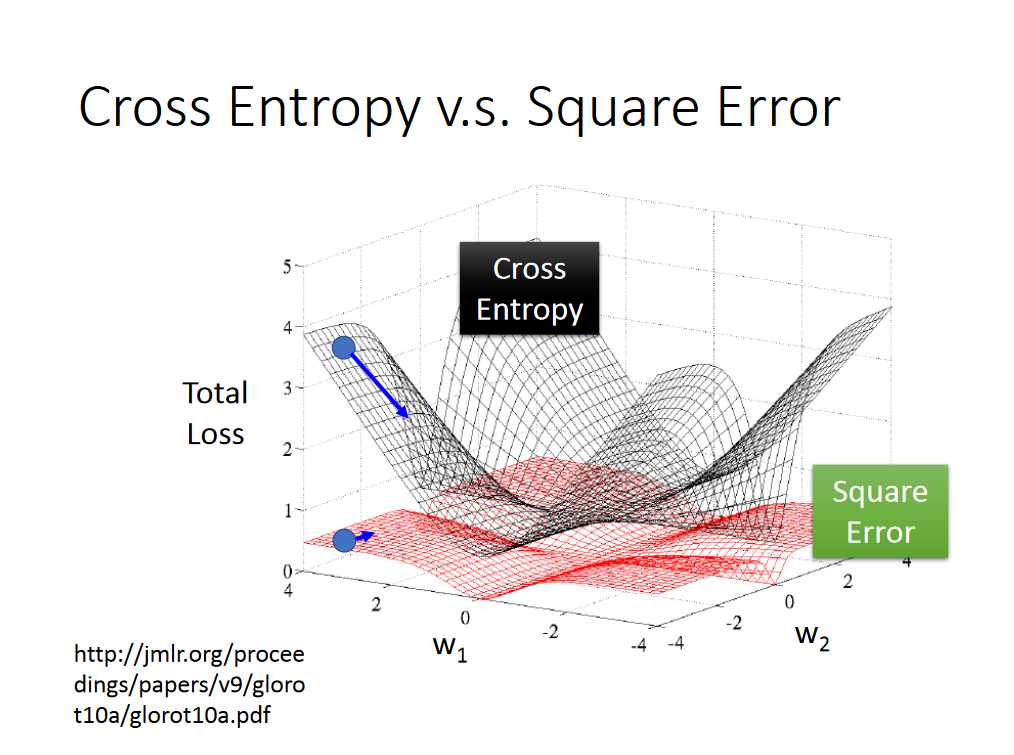

现在对为什么不使用均方误差进行分析(步骤二的)

由上图可以看出,当距离目标很远时,均方误差移动速率也很慢,不容易得到好的结果。

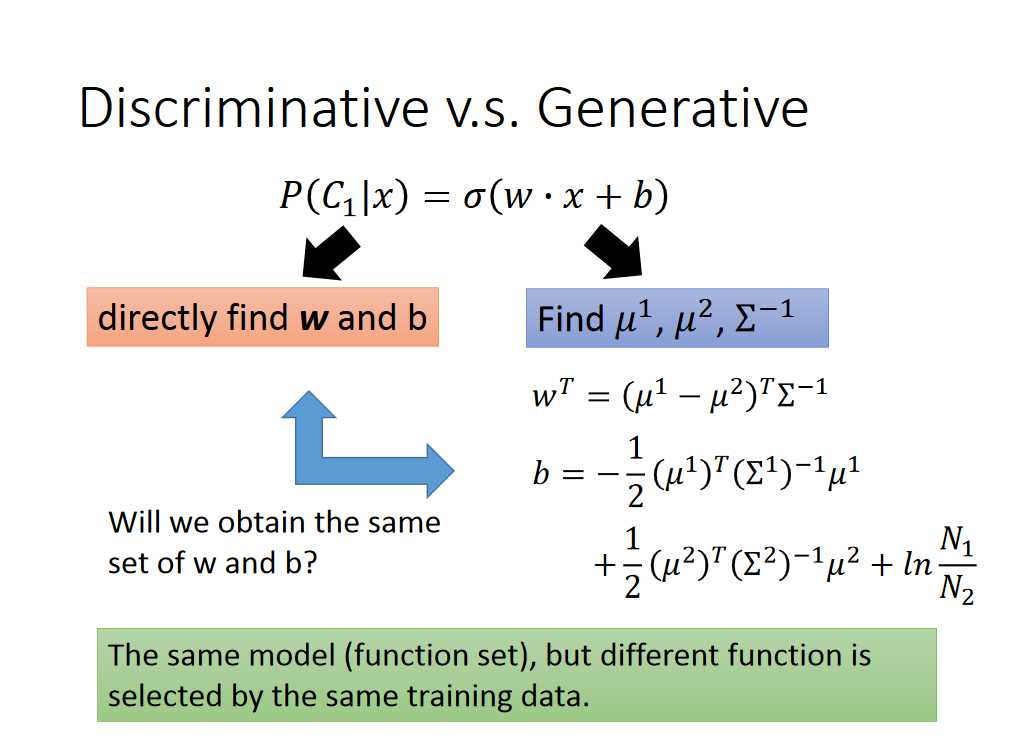

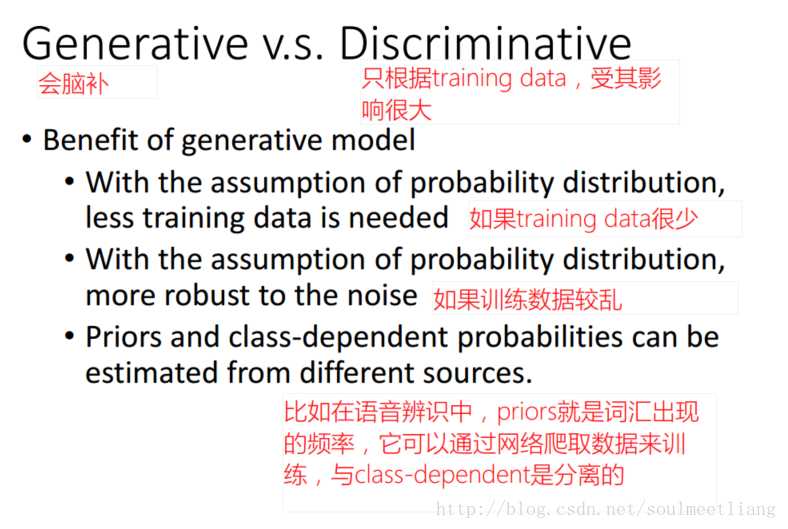

Discriminative(Logstic) v.s. Generative(Gaussion)

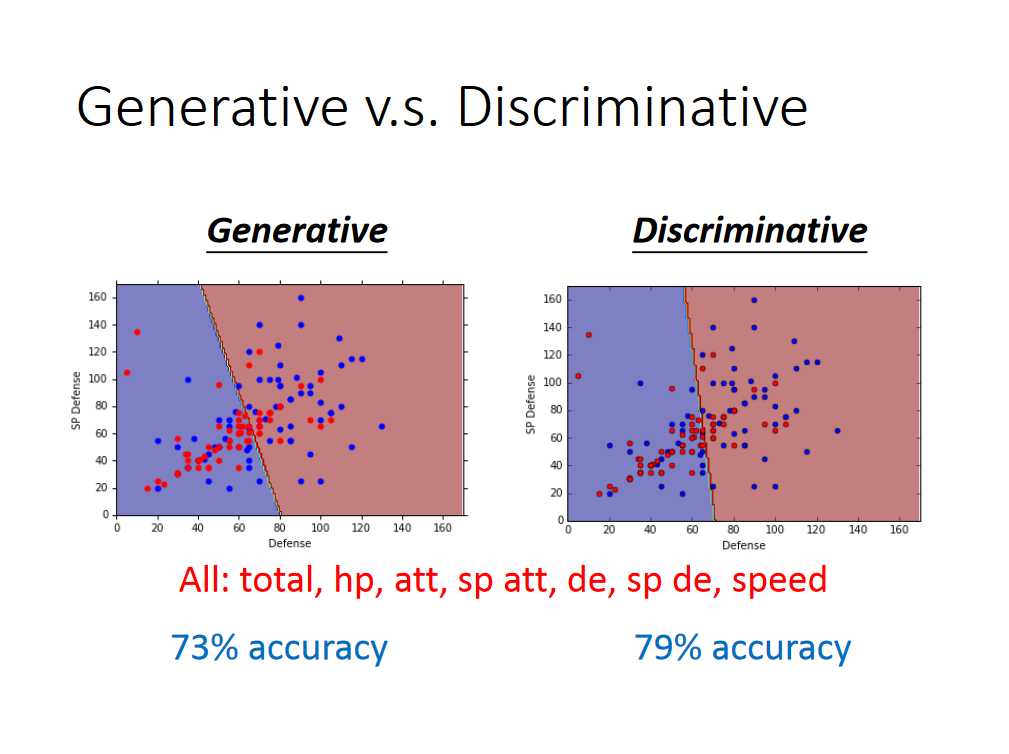

两种方法的model是一样的,训练的数据是一样的,但是找出来的参数不一样!!!

通常来说Discriminative的性能要比Generative要好,但是Generative也有自己的特色。

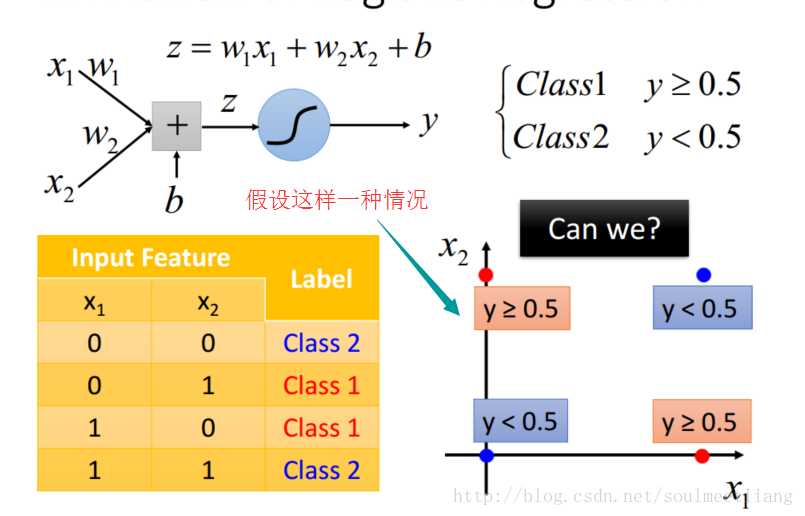

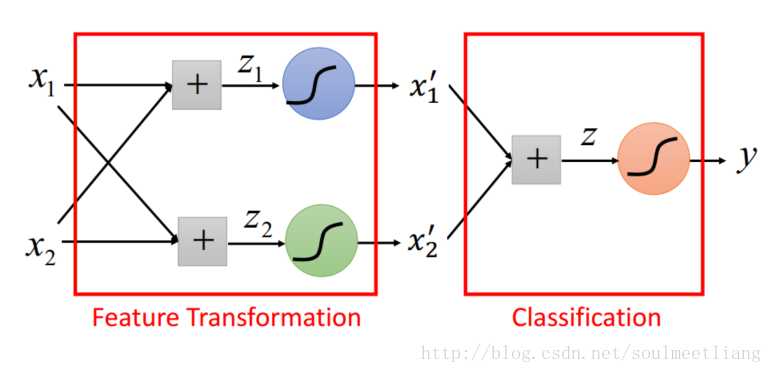

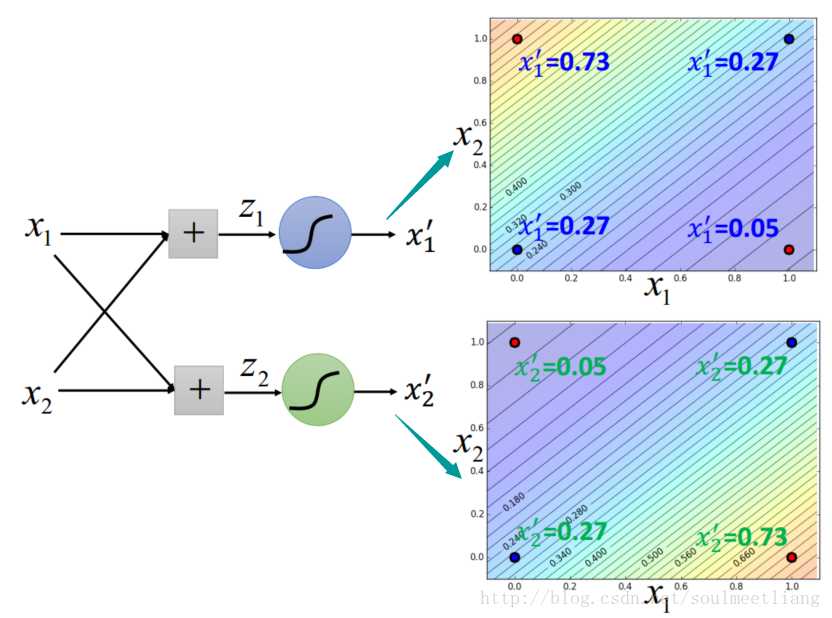

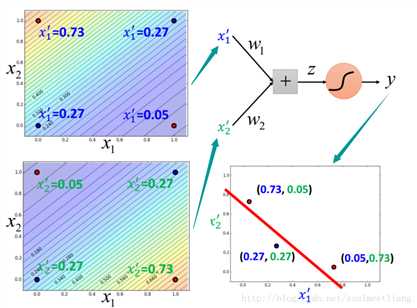

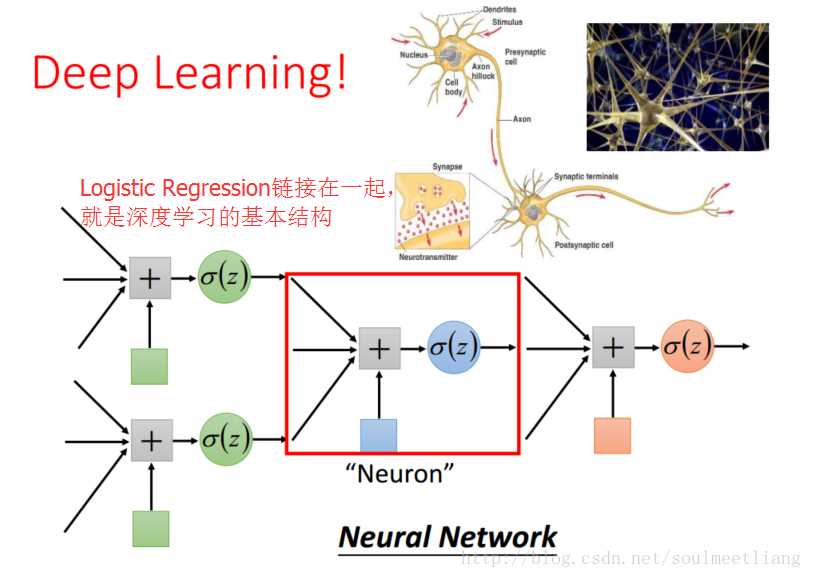

还可以使用另一种转换方式:Cascading logistic regression models就是一种转换的普适方法。

参考:http://speech.ee.ntu.edu.tw/~tlkagk/courses/ML_2016/Lecture/Logistic%20Regression%20(v3).pdf

标签:ati nat ESS course 就是 方式 两种 现在 训练

原文地址:https://www.cnblogs.com/Terrypython/p/9396297.html