标签:cpu 编写 context text dag span justify res 包括

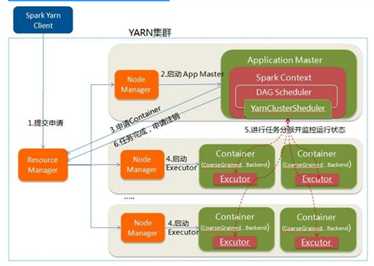

SparkContext将应用程序代码分发到各Executors,最后将任务(Task)分配给executors执行

Driver重点:创建和关闭sparkcontext.

excutor重点:某个Application运行在worker节点上的一个进程,该进程负责运行某些Task,运行Task的数量取决与分配给它的cpu个数。

Work为子节点。

Job:根据Job构建基于Stage的DAG

Stage:多个taskset(task集合)

Task:执行的任务的最小单位。

Spark Cluster模式:

待续

标签:cpu 编写 context text dag span justify res 包括

原文地址:https://www.cnblogs.com/hukeshare/p/9790063.html