标签:过程 -- .data 文件 provider apach .com eth http通信

附上word文档:https://files.cnblogs.com/files/han-guang-xue/6.01hadoop-zookeeper%E7%9A%84HA%E9%9B%86%E7%BE%A4%E7%9A%84%E6%90%AD%E5%BB%BA.pdf

在搭建过程中出现了各种问题,但是还好,最终都解决掉了,其中遇见了有各种奇葩的bug

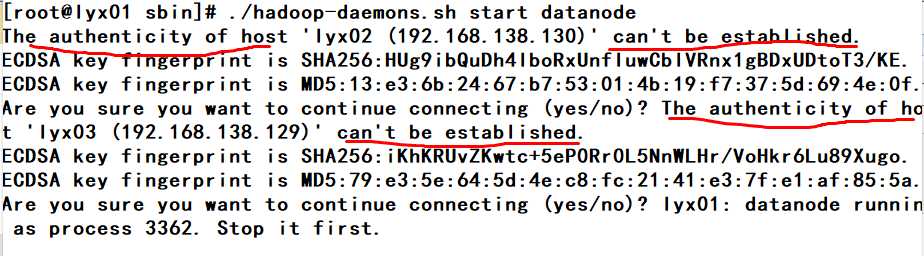

1>启动yarn-site.xml或是输入其他命令报the authenticity of host ‘主机名称+id‘ cant be established

解决方法:需要在另外两台机器上使用ssh ip地址,例如 ssh 192.168.188.130 来免密登录一下需要开启yarn的机器;

hdfs-site.xml中的配置内容 移除之前的hdfs-site.xml文件,然后新建hdfs-site.xml,拷贝

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!--指定hdfs的nameservices需要与core-site中的相同--> <property> <name>dfs.nameservices</name> <value>ns</value> </property> <!--ns下面有两个NameNode--> <property> <name>dfs.ha.namenodes.ns</name> <value>nn1,nn2</value> </property> <!--nn1的RPC通信地址--> <property> <name>dfs.namenode.rpc-address.ns.nn1</name> <value>han01:9000</value> </property> <!--nn1的http通信地址--> <property> <name>dfs.namenode.http-address.ns.nn1</name> <value>han01:50070</value> </property> <!--nn2的RPC通信地址--> <property> <name>dfs.namenode.rpc-address.ns.nn2</name> <value>han02:9000</value> </property> <!--nn2的http通信地址--> <property> <name>dfs.namenode.http-address.ns.nn2</name> <value>han02:50070</value> </property> <!--指定NameNode的元数据在JournalNode上的存放--> <property> <name>dfs.namenode.shared.edits.dir</name> <value>qjournal://han01:8485;han02:8485;han03:8485/ns</value> </property> <!--指定JournalNode的本地存放地址--> <property> <name>dfs.journalnode.edits.dir</name> <value>/zhiyou/hadoop/journal</value> </property> <!--开启NameNode故障时自动切换--> <property> <name>dfs.ha.automatic-failover.enabled</name> <value>true</value> </property> <!--配置失败自动切换的实现方式--> <property> <name>dfs.client.failover.proxy.provider.ns</name> <value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value> </property> <!--配置隔离机制--> <property> <name>dfs.ha.fencing.methods</name> <value>sshfence</value> </property> <!--设置免密登录--> <property> <name>dfs.ha.fencing.ssh.private-key-files</name> <value>/root/.ssh/id_rsa</value> </property> <!--设置name和data的存储目录--> <property> <name>dfs.namenode.name.dir</name> <value>file:///zhiyou/hadoop/hdfs/name</value> </property> <property> <name>dfs.datanode.data.dir</name> <value>file:///zhiyou/hadoop/hdfs/data</value> </property> <property> <name>dfs.replication</name> <value>3</value> </property> <!--在NN和DN上开启WebHDFS(rest API)功能,不是必须--> <property> <name>dfs.webhdfs.enabled</name> <value>true</value> </property> </configuration>

标签:过程 -- .data 文件 provider apach .com eth http通信

原文地址:https://www.cnblogs.com/han-guang-xue/p/9916368.html