标签:感知器 梯度 神经网络 bubuko 计算 gis 算法 dac 工程

一、神经网络

1.为了进行梯度下降,误差函数不能是离散的,而必须是连续的。误差函数必须是可微分的。同时,要将离散预测变成连续预测,方法是将激活函数从阶跃函数变成S函数。

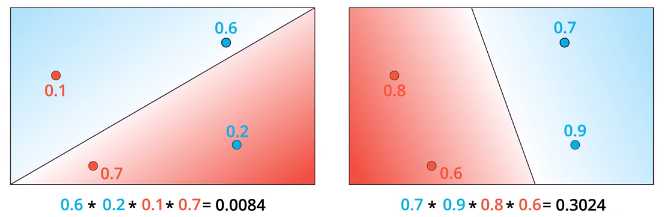

2.最大似然法:选出实际发生的情况所对应的概率更大的模型。

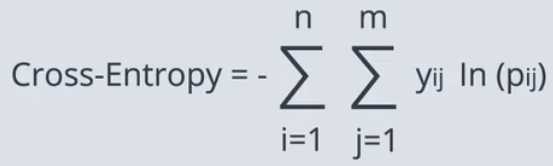

3.交叉熵(损失函数):将得到的概率取对数,对它们的相反数进行求和。准确的模型得到较低的交叉熵。

交叉熵可以告诉我们两个向量是相似还是不同。

4.Logistic回归(对数几率回归)

机器学习中最热门和最有用的算法之一,也是所有机器学习的基石。基本上是这样的:

1)获得数据;

2)选择一个随机模型;

3)计算误差;

4)最小化误差,获得更好的模型;

5)完成!

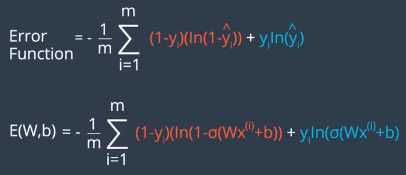

计算误差函数:

5.感知器算法和对数概率很相似,分类错误的点都会告诉直线靠近点,不同的是对于分类正确的点,感知器算法会说什么也不要做,而对数概率会说远离它。

标签:感知器 梯度 神经网络 bubuko 计算 gis 算法 dac 工程

原文地址:https://www.cnblogs.com/paulonetwo/p/10022870.html