标签:sde pac 操作 一起 strip 获得 挂载点 seve 方案

理论部分一:GlusterFS概述

1.1:Glusterfs简介

?? GlusterFS是Scale-Out存储解决方案Gluster的核心,它是一个开源的分布式文件系统,具有强大的横向扩展能力,通过扩展能够支持数PB存储容量和处理数千客户端。GlusterFS借助TCP/IP或InfiniBandRDMA网络将物理分布的存储资源聚集在一起,使用单一全局命名空间来管理数据。

1.2:Glusterfs特点

1:扩展性和高性能

?? ??GlusterFS利用双重特性来提供几TB至数PB的高扩展存储解决方案。Scale-Out架构允许通过简单地增加资源来提高存储容量和性能,磁盘、计算和I/O资源都可以独立增加,支持10GbE和InfiniBand等高速网络互联。Gluster弹性哈希(ElasticHash)解除了GlusterFS对元数据服务器的需求,消除了单点故障和性能瓶颈,真正实现了并行化数据访问。

??

2:高可用性

??? ?GlusterFS可以对文件进行自动复制,如镜像或多次复制,从而确保数据总是可以访问,甚至是在硬件故障的情况下也能正常访问。自我修复功能能够把数据恢复到正确的状态,而且修复是以增量的方式在后台执行,几乎不会产生性能负载。GlusterFS没有设计自己的私有数据文件格式,而是采用操作系统中主流标准的磁盘文件系统(如EXT3、ZFS)来存储文件,因此数据可以使用各种标准工具进行复制和访问。

3:弹性卷管理

???? 数据储存在逻辑卷中,逻辑卷可以从虚拟化的物理存储池进行独立逻辑划分而得到。存储服务器可以在线进行增加和移除,不会导致应用中断。逻辑卷可以在所有配置服务器中增长和缩减,可以在不同服务器迁移进行容量均衡,或者增加和移除系统,这些操作都可在线进行。文件系统配置更改也可以实时在线进行并应用,从而可以适应工作负载条件变化或在线性能调优。

4:全局统一命名空间

全局统一命名空间将所有的存储资源聚集成一个单一的虚拟存储池,对用户和应用屏蔽了物理存储信息。存储可以根据生产环境中的需要进行弹性扩展或收缩,在多节点场景中,全局同意明明还可以给予不同节点做负载均衡,大大提高存取效率。

1.3:术语简介

GlusterFS:是一个开源的分布式文件系统。

Brick:GFS中的存储单元,通过是一个受信存储池中的服务器的一个导出目录。可以通过主机名和目录名来标识,如‘SERVER:EXPORT‘

Client:挂载了GFS卷的设备

FUSE:Filesystem Userspace是一个可加载的内核模块,其支持非特权用户创建自己的文件系统而不需要修改内核代码。通过在用户空间运行文件系统的代码通过FUSE代码与内核进行桥接。

Node:一个拥有若干brick的设备

Volume:一组bricks的逻辑集合

Metadata:元数据,关于数据的数据,用于描述文件、目录等的信息。

VFS:内核空间对用户空间提供的访问磁盘的接口

二:GFS的工作原理

2.1:GFS的工作流程

(1)客户端或应用程序通过GFS的挂载点访问数据

(2)Linux系统内核通过VFS API收到请求并处理

(3)VFS将数据递交给FUSE内核文件系统,并向系统注册一个实际的文件系统FUSE,而FUSE文件系统则是将数据通过/dev。Fuse设备文件递交给了GFS的client段。可以将FUSE文件系统理解为一个代理。

(4)GFS client收到数据后,client根据配置文件对数据进行处理

(5)经过GFS client处理后,通过网络将数据传递至远端的GFS Server,并且将数据写入服务器存储设备。

2.2:弹性HASH算法

GlusterFS目前使用Davies-Meyer算法计算文件名hash值,获得一个32位整数。Davies-Meyer算法具有非常好的hash分布性,计算效率很高,假设逻辑卷中的存储单元Brick有N个,则32位整数空间被平均划分为N个连续子空间,每个空间分别映射到一个存储单元Brick,计算得到的32位hash值就会被投射到一个存储单元Brick。

三:GlusterFS的卷类型

3.1:卷的类型

1:基本卷:

(1)? distribute volume:分布式卷

文件通过hash算法分布到所有brick server上,这种卷是glusterfs的基础和最大特点;实只是扩大的磁盘空间,如果有一个磁盘坏了,对应的数据也丢失,文件级RAID 0,不具有容错能力。

(2)? stripe volume:条带卷

类似RAID0,文件分成数据块以Round Robin方式分布到brick server上,并发粒度是数据块,支持超大文件,大文件性能高;

(3)? replica volume:复制卷

文件同步复制到多个brick上,文件级RAID 1,具有容错能力,写性能下降,读性能提升。

2:复合卷:

(4)? distribute stripe volume:分布式条带卷

brickserver数量是条带数的倍数,兼具distribute和stripe卷的特点;

(5)? distribute replica volume:分布式复制卷

brickserver数量是镜像数的倍数,兼具distribute和replica卷的特点,可以在2个或多个节点之间复制数据。

(6) stripe replica volume:条带复制卷

类似RAID 10

同时具有条带卷和复制卷的特点

(7) distribute stripe replicavolume:分布式条带复制卷

三种基本卷的复合卷

通常用于类Map Reduce应用

一:GlusterFS部署

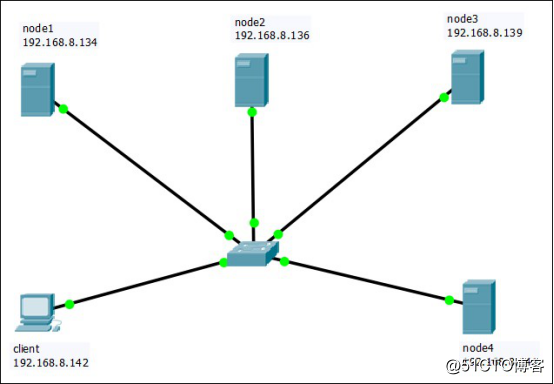

1.1:部署群集环境

实验top

1:准备环境(以node1为例,其他节点步骤略,请自行配置)

(1)按照表中所示,为node节点添加相应数量和大小的磁盘,并重启系统

(2)为所有节点的新磁盘分区

用fdisk命令为每个磁盘分区,分区步骤略

[root@localhost ~]# fdisk /dev/sdb

[root@localhost ~]# fdisk /dev/sdc

[root@localhost ~]# fdisk /dev/sdd

[root@localhost ~]# fdisk /dev/sde

(2)为每个节点的每个磁盘格式化

[root@localhost ~]# mkfs -t ext4 /dev/sdb1

[root@localhost ~]# mkfs -t ext4 /dev/sdc1

[root@localhost ~]# mkfs -t ext4 /dev/sdd1

[root@localhost ~]# mkfs -t ext4 /dev/sde1

(3)创建挂载点

[root@localhost ~]# mkdir /b3

[root@localhost ~]# mkdir /c4

[root@localhost ~]# mkdir /d5

[root@localhost ~]# mkdir /e6

(4)挂载磁盘

[root@localhost ~]# mount /dev/sdb1 /b3

[root@localhost ~]# mount /dev/sdc1 /c4

[root@localhost ~]# mount /dev/sdd1 /d5

[root@localhost ~]# mount /dev/sde1 /e6

(5)修改fstab文件,使挂载永久生效

[root@localhost ~]# vi /etc/fstab

在末尾添加

/dev/sdb1 /b3 ext4 defaults 0 0

/dev/sdc1 /c4 ext4 defaults 0 0

/dev/sdd1 /d5 ext4 defaults 0 0

/dev/sde1 /e6 ext4 defaults 0 0

2:在所有节点上关闭防火墙和selinux

[root@localhost ~]# systemctl stop firewalld

[root@localhost ~]# setenforce 0

3:在所有节点上修改hosts文件

[root@localhost ~]# vi /etc/hosts

192.168.8.134 node1

192.168.8.136 node2

192.168.8.139 node3

192.168.8.141 node4

4:在所有节点安装软件

(1)配置yum仓库

将GFS所需的rpm仓库的gfsrepo目录拷贝到linux系统的/opt下,并修改仓库文件

[root@localhost ~]# vi /etc/yum.repos.d/CentOS-Media.repo

[c7-media]

name=CentOS-$releasever - Media

baseurl=file:///media/cdrom/

gpgcheck=1

enabled=1

gpgkey=file:///etc/pki/rpm-gpg/RPM-GPG-KEY-CentOS-7

[gfsrepo]

name=GFS

baseurl=file:///opt/gfsrepo

gpgcheck=0

enabled=1

[root@localhost ~]# yum clean all

(2)在所有节点上安装gfs

[root@localhost ~]# yum -y install glusterfs glusterfs-server glusterfs-fuse glusterfs-rdma

5:在所有节点上启动GFS

[root@localhost ~]# systemctl start glusterd.service

[root@localhost ~]# systemctl enable glusterd.service

6:添加节点(只在node1节点上)

[root@localhost ~]# gluster peer probe node1

peer probe: success. Probe on localhost not needed

[root@localhost ~]# gluster peer probe node2

peer probe: success.

[root@localhost ~]# gluster peer probe node3

peer probe: success.

[root@localhost ~]# gluster peer probe node4

peer probe: success.

7:在每个节点上查看状态

[root@localhost ~]# gluster peer status

Number of Peers: 3

Hostname: node2

Uuid: 469be571-b52a-4a89-a30a-c3a770753b0e

State: Peer in Cluster (Connected)

Hostname: node3

Uuid: 24742939-afc6-4243-a8a8-1aa57a336128

State: Peer in Cluster (Connected)

Hostname: node4

Uuid: dbc703a3-1e22-42cd-bedf-da3541bce983

State: Peer in Cluster (Connected)

1.2:创建卷

1:创建分布式卷(在node1上)

[root@localhost ~]# gluster volume create dis-volume node1:/e6 node2:/e6 force

[root@localhost ~]# gluster volume info dis-volume

Volume Name: dis-volume

Type: Distribute

Volume ID: 40946bd8-cc79-406a-be3c-5c03dd2a207e

Status: Created

Snapshot Count: 0

Number of Bricks: 2

Transport-type: tcp

Bricks:

Brick1: node1:/e6

Brick2: node2:/e6

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

[root@localhost ~]# gluster volume start dis-volume

2:创建条带卷

[root@localhost ~]# gluster volume create stripe-volume stripe 2 node1:/d5 node2:/d5 force

[root@localhost ~]# gluster volume info stripe-volume

Volume Name: stripe-volume

Type: Stripe

Volume ID: d8e335d5-47d5-484f-804b-bb36ed522bf6

Status: Created

Snapshot Count: 0

Number of Bricks: 1 x 2 = 2

Transport-type: tcp

Bricks:

Brick1: node1:/d5

Brick2: node2:/d5

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

[root@localhost ~]# gluster volume start stripe-volume

3:创建复制卷

[root@localhost ~]# gluster volume create rep-volume replica 2 node3:/d5 node4:/d5 force

[root@localhost ~]# gluster volume info rep-volume

Volume Name: rep-volume

Type: Replicate

Volume ID: b5d1afda-ab03-47a7-82b9-2786648a9b3a

Status: Created

Snapshot Count: 0

Number of Bricks: 1 x 2 = 2

Transport-type: tcp

Bricks:

Brick1: node3:/d5

Brick2: node4:/d5

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

[root@localhost ~]# gluster volume start rep-volume

4:创建分布式条带卷

[root@localhost ~]# gluster volume create dis-stripe stripe 2 node1:/b3 node2:/b3 node3:/b3 node4:/b3 force

[root@localhost ~]# gluster volume info dis-stripe

Volume Name: dis-stripe

Type: Distributed-Stripe

Volume ID: ff516167-7840-485a-8d3a-1630bd4d174d

Status: Created

Snapshot Count: 0

Number of Bricks: 2 x 2 = 4

Transport-type: tcp

Bricks:

Brick1: node1:/b3

Brick2: node2:/b3

Brick3: node3:/b3

Brick4: node4:/b3

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

[root@localhost ~]# gluster volume start dis-stripe

5:创建分布式复制卷

[root@localhost ~]# gluster volume create dis-rep replica 2 node1:/c4 node2:/c4 node3:/c4 node4:/c4 force

[root@localhost ~]# gluster volume info dis-rep

Volume Name: dis-rep

Type: Distributed-Replicate

Volume ID: 197055f7-37d8-419f-bb22-9f05c7e1a032

Status: Created

Snapshot Count: 0

Number of Bricks: 2 x 2 = 4

Transport-type: tcp

Bricks:

Brick1: node1:/c4

Brick2: node2:/c4

Brick3: node3:/c4

Brick4: node4:/c4

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

[root@localhost ~]# gluster volume start dis-rep

1.3:部署GFS客户端

1:安装客户端软件

[root@localhost ~]# systemctl stop firewalld

[root@localhost ~]# setenforce 0

[root@localhost ~]# systemctl disable firewalld

[root@localhost ~]# yum -y install glusterfs glusterfs-fuse

2:创建挂载目录

[root@localhost ~]# mkdir -p /test/{dis,stripe,rep,dis_and_stripe,dis_adn_rep}

[root@localhost ~]# ls /test

dis dis_and_stripe dis_rep rep stripe

3:修改hosts文件

[root@localhost ~]# vi /etc/hosts

192.168.8.134 node1

192.168.8.136 node2

192.168.8.139 node3

192.168.8.141 node4

4:挂载Gluster文件系统

[root@localhost ~]# mount -t glusterfs node1:dis-volume /test/dis

[root@localhost ~]# mount -t glusterfs node1:stripe-volume /test/stripe/

[root@localhost ~]# mount -t glusterfs node1:rep-volume /test/rep

[root@localhost ~]# mount -t glusterfs node1:dis-stripe /test/dis_and_stripe/

[root@localhost ~]# mount -t glusterfs node1:dis-rep /test/dis_and_rep/

[root@localhost ~]# df -h

文件系统 容量 已用 可用 已用% 挂载点

/dev/mapper/cl-root 95G 4.0G 91G 5% /

devtmpfs 473M 0 473M 0% /dev

tmpfs 489M 144K 489M 1% /dev/shm

tmpfs 489M 7.1M 482M 2% /run

tmpfs 489M 0 489M 0% /sys/fs/cgroup

/dev/sda1 1014M 173M 842M 18% /boot

tmpfs 98M 12K 98M 1% /run/user/0

/dev/sr0 4.1G 4.1G 0 100% /media/cdrom

node1:dis-volume 12G 49M 11G 1% /test/dis

node1:rep-volume 4.8G 21M 4.6G 1% /test/rep

node1:dis-stripe 12G 37M 11G 1% /test/dis_and_stripe

node1:dis-rep 7.8G 33M 7.3G 1% /test/dis_and_rep

node1:stripe-volume 9.6G 41M 9.1G 1% /test/stripe

5:修改fstab配置文件

[root@localhost ~]# vi /etc/fstab

在末尾添加:

node1:dis-volume /test/dis glusterfs defaules,_netdev 0 0

node1:stripe-volume /test/stripe glusterfs defaules,_netdev 0 0

node1:rep-volume /test/rep glusterfs defaules,_netdev 0 0

node1:dis-stripe /test/dis_and_stripe glusterfs defaules,_netdev 0 0

node1:dis-rep /test/dis_and_rep glusterfs defaules,_netdev 0 0

1.4:在客户端测试Gluster文件系统

1:在卷中写入文件

(1)创建测试文件

[root@localhost ~]# dd if=/dev/zero of=/root/demo1.log bs=1M count=43

[root@localhost ~]# dd if=/dev/zero of=/root/demo2.log bs=1M count=43

[root@localhost ~]# dd if=/dev/zero of=/root/demo3.log bs=1M count=43

[root@localhost ~]# dd if=/dev/zero of=/root/demo4.log bs=1M count=43

[root@localhost ~]# dd if=/dev/zero of=/root/demo5.log bs=1M count=43

(2)卷中写入文件

[root@localhost ~]# cp demo /test/dis/

[root@localhost ~]# cp demo /test/stripe/

[root@localhost ~]# cp demo /test/rep/

[root@localhost ~]# cp demo /test/dis_and_stripe/

[root@localhost ~]# cp demo* /test/dis_and_rep/

2:查看文件分布

(1)在node1和node2中查看分布式卷文件分布

node1:

[root@localhost ~]# ll -h /e6

总用量 173M

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo1.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo2.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo3.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo4.log

node2:

[root@localhost ~]# ll -h /e6

总用量 44M

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo5.log

(2)在node1和node2中查看条带卷文件分布

node1:

[root@localhost ~]# ll -h /d5

总用量 108M

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo1.log

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo2.log

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo3.log

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo4.log

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo5.log

node2:

[root@localhost ~]# ll -h /d5

总用量 108M

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo1.log

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo2.log

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo3.log

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo4.log

-rw-r--r--. 2 root root 22M 4月 17 22:06 demo5.log

(3)在node3和node4中查看复制卷文件分布

node3:

[root@localhost ~]# ll -h /d5

总用量 216M

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo1.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo2.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo3.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo4.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo5.log

node4:

[root@localhost ~]# ll -h /d5

总用量 216M

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo1.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo2.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo3.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo4.log

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo5.log

(4)在node1、node2、node3、node4中查看分布式条带文件分布

node1:

[root@localhost ~]# ll -h /b3

总用量 87M

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo1.log

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo2.log

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo3.log

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo4.log

node2:

[root@localhost ~]# ll -h /b3

总用量 87M

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo1.log

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo2.log

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo3.log

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo4.log

node3:

[root@localhost ~]# ll -h /b3

总用量 22M

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo5.log

node4:

[root@localhost ~]# ll -h /b3

总用量 22M

-rw-r--r--. 2 root root 22M 4月 17 22:07 demo5.log

(5)在node1、node2、node3、node4中查看分布式复制卷文件分布

node1:

[root@localhost ~]# ll -h /c4

总用量 173M

-rw-r--r--. 2 root root 43M 4月 17 22:06 demo1.log

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo2.log

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo3.log

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo4.log

node2:

[root@localhost ~]# ll -h /c4

总用量 173M

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo1.log

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo2.log

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo3.log

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo4.log

node3:

[root@localhost ~]# ll -h /c4

总用量 44M

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo5.log

node4:

[root@localhost ~]# ll -h /c4

总用量 44M

-rw-r--r--. 2 root root 43M 4月 17 22:07 demo5.log

3:破坏性测试

(1)挂起node2节点,在客户端上测试各个文件是否可以正常使用

(2)再挂起node4,在客户端继续测试各个文件的读取

1.5:其他维护命令

1:查看GFS卷

[root@localhost ~]# gluster volume list

dis-rep

dis-stripe

dis-volume

rep-volume

stripe-volume

[root@localhost ~]# gluster volume info

Volume Name: dis-rep

Type: Distributed-Replicate

Volume ID: 197055f7-37d8-419f-bb22-9f05c7e1a032

Status: Started

Snapshot Count: 0

Number of Bricks: 2 x 2 = 4

Transport-type: tcp

Bricks:

Brick1: node1:/c4

Brick2: node2:/c4

Brick3: node3:/c4

Brick4: node4:/c4

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

Volume Name: dis-stripe

Type: Distributed-Stripe

Volume ID: ff516167-7840-485a-8d3a-1630bd4d174d

Status: Started

Snapshot Count: 0

Number of Bricks: 2 x 2 = 4

Transport-type: tcp

Bricks:

Brick1: node1:/b3

Brick2: node2:/b3

Brick3: node3:/b3

Brick4: node4:/b3

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

Volume Name: dis-volume

Type: Distribute

Volume ID: 40946bd8-cc79-406a-be3c-5c03dd2a207e

Status: Started

Snapshot Count: 0

Number of Bricks: 2

Transport-type: tcp

Bricks:

Brick1: node1:/e6

Brick2: node2:/e6

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

Volume Name: rep-volume

Type: Replicate

Volume ID: b5d1afda-ab03-47a7-82b9-2786648a9b3a

Status: Started

Snapshot Count: 0

Number of Bricks: 1 x 2 = 2

Transport-type: tcp

Bricks:

Brick1: node3:/d5

Brick2: node4:/d5

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

Volume Name: stripe-volume

Type: Stripe

Volume ID: d8e335d5-47d5-484f-804b-bb36ed522bf6

Status: Started

Snapshot Count: 0

Number of Bricks: 1 x 2 = 2

Transport-type: tcp

Bricks:

Brick1: node1:/d5

Brick2: node2:/d5

Options Reconfigured:

transport.address-family: inet

nfs.disable: on

Brick node1:/c4 49154 0 Y 5233

Brick node2:/c4 49154 0 Y 4695

Self-heal Daemon on localhost N/A N/A Y 5253

Self-heal Daemon on node2 N/A N/A Y 4723

There are no active volume tasks

Brick node1:/b3 49153 0 Y 5133

Brick node2:/b3 49153 0 Y 4645

There are no active volume tasks

Brick node1:/e6 49152 0 Y 4775

Brick node2:/e6 49152 0 Y 4509

There are no active volume tasks

Self-heal Daemon on localhost N/A N/A Y 5253

Self-heal Daemon on node2 N/A N/A Y 4723

There are no active volume tasks

Brick node1:/d5 49155 0 Y 5468

Brick node2:/d5 49155 0 Y 40580

There are no active volume tasks

2:停止删除卷

[root@localhost ~]# gluster volume stop dis-stripe

Stopping volume will make its data inaccessible. Do you want to continue? (y/n) y

volume stop: dis-stripe: success

[root@localhost ~]# gluster volume delete dis-stripe

Deleting volume will erase all information about the volume. Do you want to continue? (y/n) y

volume delete: dis-stripe: failed: Some of the peers are down

3:设置卷的访问控制

[root@localhost ~]# gluster volume set dis-rep auth.allow 192.168.1.,10.1.1.

volume set: success

标签:sde pac 操作 一起 strip 获得 挂载点 seve 方案

原文地址:https://blog.51cto.com/72756/2366635