标签:分词 ast txt lines gen size filename tps 产生

词向量训练步骤:

项目完整地址:https://github.com/cyandn/practice/tree/master/Word2Vec

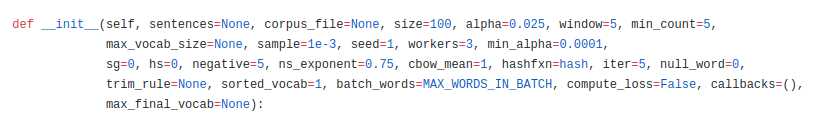

gensim中Word2Vec参数解释:

主要参数介绍如下:

存在的问题:

感觉 stop_words.txt 停用词去的有点狠。。

标签:分词 ast txt lines gen size filename tps 产生

原文地址:https://www.cnblogs.com/cyandn/p/11186447.html