标签:文件 https key red pre mapr keygen shuf 相同

采用apache官网下载地址进行下载

apache索引目录 Index of /dist

此处使用了 hadoop-3.1.2.tar.gz

共3台机器

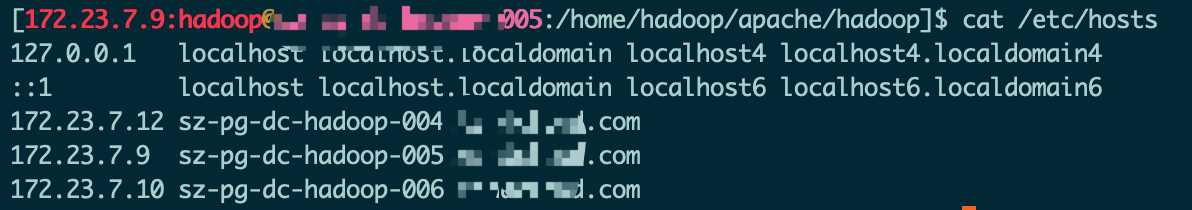

172.23.7.9

172.23.7.10

172.23.7.12

在每台机器使用hostname命令,查看机器命名

在每台机器上hosts配置文件

vim /etc/hosts

ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsacat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 0600 ~/.ssh/authorized_keys需要修改的 如果有注释 就打开注释

RSAAuthentication yes

PubkeyAuthentication yes #这两项为打开公钥模式

AuthorizedKeysFile .ssh/authorized_keys #配置公钥记录文件

PasswordAuthentication yes #打开密码验证模式ssh [hostname]ssh_exchange_identification: read: Connection reset by peer# root权限

vim /etc/hosts.allow

# 追加

sshd: 172.23.*

# 重启ssh

service sshd restart选取172.23.7.9 为namenode,剩余两个节点为datanode

#jdk绝对路径环境 因为要远程调用 ${java_home}找不到变量

export JAVA_HOME=/usr/java/jdk1.8.0_141<configuration>

<!-- 修改defaultFS为hadoop1-->

<property>

<name>fs.defaultFS</name>

<value>hdfs://[namenode机器hostname]:9000</value>

</property>

<!-- 修改了临时文件存放位置-->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/apache/hadoop/tmp</value>

</property>

</configuration><configuration>

<!-- 将备份数修改为3,小于等于当前datanode数目即可-->

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<!-- 将secondary namenode改为hadoop2-->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>[一台非namenode机器hostname]:50090</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file://${hadoop.tmp.dir}/dfs/name</value>

</property>

<property>

<name>dfs.namenode.data.dir</name>

<value>file://${hadoop.tmp.dir}/dfs/data</value>

</property>

<property>

<name>dfs.permissions.enabled</name>

<value>false</value>

</property>

</configuration><configuration>

<!-- 添加了yarn.resourcemanager.hostname 属性-->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop1</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 添加了yarn.nodemanager.auxservices.mapreduce.shuffle.class属性-->

<property>

<name>yarn.nodemanager.auxservices.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

</configuration>[datanode1即172.23.7.10 的hostname]

[datanode1即172.23.7.12 的hostname]其他节点配置相同

路径:~/hadoop-3.1.2/bin

./hdfs namenode -format

如出现以下异常

java.lang.UnsupportedClassVersionError

检查jdk版本,并配置对应版本

J2SE 8 = 52 (0x34 hex),

J2SE 7 = 51 (0x33 hex),

J2SE 6.0 = 50 (0x32 hex),

J2SE 5.0 = 49 (0x31 hex),

JDK 1.4 = 48 (0x30 hex),

JDK 1.3 = 47 (0x2F hex),

JDK 1.2 = 46 (0x2E hex),

JDK 1.1 = 45 (0x2D hex).路径:~/hadoop-3.1.2/sbin

./start-dfs.sh

./start-yarn.sh3.1 每个节点查看进程:

jps

3.2 登录管理页面

http://[namenode的IP]:9870

标签:文件 https key red pre mapr keygen shuf 相同

原文地址:https://www.cnblogs.com/valjeanshaw/p/11397288.html