标签:网络模式 bsp width res 深度 ima code cal image

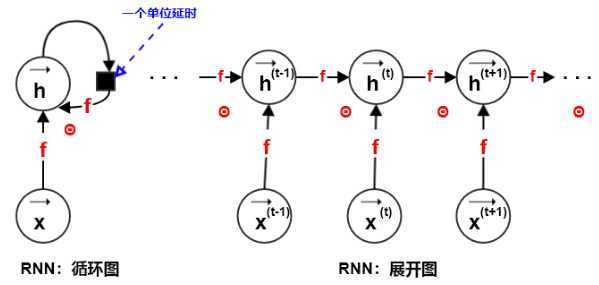

(1)假设$x^{(t)}$为$t$时刻系统的外部驱动信号,则动态系统的状态为$h^{(t)}=f(h^{(t-1)},x^{(t)};\theta)$

(2)当训练RNN根据过去预测未来时,网络通常要讲$h^{(t)}$作为过去序列信息的一个有损的representation,因为它使用一个固定长度的向量$h^{(t)}$来表达任意长的序列$\{x^{(1)},...,x^{(t-1)}\}$

根据不同的训练准则,representation可能会有选择地保留过去序列的某些部分,如attention机制。

(3)

(4)

标签:网络模式 bsp width res 深度 ima code cal image

原文地址:https://www.cnblogs.com/nxf-rabbit75/p/11613026.html