标签:serve dea ati 修改 ref tor red 命令行 编译

在计算机性能调试领域里,profiling 是指对应用程序的画像,画像就是应用程序使用 CPU 和内存的情况。 Go语言是一个对性能特别看重的语言,因此语言中自带了 profiling 的库,这篇文章就要讲解怎么在 golang 中做 profiling。

Go语言项目中的性能优化主要有以下几个方面:

Go语言内置了获取程序的运行数据的工具,包括以下两个标准库:

runtime/pprof:采集工具型应用运行数据进行分析net/http/pprof:采集服务型应用运行时数据进行分析pprof开启后,每隔一段时间(10ms)就会收集下当前的堆栈信息,获取格格函数占用的CPU以及内存资源;最后通过对这些采样数据进行分析,形成一个性能分析报告。

注意,我们只应该在性能测试的时候才在代码中引入pprof。

如果你的应用程序是运行一段时间就结束退出类型。那么最好的办法是在应用退出的时候把 profiling 的报告保存到文件中,进行分析。对于这种情况,可以使用runtime/pprof库。 首先在代码中导入runtime/pprof工具:

import "runtime/pprof"

开启CPU性能分析:

1 pprof.StartCPUProfile(w io.Writer)

停止CPU性能分析:

1 pprof.StopCPUProfile()

应用执行结束后,就会生成一个文件,保存了我们的 CPU profiling 数据。得到采样数据之后,使用go tool pprof工具进行CPU性能分析。

记录程序的堆栈信息

1 pprof.WriteHeapProfile(w io.Writer)

得到采样数据之后,使用 go tool pprof 工具进行内存性能分析。

go tool pprof 默认是使用 -inuse_space 进行统计,还可以使用 -inuse-objects 查看分配对象的数量。

如果你的应用程序是一直运行的,比如 web 应用,那么可以使用net/http/pprof库,它能够在提供 HTTP 服务进行分析。

如果使用了默认的 http.DefaultServeMux(通常是代码直接使用 http.ListenAndServe(“0.0.0.0:8000”, nil)),只需要在你的web server端代码中按如下方式导入net/http/pprof

1 import _ "net/http/pprof"

如果你使用自定义的 Mux,则需要手动注册一些路由规则:

1 r.HandleFunc("/debug/pprof/", pprof.Index) 2 r.HandleFunc("/debug/pprof/cmdline", pprof.Cmdline) 3 r.HandleFunc("/debug/pprof/profile", pprof.Profile) 4 r.HandleFunc("/debug/pprof/symbol", pprof.Symbol) 5 r.HandleFunc("/debug/pprof/trace", pprof.Trace)

如果你使用的是gin框架,那么推荐使用"github.com/DeanThompson/ginpprof"。

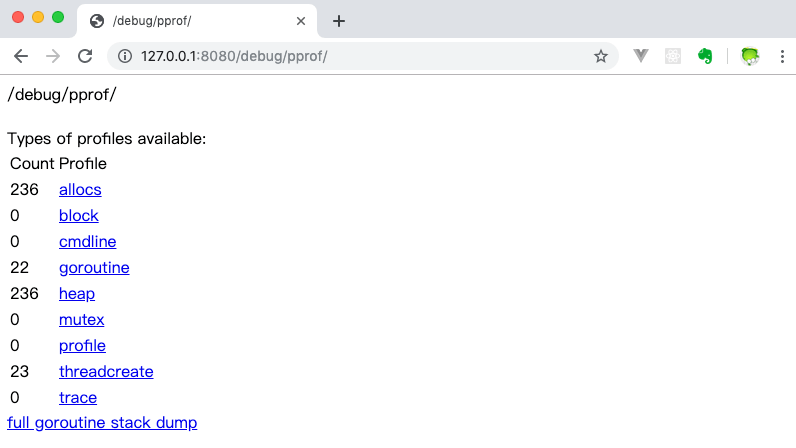

不管哪种方式,你的 HTTP 服务都会多出/debug/pprof endpoint,访问它会得到类似下面的内容:

这个路径下还有几个子页面:

不管是工具型应用还是服务型应用,我们使用相应的pprof库获取数据之后,下一步的都要对这些数据进行分析,我们可以使用go tool pprof命令行工具。

go tool pprof最简单的使用方式为:

1 go tool pprof [binary] [source]

其中:

注意事项: 获取的 Profiling 数据是动态的,要想获得有效的数据,请保证应用处于较大的负载(比如正在生成中运行的服务,或者通过其他工具模拟访问压力)。否则如果应用处于空闲状态,得到的结果可能没有任何意义。

首先我们来写一段有问题的代码:

1 // runtime_pprof/main.go 2 package main 3 4 import ( 5 "flag" 6 "fmt" 7 "os" 8 "runtime/pprof" 9 "time" 10 ) 11 12 // 一段有问题的代码 13 func logicCode() { 14 var c chan int 15 for { 16 select { 17 case v := <-c: 18 fmt.Printf("recv from chan, value:%v\n", v) 19 default: 20 21 } 22 } 23 } 24 25 func main() { 26 var isCPUPprof bool 27 var isMemPprof bool 28 29 flag.BoolVar(&isCPUPprof, "cpu", false, "turn cpu pprof on") 30 flag.BoolVar(&isMemPprof, "mem", false, "turn mem pprof on") 31 flag.Parse() 32 33 if isCPUPprof { 34 file, err := os.Create("./cpu.pprof") 35 if err != nil { 36 fmt.Printf("create cpu pprof failed, err:%v\n", err) 37 return 38 } 39 pprof.StartCPUProfile(file) 40 defer pprof.StopCPUProfile() 41 } 42 for i := 0; i < 8; i++ { 43 go logicCode() 44 } 45 time.Sleep(20 * time.Second) 46 if isMemPprof { 47 file, err := os.Create("./mem.pprof") 48 if err != nil { 49 fmt.Printf("create mem pprof failed, err:%v\n", err) 50 return 51 } 52 pprof.WriteHeapProfile(file) 53 file.Close() 54 } 55 }

通过flag我们可以在命令行控制是否开启CPU和Mem的性能分析。 将上面的代码保存并编译成runtime_pprof可执行文件,执行时加上-cpu命令行参数如下:

1 ./runtime_pprof -cpu

等待30秒后会在当前目录下生成一个cpu.pprof文件。

我们使用go工具链里的pprof来分析一下。

go tool pprof cpu.pprof

执行上面的代码会进入交互界面如下:

1 runtime_pprof $ go tool pprof cpu.pprof 2 Type: cpu 3 Time: Jun 28, 2019 at 11:28am (CST) 4 Duration: 20.13s, Total samples = 1.91mins (568.60%) 5 Entering interactive mode (type "help" for commands, "o" for options) 6 (pprof)

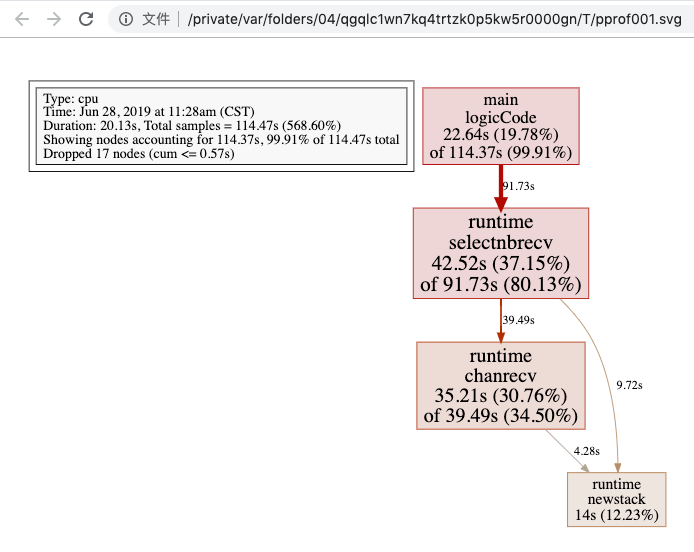

我们可以在交互界面输入top3来查看程序中占用CPU前3位的函数:

1 (pprof) top3 2 Showing nodes accounting for 100.37s, 87.68% of 114.47s total 3 Dropped 17 nodes (cum <= 0.57s) 4 Showing top 3 nodes out of 4 5 flat flat% sum% cum cum% 6 42.52s 37.15% 37.15% 91.73s 80.13% runtime.selectnbrecv 7 35.21s 30.76% 67.90% 39.49s 34.50% runtime.chanrecv 8 22.64s 19.78% 87.68% 114.37s 99.91% main.logicCode

其中:

在大多数的情况下,我们可以通过分析这五列得出一个应用程序的运行情况,并对程序进行优化。

我们还可以使用list 函数名命令查看具体的函数分析,例如执行list logicCode查看我们编写的函数的详细分析。

1 (pprof) list logicCode 2 Total: 1.91mins 3 ROUTINE ================ main.logicCode in .../runtime_pprof/main.go 4 22.64s 1.91mins (flat, cum) 99.91% of Total 5 . . 12:func logicCode() { 6 . . 13: var c chan int 7 . . 14: for { 8 . . 15: select { 9 . . 16: case v := <-c: 10 22.64s 1.91mins 17: fmt.Printf("recv from chan, value:%v\n", v) 11 . . 18: default: 12 . . 19: 13 . . 20: } 14 . . 21: } 15 . . 22:}

通过分析发现大部分CPU资源被17行占用,我们分析出select语句中的default没有内容会导致上面的case v:=<-c:一直执行。我们在default分支添加一行time.Sleep(time.Second)即可。

或者可以直接输入web,通过svg图的方式查看程序中详细的CPU占用情况。 想要查看图形化的界面首先需要安装graphviz图形化工具。

Mac:

brew install graphviz

Windows: 下载graphviz 将graphviz安装目录下的bin文件夹添加到Path环境变量中。 在终端输入dot -version查看是否安装成功。

关于图形的说明: 每个框代表一个函数,理论上框的越大表示占用的CPU资源越多。 方框之间的线条代表函数之间的调用关系。 线条上的数字表示函数调用的次数。 方框中的第一行数字表示当前函数占用CPU的百分比,第二行数字表示当前函数累计占用CPU的百分比。

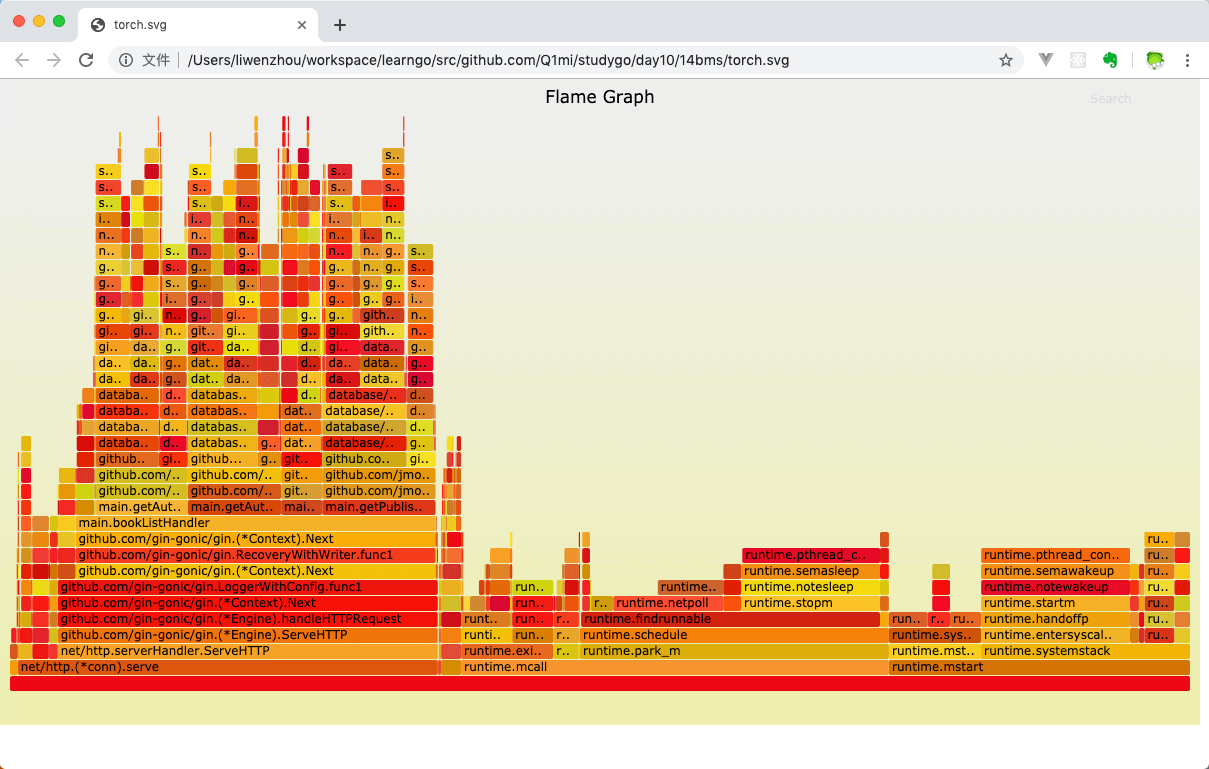

火焰图(Flame Graph)是 Bredan Gregg 创建的一种性能分析图表,因为它的样子近似 ??而得名。上面的 profiling 结果也转换成火焰图,如果对火焰图比较了解可以手动来操作,不过这里我们要介绍一个工具:go-torch。这是 uber 开源的一个工具,可以直接读取 golang profiling 数据,并生成一个火焰图的 svg 文件。

go get -v github.com/uber/go-torch

火焰图 svg 文件可以通过浏览器打开,它对于调用图的最优点是它是动态的:可以通过点击每个方块来 zoom in 分析它上面的内容。

火焰图的调用顺序从下到上,每个方块代表一个函数,它上面一层表示这个函数会调用哪些函数,方块的大小代表了占用 CPU 使用的长短。火焰图的配色并没有特殊的意义,默认的红、黄配色是为了更像火焰而已。

go-torch 工具的使用非常简单,没有任何参数的话,它会尝试从http://localhost:8080/debug/pprof/profile获取 profiling 数据。它有三个常用的参数可以调整:

要生成火焰图,需要事先安装 FlameGraph工具,这个工具的安装很简单(需要perl环境支持),只要把对应的可执行文件加入到环境变量中即可。

git clone https://github.com/brendangregg/FlameGraph.gitFlameGraph目录加入到操作系统的环境变量中。go-torch/render/flamegraph.go文件中的GenerateFlameGraph按如下方式修改,然后在go-torch目录下执行go install即可。1 // GenerateFlameGraph runs the flamegraph script to generate a flame graph SVG. func GenerateFlameGraph(graphInput []byte, args ...string) ([]byte, error) { 2 flameGraph := findInPath(flameGraphScripts) 3 if flameGraph == "" { 4 return nil, errNoPerlScript 5 } 6 if runtime.GOOS == "windows" { 7 return runScript("perl", append([]string{flameGraph}, args...), graphInput) 8 } 9 return runScript(flameGraph, args, graphInput) 10 }

推荐使用https://github.com/wg/wrk 或 https://github.com/adjust/go-wrk

使用wrk进行压测:go-wrk -n 50000 http://127.0.0.1:8080/book/list 在上面压测进行的同时,打开另一个终端执行go-torch -u http://127.0.0.1:8080 -t 30,30秒之后终端会初夏如下提示:Writing svg to torch.svg

然后我们使用浏览器打开torch.svg就能看到如下火焰图了。 火焰图的y轴表示cpu调用方法的先后,x轴表示在每个采样调用时间内,方法所占的时间百分比,越宽代表占据cpu时间越多。通过火焰图我们就可以更清楚的找出耗时长的函数调用,然后不断的修正代码,重新采样,不断优化。

火焰图的y轴表示cpu调用方法的先后,x轴表示在每个采样调用时间内,方法所占的时间百分比,越宽代表占据cpu时间越多。通过火焰图我们就可以更清楚的找出耗时长的函数调用,然后不断的修正代码,重新采样,不断优化。

go test命令有两个参数和 pprof 相关,它们分别指定生成的 CPU 和 Memory profiling 保存的文件:

我们还可以选择将pprof与性能测试相结合,比如:

比如下面执行测试的同时,也会执行 CPU profiling,并把结果保存在 cpu.prof 文件中:

1 go test -bench . -cpuprofile=cpu.prof

比如下面执行测试的同时,也会执行 Mem profiling,并把结果保存在 cpu.prof 文件中:

1 go test -bench . -memprofile=./mem.prof

需要注意的是,Profiling 一般和性能测试一起使用,这个原因在前文也提到过,只有应用在负载高的情况下 Profiling 才有意义。

标签:serve dea ati 修改 ref tor red 命令行 编译

原文地址:https://www.cnblogs.com/zhaohaiyu/p/11826011.html