标签:learn 分类 原来 判断 理解 有监督 写作 技术 入门机器学习

这篇文章是对自己早期一篇讲正则化和回归的补充。当时写作那篇文章的时候自己还刚刚入门机器学习,许多知识是理解了,但是缺少从一定的高度上的总结。结合这篇来看原来的那篇,不容易乱。

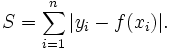

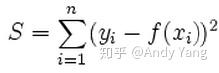

首先要明确,正则化不是回归的专利,回归和分类都是可以使用的。在回归中使用正则化就是岭回归(L2正则化)和Lasso(L1正则化),在分类中使用就是我们常见的loss function中的正则项了(其实还有一个方面的应用,知乎这位答主提到了,就是直接构造loss function,例如L1正则就构造成这样: ,L2正则就构造成这样:

,L2正则就构造成这样: ),在例如sklearn中的模型中都有对应的参数选择。

),在例如sklearn中的模型中都有对应的参数选择。

其实从某一方面来说,分类和回归的区别就体现了阈值的有无上,设置了阈值判断的回归就是分类。其实仔细想想,分类和回归问题在机器学习和深度学习上差不多是半斤八两,只是因为自己现在做的是计算机视觉的目标检测,所以对分类模型比较重视,在其他的领域,例如预测股票等等之类的场景,回归问题还是很多的,两者的区别就体现了网络结构的设计上,但是如果都是有监督学习的范畴内的话,区别真的不太大,例如这个知乎问题所说。

标签:learn 分类 原来 判断 理解 有监督 写作 技术 入门机器学习

原文地址:https://www.cnblogs.com/jiading/p/12104854.html