标签:info gre code log ESS src data 参考 模型

逻辑回归是怎么防止过拟合的?

过拟合就是参考的特征数过多,直接筛选减少就是它的做法,不过需要手动保留认为有适当意义的数据

为什么正则化可以防止过拟合?

正则化就是保留所有特征,但是降低它对对特征的识别度,就是降低特征参数(符号就不打了)

-用logiftic回归来进行实践操作

import numpy as np

from sklearn.datasets import load_breast_cancer

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

#从sklearn.datasets加载load_breast_cancer数据集,就是癌症人员的数据

data=load_breast_cancer()

#划分训练数据和测试数据 3/7分

train_data, test_data, train_target, test_target = train_test_split(data[‘data‘], data[‘target‘], test_size=0.3)

#训练模型

model=LogisticRegression().fit(train_data,train_target)

score1=model.score(train_data,train_target)#训练数据模型评价

score2=model.score(test_data,test_target)#测试数据评价

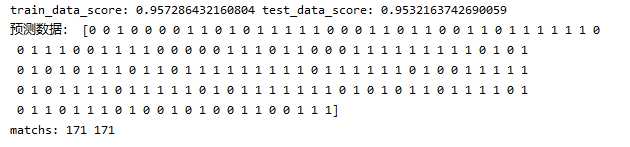

print(‘train_data_score:‘,score1,‘test_data_score:‘,score2)

#进行预测

y_pred=model.predict(test_data)

print("预测数据:",y_pred)

print(‘matchs:‘,np.equal(y_pred,test_target).shape[0],test_target.shape[0])

标签:info gre code log ESS src data 参考 模型

原文地址:https://www.cnblogs.com/zzkai/p/12787693.html