标签:参数 哪些 monit 活动 vcenter vmware stack 查找 mpls

10岁的OpenStack,已经是开源IaaS世界里的“成年人”,自从遇到开源SDN小伙伴Tungsten Fabric,两人便成为闯荡混合多云世界的好搭档。

5月26日,在TF中文社区线上直播活动【 TF Live 】中,Mirantis中国区技术工程师Frank Wu与大家进行了在线交流,并以Mirantis MCP云平台为例,演示了OpenStack与Tungsten Fabric的集成过程。

本期活动,由TF中文社区、OpenStackChina与SDNLAB合作举办。

【pdf文档下载】

https://tungstenfabric.org.cn/assets/uploads/files/tf-live3-mcp-openstack-tungsten-fabric.pdf

【直播视频回放】

https://v.qq.com/x/page/b0973v4ctgz.html

【高清视频下载】

https://pan.baidu.com/s/1_f6rZDf9utY1DJaqCm94bA

提取码:p17v

Frank在2018年加入Mirantis,曾负责Mirantis中国区大客户云环境的实施和技术支持,专注于虚拟化和容器化云平台,对于OpenStack和Tungsten Fabric都很早接触。在5月26日的直播活动中,Frank分享了对这两个技术的实践经验。

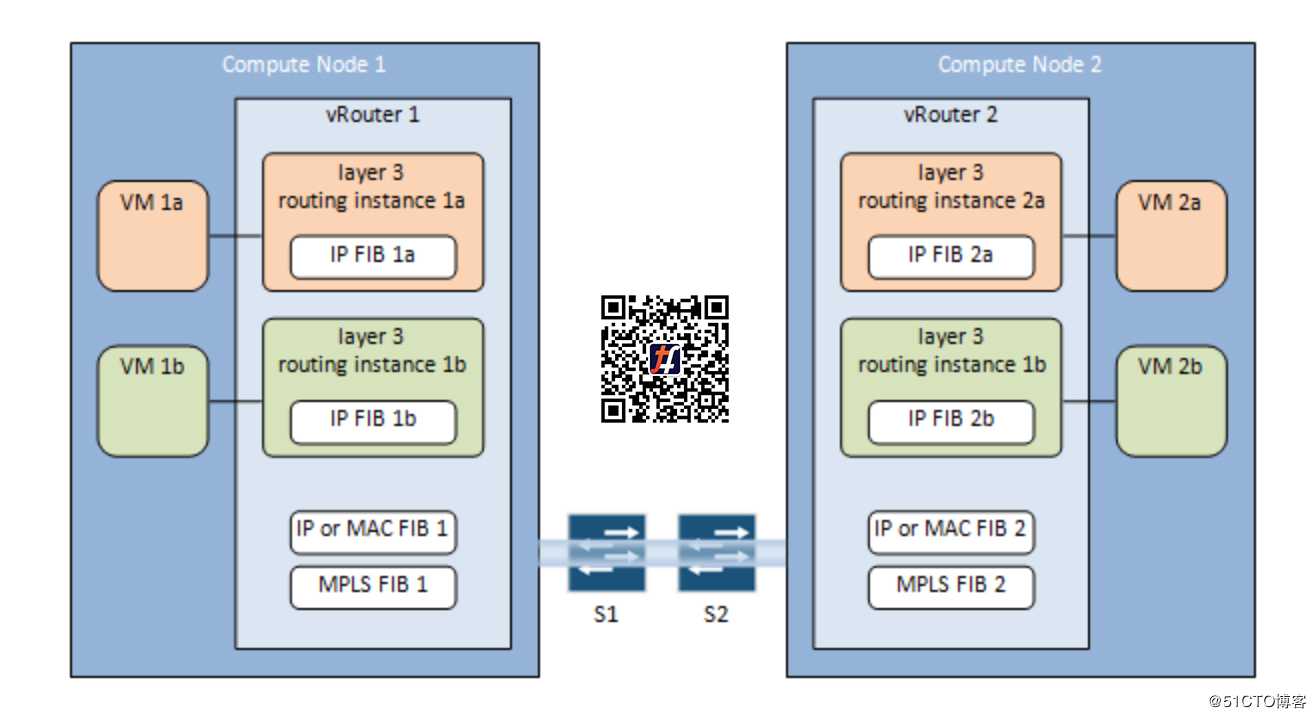

Tungsten Fabric的核心技术是基于BGP MPLS V P N技术,通过BGP协议分发路由,包括二层转发表的路由信息,同时交换V P N的信息,来实现链路隔离。通过SDN控制器和虚拟路由器,Tungsten Fabric可实现控制平面和转发平面的分离。

除了OpenStack,Tungsten Fabric还支持Kubernetes和VMware vCenter等多种编排器,也能实现多个集群的网络互联。

Tungsten Fabric支持提供虚拟网络的二层和三层隔离,以及负载均衡、服务链等功能,还支持使用Netconf来对一些物理设备进行管理。

那么,OpenStack和TF对接的数据流是怎样的呢?

首先,在OpenStack和Tungsten Fabric中,项目和用户都是一一对应的。

通过OpenStack的控制节点,配置流程去使用插件,将收到的OpenStack请求转换成对应的Tungsten Fabric的请求,发送给TF的API,这个插件作为核心插件,平时在流程的配置文件里面。

随后,vRouter通过XMPP协议接收TF控制节点下发的路由表。计算节点拿到所有虚拟机相关的信息后,分配资源,为虚拟机创建接口,将接口连接到对应虚拟网络的VRF中,这时再启动虚拟机。虚拟机通过vRouter代理的DHCP获取IP地址。

接下来,当虚拟机创建成功后,怎么进行数据通信?

我们来看OpenStack与Tungsten Fabric对接的数据转发流程。在拓扑图上,只有计算节点有租户虚拟机,才会在VRF创建routing instance,包括实例1a和2a。

流程如下:

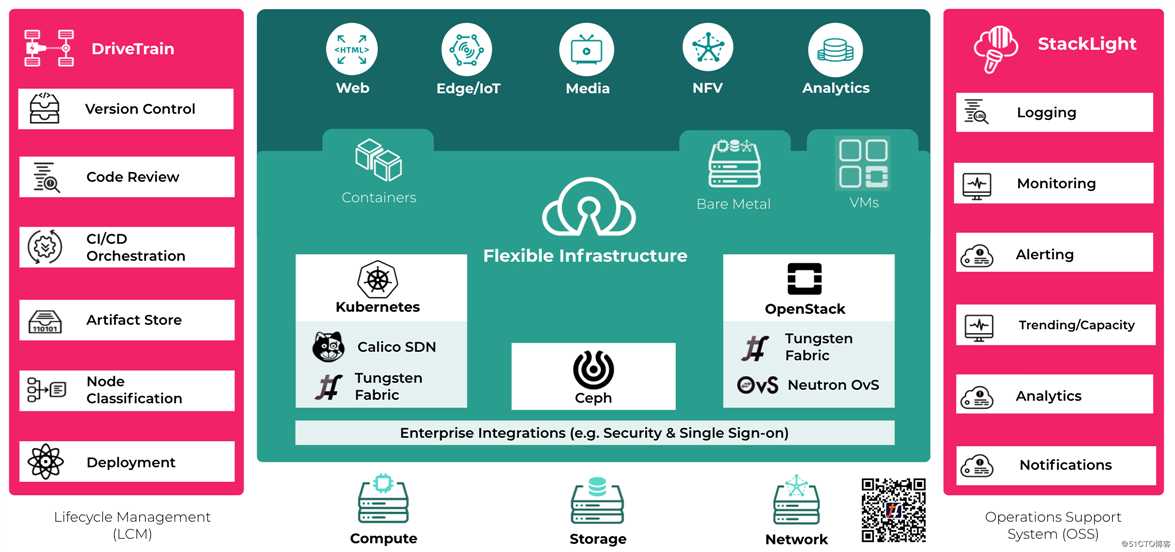

作为OpenStack社区代码贡献前五之一,Mirantis提供运行OpenStack和Kubernetes所需的所有软件、服务、培训和支持,并开发了MCP平台作为功能丰富的自动化部署工具。

MCP平台架构概览

接下来看MCP的架构。首先在云平台中,通过整合一些工具来实现整个云环境升级和运维的自动化,并且基础设施内的任何更改,如添加新节点或更改服务的监听端口,都是通过修改reclass的配置文件来完成的,实现了一种基础设施即代码的理念。

MCP同时支持选择OVS或者Tunsten Fabric来作为OpenStack的网络组件,OVS比较简单,而且不需要额外的物理网关设备,但是功能上相对于Tunsten Fabric要少一些,而Tunsten Fabric不仅有服务链,网络数据分析等功能,还是能支持多集群的SDN。

平台上还有一台OSS系统,包括日志,监控,告警等功能,都是基于成熟的开源软件来实现的。

MCP上的SDN数据流量方面,Tungsten Fabric通过建立在data网络之上的overlay网络,来处理在MCP集群中的东西向和南北向流量。

Tungsten Fabric控制器与vRouter之间的控制平面通信使用XMPP协议。当一台虚拟机在计算节点上被创建时,TF控制器会给对应的vRouter下发该虚拟机所在虚拟网络的转发表。

Tungsten Fabric控制器与网关之间的控制通信使用iBGP协议,将带有ASN和target的虚拟网络的路由发布到网关路由器上。相当于建立了虚拟网络和网关路由器vrf的映射关系,并且通过ibgp协议来维护这种关系,实时的更新,下发路由表。

在MCP集群中,一个最小的OpenStack + Tungsten Fabric生产环境的部署,需要至少3台物理机作为KVM节点来实现服务的高可用,运行虚拟控制平面所有的虚拟机,以及2-3台物理机作为OpenStack计算节点。

在demo演示环节,Frank详细介绍了基础环境和部署流程:

部署流程完成后,Frank针对这个环境中的OpenStack和Tungsten Fabric的基本网络功能,以及“负载均衡即服务”功能进行了演示。

OpenStack最初的负载均衡功能是跟neutron结合到一起,后来从neutron剥离出来,以达到更好的功能。

在OpenStack和Tungsten Fabric对接后,负载均衡由Tungsten Fabric接管,在服务链里看到HAproxy-loadbalance-template模板,配置左侧和右侧接口,左侧VIP和监听器,右侧后端服务节点,后端需要配置两块网卡,增加了复杂性。在2.0版本上,支持同一侧配置,在同一个子网内。

当我们使用Neutron LBaaS命令去创建虚拟IP和池的时候,Tungsten Fabric通过插件监听到相关的请求,进而去创建一个服务实例。然后调度器将随机选择一台计算节点,并在上面实例化一个Linux网络命名空间,并在命名空间中配置HA代理。然后再选择另外一台计算节点,进行相同的操作,作为备用HA代理实例。而且由svc-monitor服务去调度vRouter事实的更新本地对应的HAproxy配置文件。

KK/建勋:多云、SDN,还有网工进化论

杨雨:Tungsten Fabric如何增强Kubernetes的网络性能

TF Live 直播回放丨Frank Wu:当OpenStack遇到Tungsten Fabric

标签:参数 哪些 monit 活动 vcenter vmware stack 查找 mpls

原文地址:https://blog.51cto.com/14638699/2499429