标签:cap 列表 fst org ble 科技 filter 版本支持 odi

Task2 数据读取与数据分析

一、数据读取

1 import pandas as pd

2 train_df = pd.read_csv(‘./train_set.csv‘, sep=‘\t‘)

首先对read_csv的函数有个清晰的认识,具体的参数的情况如下:

- filepath_or_buffer : str,pathlib。str, pathlib.Path, py._path.local.LocalPath or any object with a read() method (such as a file handle or StringIO)

- 可以是URL,可用URL类型包括:http, ftp, s3和文件。对于多文件正在准备中

- 本地文件读取实例:??/localhost/path/to/table.csv

- sep : str, default ‘,’

- 指定分隔符。如果不指定参数,则会尝试使用逗号分隔。分隔符长于一个字符并且不是‘\s+’,将使用python的语法分析器。并且忽略数据中的逗号。正则表达式例子:‘\r\t‘

- delimiter : str, default None

- 定界符,备选分隔符(如果指定该参数,则sep参数失效)

- delim_whitespace : boolean, default False.

- 指定空格(例如’ ‘或者’ ‘)是否作为分隔符使用,等效于设定sep=‘\s+‘。如果这个参数设定为Ture那么delimiter 参数失效。

- 在新版本0.18.1支持

- header : int or list of ints, default ‘infer’

- 指定行数用来作为列名,数据开始行数。如果文件中没有列名,则默认为0,否则设置为None。如果明确设定header=0 就会替换掉原来存在列名。header参数可以是一个list例如:[0,1,3],这个list表示将文件中的这些行作为列标题(意味着每一列有多个标题),介于中间的行将被忽略掉(例如本例中的2;本例中的数据1,2,4行将被作为多级标题出现,第3行数据将被丢弃,dataframe的数据从第5行开始。)。

- 注意:如果skip_blank_lines=True 那么header参数忽略注释行和空行,所以header=0表示第一行数据而不是文件的第一行。

- names : array-like, default None

- 用于结果的列名列表,如果数据文件中没有列标题行,就需要执行header=None。默认列表中不能出现重复,除非设定参数mangle_dupe_cols=True。

- index_col : int or sequence or False, default None

- 用作行索引的列编号或者列名,如果给定一个序列则有多个行索引。

- 如果文件不规则,行尾有分隔符,则可以设定index_col=False 来是的pandas不适用第一列作为行索引。

- usecols : array-like, default None

- 返回一个数据子集,该列表中的值必须可以对应到文件中的位置(数字可以对应到指定的列)或者是字符传为文件中的列名。例如:usecols有效参数可能是 [0,1,2]或者是 [‘foo’, ‘bar’, ‘baz’]。使用这个参数可以加快加载速度并降低内存消耗。

- squeeze : boolean, default False

- prefix : str, default None

- 在没有列标题时,给列添加前缀。例如:添加‘X’ 成为 X0, X1, ...

- mangle_dupe_cols : boolean, default True

- 重复的列,将‘X’...’X’表示为‘X.0’...’X.N’。如果设定为false则会将所有重名列覆盖。

- dtype : Type name or dict of column -> type, default None

- 每列数据的数据类型。例如 {‘a’: np.float64, ‘b’: np.int32}

- engine : {‘c’, ‘python’}, optional

- Parser engine to use. The C engine is faster while the python engine is currently more feature-complete.

- 使用的分析引擎。可以选择C或者是python。C引擎快但是Python引擎功能更加完备。

- converters : dict, default None

- true_values : list, default None

- Values to consider as True

- false_values : list, default None

- Values to consider as False

- skipinitialspace : boolean, default False

- 忽略分隔符后的空白(默认为False,即不忽略).

- skiprows : list-like or integer, default None

- 需要忽略的行数(从文件开始处算起),或需要跳过的行号列表(从0开始)。

- skipfooter : int, default 0

- nrows : int, default None

- na_values : scalar, str, list-like, or dict, default None

- 一组用于替换NA/NaN的值。如果传参,需要制定特定列的空值。默认为‘1.#IND’, ‘1.#QNAN’, ‘N/A’, ‘NA’, ‘NULL’, ‘NaN’, ‘nan’`.

- keep_default_na : bool, default True

- 如果指定na_values参数,并且keep_default_na=False,那么默认的NaN将被覆盖,否则添加。

- na_filter : boolean, default True

- 是否检查丢失值(空字符串或者是空值)。对于大文件来说数据集中没有空值,设定na_filter=False可以提升读取速度。

- verbose : boolean, default False

- 是否打印各种解析器的输出信息,例如:“非数值列中缺失值的数量”等。

- skip_blank_lines : boolean, default True

- 如果为True,则跳过空行;否则记为NaN。

- parse_dates : boolean or list of ints or names or list of lists or dict, default False

- boolean. True -> 解析索引

- list of ints or names. e.g. If [1, 2, 3] -> 解析1,2,3列的值作为独立的日期列;

- list of lists. e.g. If [[1, 3]] -> 合并1,3列作为一个日期列使用

- dict, e.g. {‘foo’ : [1, 3]} -> 将1,3列合并,并给合并后的列起名为"foo"

- infer_datetime_format : boolean, default False

- 如果设定为True并且parse_dates 可用,那么pandas将尝试转换为日期类型,如果可以转换,转换方法并解析。在某些情况下会快5~10倍。

- keep_date_col : boolean, default False

- 如果连接多列解析日期,则保持参与连接的列。默认为False。

- date_parser : function, default None

- 用于解析日期的函数,默认使用dateutil.parser.parser来做转换。Pandas尝试使用三种不同的方式解析,如果遇到问题则使用下一种方式。

- 使用一个或者多个arrays(由parse_dates指定)作为参数;

- 连接指定多列字符串作为一个列作为参数;

- .每行调用一次date_parser函数来解析一个或者多个字符串(由parse_dates指定)作为参数。

- dayfirst : boolean, default False

- iterator : boolean, default False

- 返回一个TextFileReader 对象,以便逐块处理文件。

- chunksize : int, default None

- compression : {‘infer’, ‘gzip’, ‘bz2’, ‘zip’, ‘xz’, None}, default ‘infer’

- 直接使用磁盘上的压缩文件。如果使用infer参数,则使用 gzip, bz2, zip或者解压文件名中以‘.gz’, ‘.bz2’, ‘.zip’, or ‘xz’这些为后缀的文件,否则不解压。如果使用zip,那么ZIP包中国必须只包含一个文件。设置为None则不解压。

- 新版本0.18.1版本支持zip和xz解压

- thousands : str, default None

- decimal : str, default ‘.’

- float_precision : string, default None

- Specifies which converter the C engine should use for floating-point values. The options are None for the ordinary converter, high for the high-precision converter, and round_trip for the round-trip converter.

- 指定

- lineterminator : str (length 1), default None

- quotechar : str (length 1), optional

- 引号,用作标识开始和解释的字符,引号内的分割符将被忽略。

- quoting : int or csv.QUOTE_* instance, default 0

- 控制csv中的引号常量。可选 QUOTE_MINIMAL (0), QUOTE_ALL (1), QUOTE_NONNUMERIC (2) or QUOTE_NONE (3)

- doublequote : boolean, default True

- 双引号,当单引号已经被定义,并且quoting 参数不是QUOTE_NONE的时候,使用双引号表示引号内的元素作为一个元素使用。

- escapechar : str (length 1), default None

- 当quoting 为QUOTE_NONE时,指定一个字符使的不受分隔符限值。

- comment : str, default None

- 标识着多余的行不被解析。如果该字符出现在行首,这一行将被全部忽略。这个参数只能是一个字符,空行(就像skip_blank_lines=True)注释行被header和skiprows忽略一样。例如如果指定comment=‘#‘ 解析‘#empty\na,b,c\n1,2,3’ 以header=0 那么返回结果将是以’a,b,c‘作为header。

- encoding : str, default None

- dialect : str or csv.Dialect instance, default None

- 如果没有指定特定的语言,如果sep大于一个字符则忽略。具体查看csv.Dialect 文档

- tupleize_cols : boolean, default False

- Leave a list of tuples on columns as is (default is to convert to a Multi Index on the columns)

- error_bad_lines : boolean, default True

- 如果一行包含太多的列,那么默认不会返回DataFrame ,如果设置成false,那么会将改行剔除(只能在C解析器下使用)。

- warn_bad_lines : boolean, default True

- 如果error_bad_lines =False,并且warn_bad_lines =True 那么所有的“bad lines”将会被输出(只能在C解析器下使用)。

- low_memory : boolean, default True

- 分块加载到内存,再低内存消耗中解析。但是可能出现类型混淆。确保类型不被混淆需要设置为False。或者使用dtype 参数指定类型。注意使用chunksize 或者iterator 参数分块读入会将整个文件读入到一个Dataframe,而忽略类型(只能在C解析器中有效)

- memory_map : boolean, default False

- 如果使用的文件在内存内,那么直接map文件使用。使用这种方式可以避免文件再次进行IO操作。

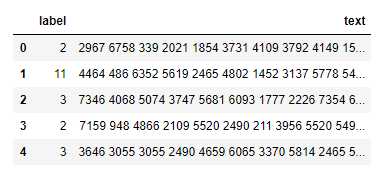

二、数据的基本展示

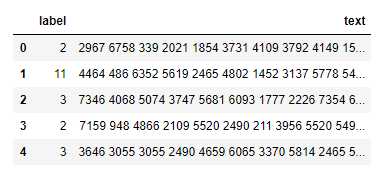

结果展示

上图是读取好的数据,是表格的形式。第一列为新闻的类别,第二列为新闻的字符

三、数据分析

虽然对于非结构数据并不需要做很多的数据分析,但通过数据分析还是可以找出一些规律的。

此步骤我们读取了所有的训练集数据,在此我们通过数据分析希望得出以下结论:

- 赛题数据中,新闻文本的长度是多少?

- 赛题数据的类别分布是怎么样的,哪些类别比较多?

- 赛题数据中,字符分布是怎么样的?

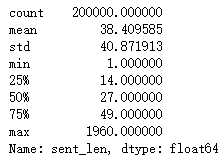

句子长度分析

1 train_df[‘text_len‘] = train_df[‘text‘].apply(lambda x: len(x.split(‘ ‘)))

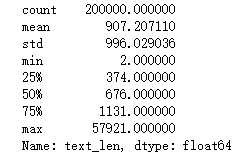

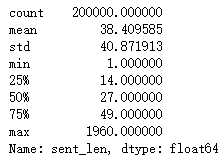

2 print(train_df[‘text_len‘].describe())

- 新增一列用于记录每个样本中句子的长度,2967是词语的标号,使用“ ”进行分割可以得到一个句子中长度

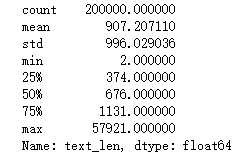

结果展示:

分析可得以下的结论:

- 样本句子的平均长度是907

- 最短的句子的长度是2

- 最长的句子的长度是57921

- 75%的句子的长度都在1100个单词左右

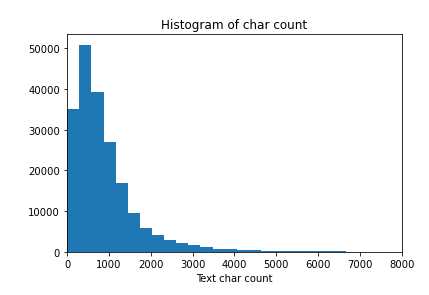

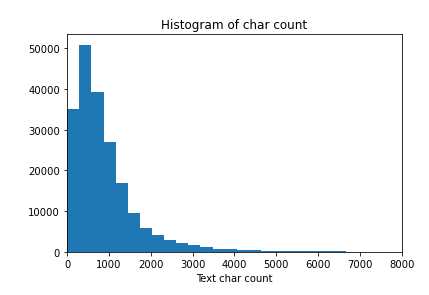

绘制直方图观察数据的句子长度分布情况

1 import matplotlib.pyplot as plt

2 _ = plt.hist(train_df[‘text_len‘], bins=200)

3 plt.xlim([0,8000])

4 plt.xlabel(‘Text char count‘)

5 plt.title("Histogram of char count")

结果展示:

大部分句子的长度都几种在2000以内

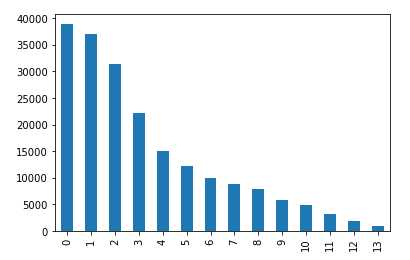

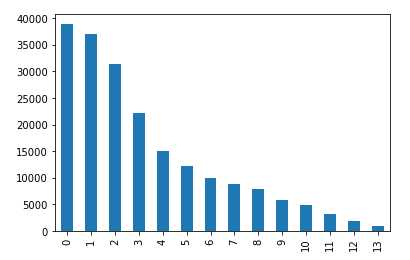

新闻类别分布

1 train_df[‘label‘].value_counts().plot(kind=‘bar‘)

直接使用pandas的plot可以直接绘制统计图像

在数据集中标签的对应的关系如下:{‘科技‘: 0, ‘股票‘: 1, ‘体育‘: 2, ‘娱乐‘: 3, ‘时政‘: 4, ‘社会‘: 5, ‘教育‘: 6, ‘财经‘: 7, ‘家居‘: 8, ‘游戏‘: 9, ‘房产‘: 10, ‘时尚‘: 11, ‘彩票‘: 12, ‘星座‘: 13}

从统计结果可以看出,赛题的数据集类别分布存在较为不均匀的情况。在训练集中科技类新闻最多,其次是股票类新闻,最少的新闻是星座新闻。

高频词汇的统计分析

1 from collections import Counter

2 # 将所有的text 整合在一起

3 all_lines = ‘ ‘.join(list(train_df[‘text‘]))

4 word_count = Counter(all_lines.split(" "))

5 word_count = sorted(word_count.items(), key=lambda d:d[1], reverse = True)

6 word_count

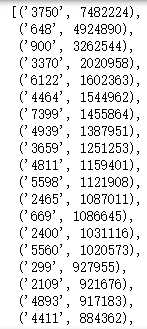

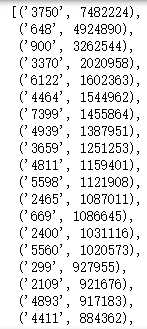

collections的Counter的方法可以对list中的词语进行统计工作,结果展示如下:

1 print(len(word_count))

2 #6869

3 print(word_count[0])

4 (‘3750‘, 7482224)

结果分析:

- 所有句子中不重复的单词总数是6869

- 词语量最多的是3750所代表的单词

词汇出现最多的文章统计分析

1 # 先将text 变成set成为unique 字符,再将所有字符用‘ ’连起来放入dataframe 新的column 里

2 train_df[‘text_unique‘] = train_df[‘text‘].apply(lambda x: ‘ ‘.join(list(set(x.split(‘ ‘)))))

3 all_lines= ‘ ‘.join(list(train_df[‘text_unique‘]))

4 word_counts= Counter(all_lines.split(‘ ‘))

5 word_counts = sorted(word_counts.items(), key=lambda d:d[1], reverse = True)

6 print(word_count[0])

7 #(‘3750‘, 197997)

8 print(word_count[1])

9 #(‘900‘, 197653)

10 print(word_count[2])

11 #(‘648‘, 191975)

思路就是先将每篇文章中的单词进行去重,然后统计词语出现的文章的数量

这里还可以根据字在每个句子的出现情况,反推出标点符号。下面代码统计了不同字符在句子中出现的次数,其中字符3750,字符900和字符648在20w新闻的覆盖率接近99%,很有可能是标点符号。

数据分析的结论

通过上述分析我们可以得出以下结论:

- 赛题中每个新闻包含的字符个数平均为1000个,还有一些新闻字符较长;

- 赛题中新闻类别分布不均匀,科技类新闻样本量接近4w,星座类新闻样本量不到1k;

- 赛题总共包括6000-7000个字符;

通过数据分析,我们还可以得出以下结论:

-

每个新闻平均字符个数较多,可能需要截断;

-

由于类别不均衡,会严重影响模型的精度;

作业

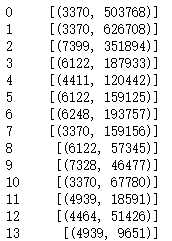

1.假设字符3750,字符900和字符648是句子的标点符号,请分析赛题每篇新闻平均由多少个句子构成?

1 train_df[‘sent_len‘] = train_df[‘text‘].apply(lambda x: len(x.split(‘ 3750 ‘)))

2 train_df[‘sent_len‘].describe()

以3750为例做代码解读:

- 新增一列用于存储使用3750进行分割后的句子的数量

- 使用3750进行分割,使用len进行数据统计

结果展示:

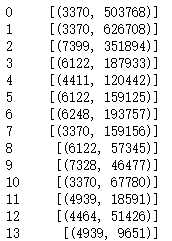

2.统计每类新闻中出现次数对多的字符

1 train_df[‘text‘] = train_df[‘text‘].apply(lambda x: x.replace(‘ 3750 ‘,‘ ‘).replace(‘ 900 ‘,‘ ‘).replace(‘ 648 ‘,‘ ‘))

2 train_df.groupby(‘label‘).text.apply(lambda x: Counter(‘ ‘.join(list(x)).split(‘ ‘)).most_common(1))

结果展示:

NLP-数据读取与数据分析

标签:cap 列表 fst org ble 科技 filter 版本支持 odi

原文地址:https://www.cnblogs.com/waws1314/p/13366273.html