标签:迁移 这一 视频 种类 mic 感知 一个 大学 接下来

https://mp.weixin.qq.com/s/zmpvOFAjTc8r8sxJbidpGQBy 超神经

场景描述:利用深度学习算法 GAN 可实现动作追踪与迁移,将某人物动作复制到其他人,应用到舞蹈领域,人人皆可成舞王。

关键词:GAN 动作迁移 舞蹈最近,《这!就是街舞》第二季开播,又一次燃起了全民热舞的风潮。

刚开播没多久,这个全程高能的节目,就在豆瓣上就得到了 9.6 的高分。舞者们在比赛中精彩的表演,让屏幕前的吃瓜群众直呼「太燃了!」「惊艳!」,甚至情不自禁跟着音乐抖起来了。

然而,真要自己跳起来,实际与想象之间,估计差了若干个罗志祥。想象中,自己是这样的:

但实际上却是这样的:

对于舞者来说,他们的动作叫做 Hiphop,Breaking,Locking 等等,而对于吃瓜群众来说,就是抖来抖去,滚来滚去,指来指去……

可能这辈子和街舞无缘?还是去跳跳广场舞吧……

等等!先别急着放弃,加州大学伯克利分校的几位大佬,为各位研究了一个 AI 「秘密武器」,让你瞬间舞技爆发,成为下一代舞王。

去年 8 月,加州大学伯克利分校的研究人员推出一篇题目为《Everybody dance now》的论文,使用深度学习算法 GAN(Generative Adversarial Networks,生成式对抗网络),可以复制专业表演者的动作,并将动作迁移到任何人身上,从而实现「Do as I do」(舞我所舞)。

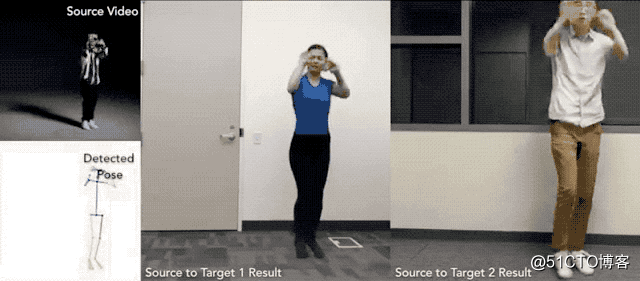

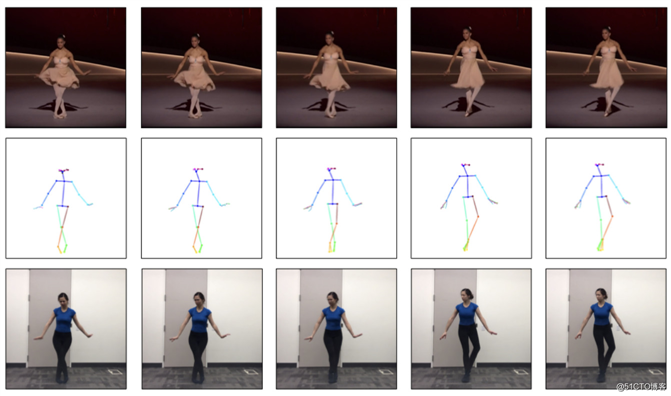

先来看复制舞蹈的结果展示,感受一下:

左上角为专业舞者,左下为检测到的姿势,中间和右边是复制到目标人物的生成视频

之前 Deepfake 换脸技术大火,现在竟然整个人都可以「Deepfake」了!我们看一下这个神操作是怎么实现的。

论文中介绍道,迁移动作方法总的分为以下步骤:

给定两个视频,一个是动作源视频,另一个是目标人物视频;

然后使用一种算法,从源视频中检测专业舞者的舞姿,并创建相应运动的火柴人框架;

最终结果是,该系统可以把专业舞者的身体动作映射到业余舞者的身上。除了模仿动作之外,它还能够完美地虚构人的声音和脸部表情。

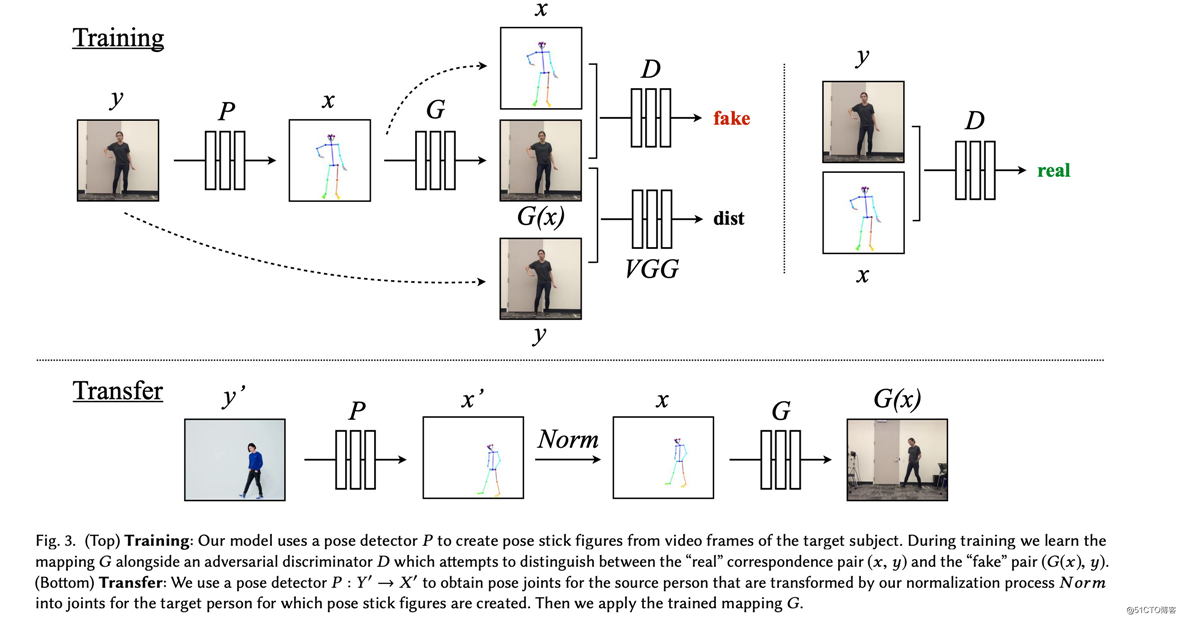

这项黑科技具体原理是这样的,将动作迁移管道一共分为三个部分:

团队使用现有的姿势检测模型 OpenPose(CMU 开源项目),从源视频中提取身体、面部和手部的姿势关键点。这一步的本质是对身体姿势进行编码,忽略掉身体外形等信息。

对舞者进行姿态检测,并编码为火柴人图形

计算给定帧内源和目标人物身体形状、位置之间的差异,将源姿态图形转换到符合目标人物身体形状和位置的姿态图形。

使用一个生成式对抗网络模型,训练模型学习从标准化后的姿态图形映射到目标人物图像。

训练过程(上)与迁移过程(下)示意图

在开发系统过程中,团队使用了 NVIDIA TITAN Xp 中的 GeForce GTX 1080 Ti GPU,和由 PyTorch 加速的 cuDNN 来训练和推理。

在图像转换阶段,采用了 NVIDIA 开发的对抗训练的图像翻译 pix2pixHD 架构。通过 pix2pixHD 的全局生成器来预测面部残差。他们对面部使用单个 70x70 PatchGAN 判别器。

训练过程中,源视频和目标视频数据的收集方式略有不同。为确保目标视频质量,使用手机相机,以每秒 120 帧的速度拍摄目标主体的实时镜头,每个视频时长至少 20 分钟。

对于源视频,只需要得到合适的姿势检测结果,所以用网上表演舞蹈的高质量视频即可。

系统映射结果展示

对于系统的结果,研究人员表示还不完美。尽管它产生的视频大多还是非常逼真的,但是偶尔也会露出马脚,比如出现身体某部位消失,就像「融化」了之类的异常现象。

此外,由于算法不对衣服编码,无法产生衣服随动作飘舞的视频,目标者必须穿紧身衣服才行。

如果暂且不计较这些缺点的话,这个技术的确令人兴奋。

有了这个 AI 工具,即使你是个舞蹈方面的小白,或者四肢僵硬不协调,也能像郭富城,罗志祥,或者任何你喜欢的舞者那样成为「舞林高手」。即使是杰克逊的太空步,对你来说也都只是小菜一碟了。

不过,拥有一个舞蹈梦的,不止伯克利分校这一个团队。谷歌在 AI 和跳舞的结合上也花了心思。

去年年底,谷歌艺术与文化部技术项目经理 Damien Henry 与英国编舞家 Wayne McGregor 合作,共同研发了一种能够自动生成特定风格的舞蹈编排工具。

拥有普利茅斯大学名誉科学博士学位的 McGregor ,对科学和技术素来感兴趣。当他回顾自己 25 年来的舞蹈视频时,想到能否通过技术来使表演保持新鲜感。于是他去向 Henry 请教,如何借助技术不断创作出新的舞蹈内容?

而 Henry 从一个科学网站的帖子获得了灵感。这个帖子介绍了使用神经网络,能够用根据前一个字母中的笔迹预测下一个字母。

于是,他提出了一种类似算法,能够对给定运动进行预测。通过视频捕获舞者姿势,然后生成接下来最有可能进行的舞蹈动作,并在屏幕上实时显示。

视频中演示了 AI 编舞并实时显示在屏幕上的效果

这个算法也同样忽略了人的衣着,只是捕捉演员特定姿势的关键点,从而得出火柴人模型。

当他们录入 McGregor 和他的舞蹈演员的舞蹈视频后,AI 学会了如何跳舞,而且生成的舞蹈风格和 McGregor 的很相似。

虽然在舞蹈创造力上,人工智能还是有一定的局限性。这款谷歌 AI 工具并不能发明出它从未「见过」的动作。它只是预测在它学过的动作中,最有可能发生的动作。

此外,这个技术还可以提供混合风格的舞蹈编排,比如在 McGregor 的录像中插入巴西桑巴舞的录像,AI 可能会给出一个全新的混合舞。Henry 并不担心它会给出一个四不像的舞蹈,因为学习的源头还是由人去输入的。

看了这么多帮你「跳舞」的技术,是不是已经跃跃欲试了呢?

舞蹈 AI 能让不敢动不想动的人,更自在更轻松地动起来,体验舞蹈和运动的乐趣。但这背后的技术可不仅仅只是博人一乐。

支撑起舞蹈 AI 的姿态估计,背后潜藏着巨大的能量,它能够帮助我们更准确地完成形体动作,比如 3D 健身学习、体育项目姿势矫正,病人康复训练,甚至是虚拟试衣,拍照姿势矫正上,都会带来新的突破。

姿态估计的用途广泛

按照这样的发展,机器会越来越了解我们,越来越熟悉我们的体态特征和行为方式,从而帮我们更好地认识自己。

好了,先不说了,我要去跟 AI 学跳舞了。你要不要一起来?

COCO 大型图像数据集

COCO 数据集于 2014 年由微软发布,现已成为图像字幕的标准测试平台。文件大小为 83.39 GB。

COCO 数据集是一个大型图像数据集,设计用于机器视觉领域的对象检测、分割,人物关键点检测,填充分割和字幕生成。COCO 数据集以场景理解为目标,主要从复杂的日常场景中截取,图像中的目标通过精确的分割进行位置的标定。

COCO 数据集具有以下几个特征:目标分割,情景中的感知,超像素分割,33 万张图像(20 余万个标签),150 万个目标实例,80 个目标类,91 个物品类,25 万有关键点的人。

超神经HyperAI 搜集并整理全球数百个公开数据集,并提供国内镜像下载,对科研机构和开发者们提供免费服务。

更多相关数据集,请访问 https://hyper.ai 下载

吃了这些数据集和模型,跟 AI 学跳舞,做 TensorFlowBoys

标签:迁移 这一 视频 种类 mic 感知 一个 大学 接下来

原文地址:https://blog.51cto.com/14929242/2535321