标签:base sql 聚合 memory hba jvm优化 nod 名称 image

先搬个砖:

Hive是面向大数据的数据仓库,是一种将SQL转换为mapreduce的工具。

附上网上的一张老图(虽然老但是很具有代表性,哈哈哈)

上面的图知道,对于mapreduce任务可分为以上几个步骤,input、splitting、Mapping、Shuffing、reducing、finalresult,我们可以对这些阶段进行分别的优化!!

优化点:1.适当增加切割块的大小(单个节点先按照maxsize进行切分,剩下的进行minsize大小的合并。然后是节点之间的合并,最后是机架之间的合并。)

set mapreduce.input.fileinputformat.split.minsize = 1024000000;

set mapreduce.input.fileinputformat.split.maxsize = 1024000000;(默认256M)

set mapreduce.input.fileinputformat.split.minsize.per.node= 1024000000;

set mapreduce.input.fileinputformat.split.maxsize.per.node= 1024000000;(默认1b)

set mapreduce.input.fileinputformat.split.minsize.per.rack= 1024000000;

set mapreduce.input.fileinputformat.split.maxsize.per.rack= 1024000000;(默认1b)

set hive.input.format=org.apache.hadoop.hive.ql.io.CombineHiveInputFormat;(默认存在)

优化点:1.手动规定map的个数(例子:任务中有100个map,但是可以使map分批执行一批10个)

set mapreduce.job.running.map.limit=20;

2.规定map同时并行的个数(例子:任务中有100个map,但是可以使map分批执行一批10个)

set mapreduce.map.memory.mb=3584;(3.5G内存) 默认2.1倍会杀掉

3.限制map可使用的最大内存

set hive.map.aggr = true

set hive.groupby.mapaggr.checkinterval = 100000(将数据每100000进行聚合)

优化点:1.map后进行压缩(压缩后自动解压)

set mapreduce.map.output.compress=true(map输出压缩,mapreduce参数)

set mapreduce.map.output.compress.codec=org.apache.hadoop.io.compress.GzipCodec(map输出压缩格式,mapreduce参数)

2.map后进行合并文件操作

set hive.merge.mapfiles = true(新启一个job完成合并,合并多大set hive.merge.size.per.task决定)

优化点:1.手动规定reduce的个数

set mapred.reduce.tasks = 20;

2.规定reduce同时并行的个数(例子:任务中有100个reduce,但是可以使reduce分批执行一批10个)

set mapreduce.job.running.reduce.limit=80;

3.限制reduce可使用的最大内存

set mapreduce.reduce.memory.mb=7168;(7G内存) 默认2.1倍会杀掉

4.设置每个reduce可处理的数据大小(直接决定reduce个数)

set hive.exec.reducers.bytes.per.reducer=1024*1000*1000;

5.reduce最大个数

set hive.exec.reducers.max =2000;(mapreduce.job.running.reduce.limit变相使用)

6.reduce后可进行文件合并

set hive.merge.sparkfiles = false(spark引擎,结束后合并文件,新启动一个任务)

set hive.merge.tezfiles = false(tez引擎,结束后合并文件,新启动一个任务)

set hive.merge.mapredfiles = true(mapreduce引擎,结束后合并文件,新启动一个任务)

set hive.merge.smallfiles.avgsize =100*1000*1000 (输出文件小于当前值的时候,任务结束后合并文件的大小)

set hive.merge.size.per.task = 1024*1000*1000 (将文件合并成为多大)

优化点:1.reduce后要进行压缩写到HDFS(每个节点单独跑任务,但是最后的结果需要汇聚到一处)

set mapreduce.output.fileoutputformat.compress=false // 默认值是 false reduce属性

set mapreduce.output.fileoutputformat.compress.type=BLOCK // 默认值是 Record reduce属性

set mapreduce.output.fileoutputformat.compress.codec=org.apache.hadoop.io.compress.GzipCodec // 默认值是 org.apache.hadoop.io.compress.DefaultCodec

JVM优化:一个JVM运行的job数是有上限的,我们可以设置最大执行的个数

set mapreduce.job.jvm.numtasks=100

并发及并发线程数优化:job的子查询可能没关系,所以可以开启并发查询

set hive.exec.parallel = true;

set hive.exec.parallel.thread.number=8;

数据倾斜优化:可进行key值个数的判断,判断时候发生数据倾斜

set hive.optimize.skewjoin=true;

set hive.skewjoin.key=100000;(超过10000个相同的key就认为是数据倾斜,需要进行打散处理)

分区优化:hive有桶表和分区表,可开启动态分区(其实就是不同文件夹)

set hive.exec.dynamic.partition=true

set hive.exec.dynamic.partition.mode=nonstrict(分区表分为严格模式和非严格模式)

job之间优化:

set hive.exec.compress.output=true;(最终结果压缩。若map压缩和reduce压缩都没有用,改参数使用的话。两个job第一个job后数据不压缩,第二个job输出压缩)

set hive.exec.compress.intermediate=true(若map压缩reduce压缩最终输出压缩都没有用,改参数使用的话。两个job第一个job后数据压缩,第二个job输出不压缩) SQL优化:

小表往前放

其实上面是对每一个阶段都进行数据优化,有很多参数都是默认开启或者有默认值的。

只需要用到常用的几个就行,其他的作为了解。下面列举出比较常用的:

set mapreduce.input.fileinputformat.split.minsize = 1024000000;(参数mapreduce.map.memory.mb=3584 默认2.1倍会杀掉,一个map申请3.5G内存不用浪费了)

set mapreduce.input.fileinputformat.split.maxsize = 1024000000;

set mapreduce.input.fileinputformat.split.minsize.per.node= 1024000000;

set mapreduce.input.fileinputformat.split.maxsize.per.node= 1024000000;

set mapreduce.input.fileinputformat.split.minsize.per.rack= 1024000000;

set mapreduce.input.fileinputformat.split.maxsize.per.rack= 1024000000;

set mapreduce.job.running.reduce.limit=80;(例子:任务中有100个reduce,但是可以使reduce分批执行一批10个)

hive合并文件是新启动一个任务合并文件,感觉这个参数不太合适,有这个时间不如直接输出(map和reduce阶段都是一样的)。

(这个参数十分好,压缩不仅仅节约空间而且在网络传输的时候比较省宽带,mapreduce和spark都是默认可以解压缩的,比较方便。)

set mapreduce.map.output.compress=true(map输出压缩,map阶段参数)

set mapreduce.map.output.compress.codec=org.apache.hadoop.io.compress.GzipCodec(map输出压缩格式,map阶段参数)

set mapreduce.output.fileoutputformat.compress=false // 默认值是 false reduce阶段参数

set mapreduce.output.fileoutputformat.compress.type=BLOCK // 默认值是 Record reduce阶段参数

set mapreduce.output.fileoutputformat.compress.codec=org.apache.hadoop.io.compress.GzipCodec // 默认值是 org.apache.hadoop.io.compress.DefaultCodec

set hive.exec.compress.output=true;(最终结果压缩。若map压缩和reduce压缩都没有用,改参数使用的话。两个job第一个job后数据不压缩,第二个job输出压缩)

set hive.exec.compress.intermediate=true(若map压缩reduce压缩最终输出压缩都没有用,改参数使用的话。两个job第一个job后数据压缩,第二个job输出不压缩)

set hive.exec.parallel = true;

set hive.exec.parallel.thread.number=8;

set hive.optimize.skewjoin=true;

set hive.skewjoin.key=100000;(超过10000个相同的key就认为是数据倾斜,需要进行打散处理)

set hive.exec.dynamic.partition=true

set hive.exec.dynamic.partition.mode=nonstrict(分区表分为严格模式和非严格模式)

小表往前放

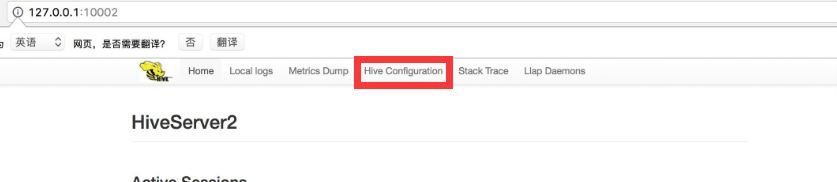

Hive UI------>>>>Hive Configuration页签找到(版本与版本之间参数的名字不太一样一定要看清楚配置的名字,最好使用最新的配置名称)

hivesql使用资源可在YARN的管理界面中RUNNING中看到,需要时不时刷新因为是动态的。(一般为3.5g*map个数字+7g*reduce个数)

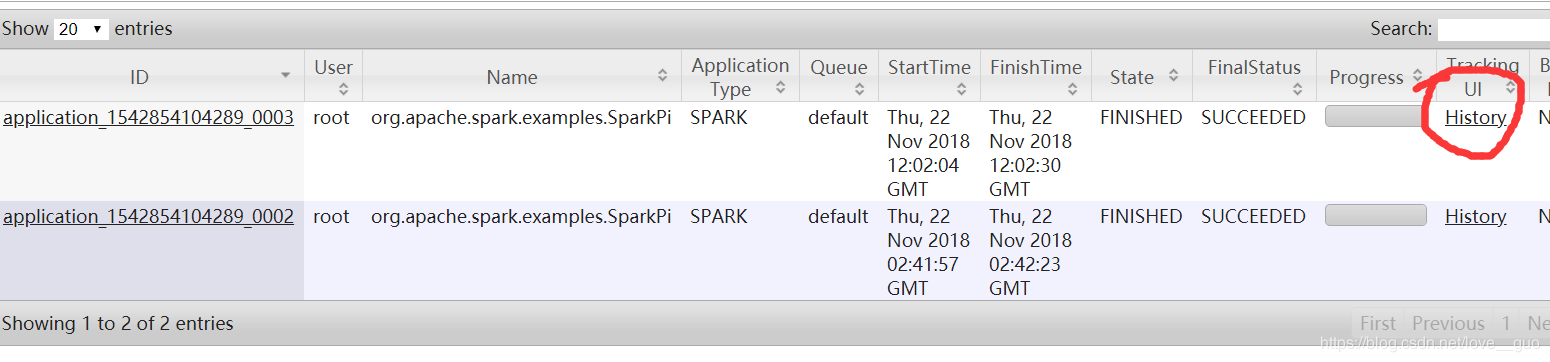

可在YARN的管理界面中FINISHED中找到job后点击History,进去之后就会看到map数和reduce数

Splitting块个数决定map个数,reduce个数取决于输出的大小(1G一个reduce)

1、HDFS页面:50070

2、YARN的管理界面:8088

3、HistoryServer的管理界面:19888

4、Zookeeper的服务端口号:2181

5、Hive.server2=10002

6、Kafka的服务端口号:9092

7、Hbase界面:16010,60010

8、Spark的界面:8080

标签:base sql 聚合 memory hba jvm优化 nod 名称 image

原文地址:https://www.cnblogs.com/xiaoliyuguohe/p/13823753.html