标签:blog http sp 2014 log bs amp 算法 tt

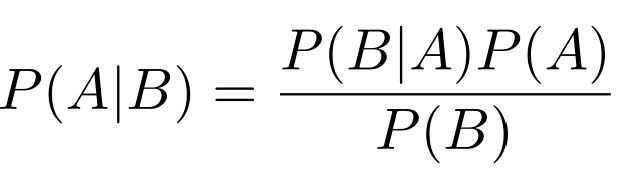

1.贝叶斯公式

每次提到贝叶斯这三个字,心中的仰慕之情油然而生。感觉贝叶斯推断是众多机器学习算法的基础(尤其是统计学习)。一个很简单的公式应用到非常复杂和广泛的领域,真是一件了不起的事情。

再讲贝叶斯公式之前,首先回顾一下概率的知识。若 A、B 是两个事件,我们用P(A)表示事件A发生的概率,P(B)表示事件B发生的概率。若果A和B相互独立,那么我们有P(AB)=P(A)P(B);如果A、B不独立,我们有P(AB)=P(B)P(A|B)。

贝叶斯公式为

证明起来也是比较简单的(根据条件概率公式直接得到)

![]()

贝叶斯公式的强大之处是他建立了P(A|B)和P(B|A)的桥梁,在很多情况下,我们可能难以计算P(A|B),那么通过贝叶斯公式,有效地转化为其他的概率的计算,这种思想是非常重要的,感觉也是贝叶斯的精髓所在。记得大学的时候我的概率统计老师经常讲“结果已知,原因未知,就用贝叶斯公式”。当时只是为了便与考试,没有深入理解这句话的含义。在监督学习中,我们已知一组样本的特征X,需要对类别Y进行推断,也就是计算Y=t的概率。但是Y是未知的,也就是我们需要计算P(Y=t|X),那么我们可以利用贝叶斯公式求出

![]()

这里:

P(X|Y=t):可以直接统计training sample得到,当然对于离散和连续的情况都要进行相应的处理。

P(Y=t):就是training sample 中类别t出现的概率

P(X) :根据全概率公式得到,对于分类的任务来说,P(X)是一个常数,往往可以不参与计算(相当于一个标准化的操作)

标签:blog http sp 2014 log bs amp 算法 tt

原文地址:http://www.cnblogs.com/taokongcn/p/4122247.html