标签:

近期开始研究学习spark,开发环境有多种,由于习惯使用STS的maven项目,但是按照许多资料的方法尝试以后并没有成功,也可能是我环境问题;也可以是用scala中自带的eclipse,但是不太习惯,听说支持也不太好,好多问题;咨询一些人后说,IDEA对scala的支持比较好。所以尝试使用IDEA来构建Spark开发环境;

1. 安装JDK

2. 安装IDEA最新版,目前是IDEA 14,社区免费版就可以;

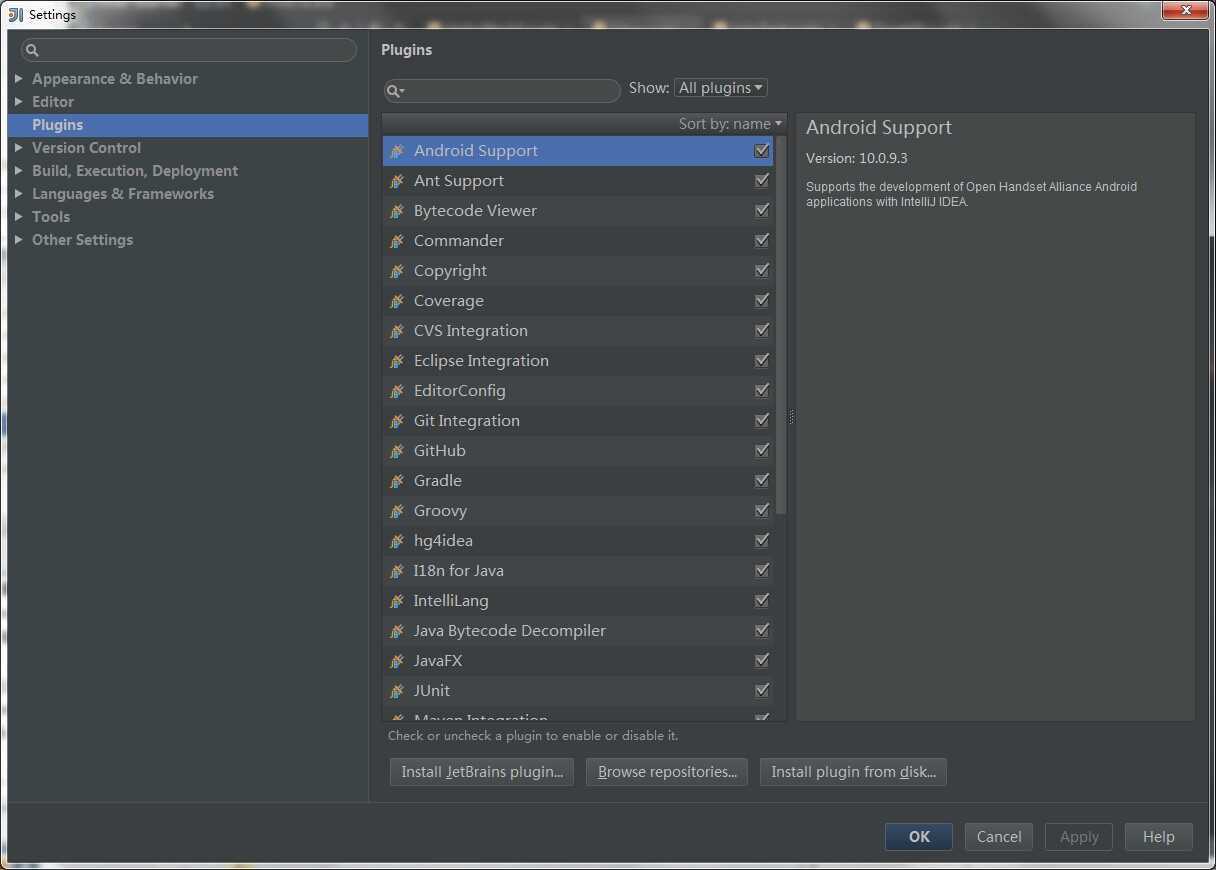

3. 安装scala插件,运行IDEA,初次运行,可以直接再弹出的tab框中选择“Configure” -> "plugins",如果已经使用过在工程页面,“File” -> "Settings" -> "Plugins" 或者Ctrl + Alt + S, 输入“scala”, 安装插件即可

4. 搭建Spark开发环境

4.1 下载spark的jar包, 在下载页面选择相应的spark版本, 包类型这里选择spark1.2.0, 和Pre-build for Hadoop 2.4进行下载spark-1.2.0-bin-hadoop2.4.tgz,解压, lib下的spark-assembly-1.2.0-hadoop2.4.0.jar是所需要的;

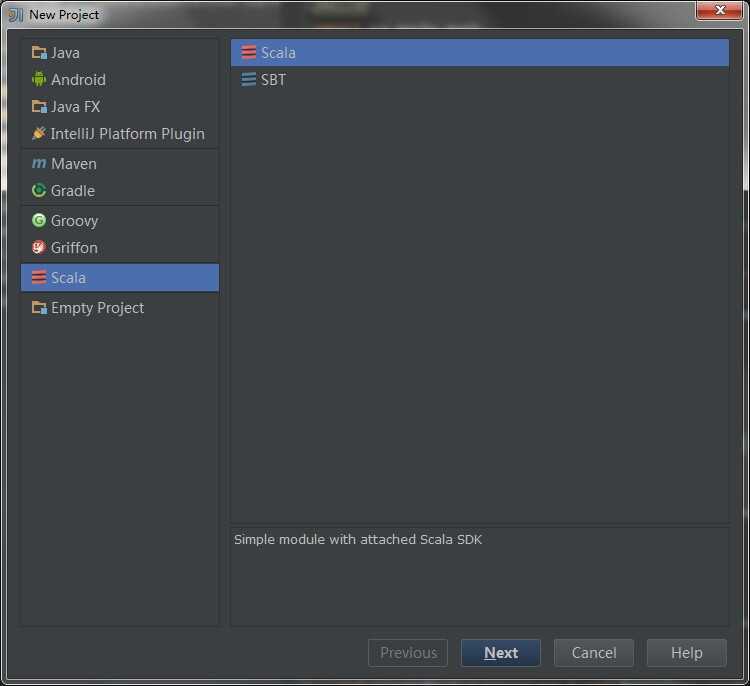

4.2 新建scala项目, “File” -> "New Project", 选择scala,scala,next起名字,finish

4.3 导入spark包

在项目页“File” -> "project structure" -> "Libraries", 点“+”,选“java”,找到spark-assembly-1.2.0-hadoop2.4.0.jar导入,这样就可以编写spark的scala程序了(例子有空补)

4.4 程序导出

如果在spark上运行程序,

标签:

原文地址:http://www.cnblogs.com/lemonqin/p/4186782.html