标签:

如果你要利用代码来跑kafka的应用,那你最好先把官网给出的example先在单机环境和分布式环境下跑通,然后再逐步将原有的consumer、producer和broker替换成自己写的代码。所以在阅读这篇文章前你需要具备以下前提:

1. 简单了解kafka功能,理解kafka的分布式原理

2. 能在分布式环境下成功运行—topic test。

如果你还没有完成上述两个前提,请先看:

接下来我们就简单介绍下kafka开发环境的搭建。

1. 搭建scala环境,这里有两种方案,第一直接去scala官网下载SDK,解压配置环境变量;第二种办法,你可以不用安装SDK,直接在项目中引用kafka编译后下载下来的scala编译包和编码包(scala-compiler.jar和scala-library.jar)。我推荐第二种,因为通过kafka编译下载下来的scala版本和kafka版本都是匹配的(但是有时候可能会跟eclipse的插件需要的环境冲突,所以最好把第一种也安装一下,以防万一),而一般我们用的是java项目来写,所以直接导入相关依赖包就可以了,第一种方案有助于我们看源码和用scala开发。这些jar的路径位于kafka-0.7.2-incubating-src\javatest\lib目录下。

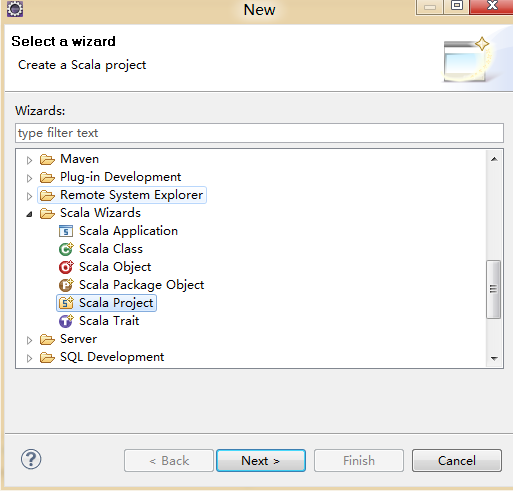

2. 为eclipse安装scala开发环境。这只是一个插件,可以在:http://scala-ide.org/中下载安装或者在线安装。装完之后,你就能在eclipse中创建scala的项目了。

我们可以先写一个hello world试一下,这样一来,是不是又多了一种语言写hello world了。

有些人new的时候找不到scala相关的类,那是因为你eclipse的perspective不对,切换到scala的perspective下就可以了。注意new的是object,然后输入:

|

1

2

3

4

5

6

7

8

|

package com.a2.kafka.scala.testobject Hello { def main(args: Array[String]): Unit = { printf("Hello Scala!!"); }} |

3. 找到编码需要的依赖包。记住去你linux上经过update的kafka文件夹里找,不要从直接从官网上下载的文件里找。具体路径是:kafka-0.7.2-incubating-src\javatest\lib 这是你用java开发kafka相关程序用到的最基础的包,如果你用到了hadoop,只要去相关的文件夹找一下就可以了。然后把这些包加到项目里即可。

到了这里,基本的开发环境应该是搭建完了,然后我们要开始写点儿简单的代码了。我们还是根据之前《分布式环境搭建》中给出的例子。稍微回忆下:

1. 启动zookeeper server :bin/zookeeper-server-start.sh ../config/zookeeper.properties & (用&是为了能退出命令行)

2. 启动kafka server: bin/kafka-server-start.sh ../config/server.properties &

3. Kafka为我们提供了一个console来做连通性测试,下面我们先运行producer:bin/kafka-console-producer.sh --zookeeper 192.168.10.11:2181 --topic test 这是相当于开启了一个producer的命令行。

4. 接下来运行consumer,新启一个terminal:bin/kafka-console-consumer.sh --zookeeper 192.168.10.11:2181 --topic test --from-beginning

5. 执行完consumer的命令后,你可以在producer的terminal中输入信息,马上在consumer的terminal中就会出现你输的信息。

这个例子就是在分布式的环境下producer生产数据,然后consumer从broker抓取数据显示在console上。当然注意一点server.properties中的hostname需要换成你的对应地址,具体可以回去看《分布式环境搭建》。现在我们就用代码来模拟producer发送数据的过程:

这里我们建一个java project就可以了,导入依赖包。kafka-0.7.2-incubating-src\javatest\lib目录下的jar.

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

|

package com.a2.test.kafka;import java.util.Properties;import kafka.javaapi.producer.Producer;import kafka.javaapi.producer.ProducerData;import kafka.producer.ProducerConfig;public class Producertest { public static void main(String[] args) { Properties props = new Properties(); props.put("zk.connect", "192.168.10.11:2181"); props.put("serializer.class", "kafka.serializer.StringEncoder"); ProducerConfig config = new ProducerConfig(props); Producer<String, String> producer = new Producer<String, String>(config); ProducerData<String, String> data = new ProducerData<String, String>("test", "Hello"); producer.send(data); }} |

这样我们就用代码代替了console去发送信息了,这里我们用了utils中的properties对象直接构建了配置,而不是直接读取,当然你也可以读配置。Data里的两个参数,第一个是指定topic,第二个是发送的内容。

接下来就是运行了,如果你是在windows下,可能会等待很久然后报Unable to connect to zookeeper server within timeout: 6000,这个可能是网卡的原因,你可以直接放到linux上,然后用命令行运行,注意引包。

|

1

|

Java –jar test.jar Dclasspath=/lib |

Consumer的代码以及实现和producer差不多,如果你感兴趣可以去官网找相关的代码,都很简单。当然还有一部分关于producer和consumer的配置,我们下篇再说。

标签:

原文地址:http://www.cnblogs.com/happyday56/p/4210938.html